С чего начинается

статистическое исследование — с

теоретического построения

гипотез или с эмпирического анализа? В

действительности теория и практика

обогащают друг друга, и подобные вопросы

возникают. Поэтому мы будем

рассматривать вопрос о проверке гипотез

с двух точек зрения. С одной стороны, мы

можем предположить, что сначала идет

теория и что цель эксперимента

заключается в выяснении ее применимости.

Это приведет к проверке гипотезы

о значимости. С другой стороны, мы можем

сначала провести эксперимент

и затем определить, какие из теоретических

гипотез соответствуют результатам

эксперимента. Это приводит к построению

доверительных интервалов.

Вам уже известна

логика, лежащая в основе построения

критериев значимости

и доверительных интервалов и описанная

в вводном курсе статистики. Поэтому

вы уже знакомы с большинством понятий,

используемых в регрессионном

анализе. Однако один вопрос может

оказаться для вас новым — это использование

односторонних критериев. Такие критерии

используются в регрессионном

анализе очень часто. В самом деле, они

являются, или должны быть,

более обычными здесь, чем традиционно

используемые в учебниках двусторонние

критерии. Поэтому важно, чтобы вы поняли

целесообразность их

применения, и путь к этому состоит из

последовательности небольших аналитических

шагов. Ни один из них не должен представлять

трудности, но следует

иметь в виду, что если вы попытаетесь

сократить свой путь, или, еще хуже,

сделаете попытку свести всю процедуру

к механическому использованию

нескольких формул, вы столкнетесь с

большими трудностями.

Формулирование нулевой гипотезы

Начнем с допущения

о том, что теория предшествует эксперименту

и что вы уже

имеете в виду некоторую гипотетическую

связь или зависимость. Например,

вы можете считать, что темп общей инфляции

в экономике (p,

в %) зависит от

темпа инфляции, вызванной ростом

заработной платы (w,

в %), и что эта

зависимость описывается линейным

уравнением:

(2.61)

где p1

и р2

— параметры, а u

— случайный член. Далее вы можете

построить гипотезу о том, что без учета

эффектов, вносимых случайным членом,

общая инфляция

увеличивается в той же степени, что и

инфляция, вызванная ростом

заработной платы. В этих условиях вы

можете сказать, что гипотеза, которую

вы собираетесь проверять, известная

как ваша нулевая

гипотеза и

обозначенная

H0,

состоит в том, что β2

равняется единице. Мы также определяем

альтернативную

гипотезу, обозначаемую

Н1,

которая представляет заключение. которое

делается в том случае, если экспериментальная

проверка указала на ложность

H0.

В данном случае эта гипотеза состоит в

том, что

.

Две гипотезы

сформулированы с использованием

следующих обозначений:

H0:β2=1;

H1:β2≠1.

В этом конкретном

случае, если мы действительно считаем,

что общая инфляция равна инфляции,

вызванной ростом заработной платы, мы

делаем попытку

защитить нулевую гипотезу H0,

подвергнув ее максимально строгой

проверке и

надеясь, что она не будет опровергнута.

Однако на практике более обычным

является построение нулевой гипотезы,

которая затем будет проверяться

с помощью альтернативной гипотезы,

которая предполагается верной Например,

рассмотрим простую функцию заработка:

(2.62)

где EARNINGS

— часовой

заработок в долларах, a

S

— число

законченных лет обучения.

Исходя из вполне разумных теоретических

оснований, вы предполагаете, что

заработок зависит от продолжительности

обучения, но ваша теория

недостаточно «сильна», чтобы можно было

определить конкретное значение

для β2.

Тем не менее, вы можете установить

наличие зависимости величины

заработка от S,

используя

для этого обратную процедуру, когда в

качестве нулевой

гипотезы принимается утверждение о

том, что величина заработка не

зависит от

S,

т.е. что β2

равняется нулю. Альтернативная гипотеза

заключается в

том, что величина β2

не равняется нулю, иными словами, что

величина S

влияет на

размер заработка. Если вы можете

отвергнуть нулевую гипотезу, то вы

таким образом устанавливаете наличие

зависимости, по крайней мере в

общих чертах.

С использованием введенной системы

обозначений, ваши нулевая

и альтернативная гипотезы примут вид

H0:

β2

= 0 и Н1:

β2

≠ 0

соответственно.

Последующий анализ

касается модели парной регрессии

(2.65)

Он будет относиться

только к коэффициенту наклона β2,

но точно такие ж с процедуры

применимы и к постоянному члену β1

Возьмем общий случай, в

котором в

нулевой гипотезе утверждается, что β2

равно некоторому конкретному значению,

например

,

и альтернативная гипотеза состоит в

том, что β2

не равно этому

значению (H0:

β2

=

,;

Н1:

β2

≠

).

Вы можете предпринять попытку

отклонить или подтвердить нулевую

гипотезу, в зависимости от того что

вам необходимо в данном случае. Будем

считать, что предпосылки в разделе

2.2 выполнены.

Вывод следствии

гипотезы

Если гипотеза H0

верна, то значения b2,

полученные

в ходе регрессионного анализа,

будут иметь распределение с математическим

ожиданием

и дис-

Персией

.

Теперь мы вводим допущение, что случайный

член и

имеет нормальное

распределение. Если это так, то величина

b2

будет также

нормально

распределена, как показано на рис. 2.6.

Сокращение «sd»

на рисунке соответствует величине

стандартного отклонения оценки b2

т.е.

.

Учитывая структуру нормального

распределения, большинство

оценок параметра b2

будет

находиться в пределах двух стандартных

отклонений от

(если гипотеза H0

:β2 =

верна).

Сначала мы допустим,

что знаем величину стандартного

отклонения величины

b2.

Это наиболее

нереалистичное допущение, и мы позднее

отбросим его. На

практике же значение этого отклонения

(так же, как и неизвестные значения

параметров (β1

и β2)

подлежит оценке. Можно, тем не менее,

упростить обсуждение,

предположив, что точное значение

отклонения известно, и, следовательно,

у нас есть возможность построить график,

показанный на рис. 2.6.

Проиллюстрируем

это на примере модели связи общей

инфляции и инфляции,

вызванной ростом заработной платы

(2.61). Предположим, что некоторым

образом мы знаем, что стандартное

отклонение величины b2

составляет

0,1. Тогда, если

нулевая гипотеза H0:

β2

= 1 верна, то оценки коэффициентов

регрессии будут распределены так, как

это показано на рис. 2.7. Из этого рисунка

можно видеть, что при справедливости

нулевой гипотезы оценки будут находиться

приблизительно между 0,8 и 1,2.

Сопоставимость,

случайность и уровень значимости

Теперь приступим

к главному. Предположим, что мы взяли

фактическую выборку

из наблюдений общей инфляции и инфляции,

вызванной ростом заработной платы, и

построили оценку β2,

используя для этого регрессионный

анализ. Если

оценка близка к единице, то мы должны

быть полностью удовлетворены

нулевой гипотезой, так как она и результат

оценивания для выборки

совместимы друг с другом. Предположим,

с другой стороны, что оценка значительно

отличается от единицы. Допустим,

например, что она равна 0,7. Это

составит три стандартных отклонения

вниз от 1,0. Если нулевая гипотеза верна,

то вероятность того, что отличие b2

от среднего

достигнет трех стандартных

отклонений в положительную или

отрицательную сторону, составляет лишь

0,0027, т.е. очень низка.

Рисунок 2.6.

Структура

нормального распределения оценки b2

в единицах стандартных отклонений от

математического ожидания

Рисунок 2.7. Пример

распределения величины b2

(модель связи общей инфляции и

инфляции, вызванной ростом заработной

платы)

Исходя из этого

вызывающего беспокойство результата,

вы можете прийти к одному из двух

выводов:

-

Вы можете продолжать

считать, что ваша нулевая гипотеза H0:

(β2

= 1 верна и

что эксперимент дал случайный результат.

Вы допускаете, что вероятность

получения такого низкого значения для

b2

является

очень небольшой. но,

тем не менее, она имеет место в 0,27%

случаев, и вы допускаете, что это именно

тот случай. -

Вы можете сделать

вывод о том, что гипотеза противоречит

результат) оценивания

регрессии. Вы не удовлетворяетесь

объяснением, данным в

пункте 1, так

как вероятность очень мала, и понимаете,

что наиболее правдоподобным

объяснением является то, что величина

β2

вовсе не равняется единице. Другими

словами, вы принимаете альтернативную

гипотезу H1:

β2≠

1.

Каким образом вы

определите, когда необходимо выбрать

первый вывод, а когда

— второй? Очевидно, что чем меньше

вероятность получения регрессии,

подобной той, которую вы получили при

условии правильности вашей гипотезы,

тем больше вероятность вашего отказа

от гипотезы и тем очевиднее переход

ко второму выводу. Насколько малой

должна быть указанная вероятность

для выбора второго вывода?

На этот вопрос нет

и не может быть определенного ответа.

В большинстве работ

по экономике за критический уровень

берется 5 или 1%. Если выбирается

уровень 5%, то переключение на второй

вывод происходит в том случае. когда

при истинности нулевой гипотезы

вероятность получения столь экстремального

значения для b2

составляет

менее 5%. В этом случае говорят, что

нулевая

гипотеза должна быть отвергнута при

5%-ном уровне

значимости.

Это происходит в том случае, когда

величина b2

отстоит от величины

более чем на 1,96 стандартного

отклонения. Если вы посмотрите на таблицу

нормального распределения (табл. А.1 в

Приложении А), то вы увидите, что

вероятность того,

что величина b2

будет

превосходить среднее значение на более

чем 1,96 стандартного отклонения, составляет

2,5%, и, аналогичным образом, вероятность

того, что эта величина будет более чем

на 1,96 стандартного отклонения ниже

среднего значения, также составляет

2,5%. Общая вероятность того, что данная

величина отстоит от математического

ожидания более чем на 1,96 стандартного

отклонения, составляет, таким образом,

5%. Мы можем обобщить это решающее

правило в математической форме, полагая,

что нулевая гипотеза отвергается, если:

z> 1,96 или z<

-1,96, (2.64)

где z — число

стандартных отклонений между регрессионной

оценкой и гипотетическим значением

для β2:

(2,65)

Нулевая гипотеза не будет отвергнута,

если

-1,96 <z<

1,96. (2.66)

Это условие можно записать с помощью

величин b2

и

,

подставив выражение для z

из уравнения (2.65):

-1,96 ≤

≤

1,96. (2.67)

Умножив все части

неравенства на стандартное отклонение

величины b2

можно получить

-1,96 s.d.(b2)

≤ b2

—

≤

1,96 s.d.(b2), (2.68)

а из этого соотношения

можно получить следующее:

—

1,96 s.d.(b2)

<b2<

+

1,96 s.d.(b2). (2.69)

Уравнение (2.69) дает

множество значений для величины b2,

которые не

приводят к

отказу от конкретной нулевой гипотезы

о том, что β2

=

.

Это множество

значений получило название области

принятия гипотезы для

b2

при 5%-ном

уровне значимости. В нашем примере

модели связи общей инфляции и

инфляции, вызванной ростом заработной

платы, где s.d.(b2)

равняется

0,1, можно

отвергнуть гипотезу при уровне значимости

в 5%, если величина b2

находится

выше или ниже гипотетического среднего

значения на величину более

0,196, т.е. выше 1,196 или ниже 0,804. Таким

образом, область принятия гипотезы

включает значения величины b2

от 0,804 до

1,196. Это показано не-затененной

областью на рис. 2.8

Рисунок 2.8.

Область

принятия гипотезы для величины Ь2

при 5%-ном уровне значимости

Аналогичным образом

считается, что нулевая гипотеза должна

быть отвергнута

при уровне значимости в 1%, если гипотеза

подразумевает, что вероятность

получения столь экстремального значения

для величины b2

составляет

менее 1%. Это

происходит тогда, когда величина b2

отстоит на

более чем 2.58

стандартного

отклонения вверх или вниз от гипотетического

значения величины β2, т.е. когда

z

> 2,58 или z<

-2,58.

(2

.70)

Вставка 2.4.

Ошибки I

и II

рода в повседневной жизни

Проблема избежать

допущения ошибок I

и II

рода известна всем. Типичным примером

этого является расследование уголовного

преступления. Если за нулевую

гипотезу принять то, что подсудимый

невиновен, то ошибка I

рода происходит

тогда, когда суд присяжных признает его

виновным. Ошибка II

рода имеет место

в том случае, когда суд присяжных ошибочно

оправдывает виновного подсудимого.

Опять возвратившись

к таблице нормального распределения,

вы может видеть,

что вероятность того, что величина b2

будет более

чем на 2,58 стандартного

отклонения отстоять вверх от своего

математического ожидания, составляет

0,5%, и та же самая вероятность для

нахождения этой величины ниже

своего

математического ожидания более чем на

2,58 стандартного отклонения.

Таким образом, общая вероятность

получения столь экстремальных значений

составляет 1 %. В нашем примере вы

отвергнете нулевую гипотезу о том что

β2

= 1, если оценка коэффициента регрессии

будет находиться выше 1.258 или ниже

0,742.

Можно задаться

вопросом, почему исследователи обычно

представляют

результаты при уровнях значимости 5 и

1%. Почему недостаточно ограничиться

только одним уровнем? Причина заключается

в том, что обычно делается

попытка найти баланс между риском

допущения ошибок I

и II

рода.

Ошибка I

рода имеет место в том случае, когда вы

отвергаете истинную нулевую

гипотезу. Ошибка II

рода возникает тогда, когда вы не

отвергаете ложную гипотезу.

Очевидно, что чем

ниже критическая вероятность, тем меньше

риск получения

ошибок I

рода. Если вы используете уровень

значимости, равный 5%, то

вы будете отвергать истинную гипотезу

в 5% случаев. Если уровень значимости

составляет 1%, то вы будете делать ошибку

I

рода в 1% случаев. Таким образом,

в этом отношении 1%-ный уровень значимости

более надежен. Если вы

отвергли гипотезу на этом уровне, вы

почти наверняка были вправе сделать

это. Именно по этой причине 1%-ный уровень

значимости описывается как «более

высокий» в сравнении с 5%-ным уровнем.

В то же время, если

нулевая гипотеза ложна, то чем выше ваш

уровень значимости,

тем шире ваша область принятия гипотезы,

тем выше вероятность того, что вы не

отвергнете ее, и тем выше риск допущения

ошибки II

рода. Таким

образом, вы оказываетесь перед дилеммой.

Если вы будете настаивать на

очень высоком уровне значимости, то

столкнетесь с относительно высоким

риском допущения ошибки II

рода, если гипотеза окажется ложной.

Если вы выбираете низкий уровень

значимости, то оказываетесь перед

относительно

высоким риском допущения ошибки I

рода, если гипотеза истинна.

Большинство людей

выбирают достаточно простую форму

обеспечения гарантий

и осуществляют проверку на обоих уровнях

значимости, представляя результаты

каждой такой проверки. На самом деле

часто нет никакой необходимости

непосредственно ссылаться на оба

результата. Так как величина b2

должна

быть более «экстремальной» для гипотезы,

отвергаемой при 1 %-ном уровне

значимости, чем при 5%-ном, и если вы

отклоняете ее при 1 %-ном уровне,

то из этого автоматически следует, что

вы отклоните ее и при уровне значимости

в 5%, и нет необходимости упоминать об

этом. Если же вы не отвергаете

гипотезу при уровне значимости в 5%, то

из этого автоматически следует,

что вы не отвергнете ее и при 1 %-ном

уровне значимости. Только в одном случае

вы должны представить оба результата:

если гипотеза отвергается на 5%-ном,

но не на 1%-ном уровне значимости.

t

-ТЕСТЫ

До сих пор мы считали,

что стандартное отклонение величины

b2

известно.

Однако на

практике это допущение нереально. Это

можно показать на примере

стандартной ошибки для величины b2

взятой из

уравнения (2.44). Это приводит

к двум изменениям процедуры проверки

гипотез. Во-первых, величина

z

определяется

на основе использования стандартной

ошибки с.о.(b2)

вместо

стандартного отклонения s.d.(b2)

и носит название t-статистики:

(2.71)

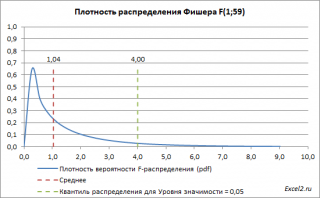

Во-вторых, критические

уровни t

определяются

величиной, имеющей так называемое

t-распределение

вместо нормального распределения. Мы

не будем

вдаваться в причины этого или даже

описывать t-распределение

математически. Достаточно будет

сказать, что оно родственно нормальному

распределению, а его точная форма

зависит от числа степеней свободы в

регрессии, и

оно все лучше аппроксимируется нормальным

распределением по мере увеличения

числа степеней

свободы. Вы,

конечно, уже встречали понятие

t—распределения

во вводном курсе статистики. В табл. А.2

Приложения А представлены критические

значения для t,

сгруппированных

по уровням значимости и числу

степеней свободы.

Оценивание каждого

параметра в уравнении регрессии поглощает

одну степень

свободы в выборке. Отсюда число степеней

свободы равняется числу наблюдений

в выборке минус число оцениваемых

параметров. Параметрами являются

постоянный член (при условии, что он

введен в модель регрессии) и коэффициенты

при независимых переменных. В

рассматриваемом случае парной регрессии

оцениваются только два параметра β1

и β2,

поэтому число степеней

свободы составляет (п

— 2). Следует

подчеркнуть, что когда мы перейдем к

множественному регрессионному анализу,

потребуется более общее выражение.

Критическое значение

для t,

которое мы обозначим как tкрит

, заменит

число 1,96 в

уравнении (2.67). Задача t-теста

состоит в том, чтобы сравнить t-статистику

и tкрит

. Таким образом,

условие того, что оценка регрессии не

должна приводить

к отказу от нулевой гипотезы HQ:

β2

=

,

будет следующим:

(2.72)

Следовательно, мы

имеем правило для принятия решения: H0

отвергается, если

,

и она не

отвергается, если

,

где

—

абсолютная величина (модуль) значения

t.

Примеры

В разделе 1.6 была

оценена регрессия величины заработка

на число лет обучения

по данным Всеамериканского опроса

молодежи, распечатка для которой

приведена в табл. 2.6. В первых двух ее

столбцах указаны названия переменных,

здесь это S

и свободный член (Stata

обозначает его как _cons),

и оценки их

коэффициентов. В третьем столбце

приведены соответствующие стандартные

ошибки. Предположим, что одна из задач

оценивания регрессии состояла

в подтверждении нашей догадки о том,

что размер заработка зависит от

продолжительности полученного

образования. Соответственно, мы формируем

нулевую гипотезу Н0:

β2

= 0, и затем пытаемся опровергнуть ее.

Соответствующая

t-cтатистика,

вычисленная по формуле (2.71), есть оценка

коэффициента, деленная на ее

стандартную ошибку:

(2.73)

Так как в выборку

включено 540 наблюдений, и мы оценили два

параметра, то

число степеней свободы составляет 538.

В табл. А.2 отсутствуют критические

значения t

для 538 степеней свободы, но мы знаем, что

они должны быть меньше,

чем соответствующие критические значения

для 500 степеней свободы,

так как критическое значение есть

убывающая функция числа степеней

свободы.

Критическое значение для 500 степеней

свободы при 5%-ном уровне значимости

равняется 1,965. Следовательно, мы можем

с уверенностью отвергнуть

H0,

сделав вывод о том, что продолжительность

обучения влияет на размер

заработка. Если этот критерий описать

словами, то верхний и нижний 1.5%-ные

«хвосты» t-распределения

при 538 степенях свободы начинаются со

стандартных

отклонений (1,965 вверх и вниз) от его

математического ожидания,

равного нулю. Коэффициент регрессии,

который по оценкам находится в пределах

1,965 стандартного отклонения от

гипотетического значения, не приводит

к отказу от последнего. В рассматриваемом

случае расхождение будет

эквивалентно 10,59 стандартного отклонения,

и мы приходим к выводу о том,

что результат регрессии противоречит

нулевой гипотезе. Конечно, поскольку

мы используем уровень значимости 5% в

качестве основы

для проверки гипотезы, существует 5%-ный

риск допустить ошибку I

рода. В этом случае мы могли бы снизить

риск до 1% за счет применения уровня

значимости в 1 %. Критическое значение

для / при 1 % -ном уровне зна-чимости

с 500 степенями свободы составляет 2,586.

Поскольку /-статистика превышает

это число, мы видим, что можно легко

отказаться от нулевой гипотезы

также и на этом уровне значимости.

Таблица 2.6

|

EARNINGS S |

|||||||

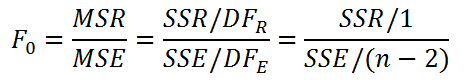

|

Sourse |

SS |

df |

MS |

Number of |

= |

540 |

|

|

F(1,538) |

= |

112.15 |

|||||

|

Model |

19321.5589 |

1 |

19321.5589 |

Prob>F |

= |

0.0000 |

|

|

R-squared |

= |

0.1725 |

|||||

|

92688.6722 |

538 |

172.283777 |

Adj |

= |

0.1710 |

||

|

Total |

112010.231 |

539 |

207.811189 |

RootMSE |

= |

13.126 |

|

|

EARNINGS |

Coef. |

Std. Err. |

t |

P>|t| |

[95%Conf. |

Interval] |

|

|

S |

2.455321 |

.2318512 |

10.59 |

0.000 |

1.999876 |

2.910765 |

|

|

_cons |

-13.93347 |

3.219851 |

-4.33 |

0.000 |

-20.25849 |

-7.608444 |

Отметим, что если

5%- и 1 %-ный тесты приводят к одному и тому

же выводу,

то нет необходимости представлять

результаты обоих, и если это сделать,

то это может

быть расценено как некомпетентность.

По этому вопросу прочтите

внимательно Вставку 2.5 о представлении

результатов оценивания регрессии.

Процедура установления

взаимосвязи между зависимой и объясняющей

переменными

путем высказывания, а затем отклонения

нулевой гипотезы H0:

β2

= 0, используется очень часто. Соответственно

все серьезные регрессионные программы

автоматически выводят t-статистику

для этого специального

случая; иными словами, коэффициент

делится на его стандартную ошибку.

Данное отношение

часто обозначается как «t-статистика».

В приведенной распечатке

результатов значения t-статистики

для постоянного члена и коэффициента

наклона показаны в среднем столбце.

Если, однако, нулевая

гипотеза определяет некоторое ненулевое

значение величины

β2,

то необходимо использовать более общее

выражение (2.71),

Вставка 2.5.

Описание результатов проверок по

t-критерию

Предположим, что

имеет место теоретическая зависимость

и нулевая и

альтернативная гипотезы имеют вид H0:

β2

=

, H1:

β2

≠

.

Если для β2

по выборочным данным получена оценка

b2,

то области принятия и отклонения

гипотез для 5%- и 1%-ного уровней значимости

могут быть в общем виде представлены

левой частью рис. 2.9.

Правая часть рисунка

показывает те же самые области для

конкретного примера

модели связи общей инфляции и инфляции,

вызванной ростом заработной

платы; при этом нулевая гипотеза будет

иметь вид β2

= 1. Нулевая гипотеза не

будет отклонена при уровне значимости

5%, если величина bг

находится в

пределах 2,101

стандартной ошибки от единицы, т.е. в

диапазоне 0,29-1,21, и она

не будет отклонена при уровне значимости

1 %, если величина b2

находится в

пределах 2,878 стандартного отклонения

от единицы, т.е. в диапазоне между 0,71

и 1,29.

Из рис. 2.9 можно

видеть, что существует три типа зон

принятия решений:

-

зона, где величина

b2

настолько

далека от гипотетической величины (β

2, что

нулевая гипотеза отклоняется как при

5%~ном, так и при 1%-ном уровнях значимости; -

зона, где величина

b2

достаточно

далека от гипотетической величины (β

2, чтобы

нулевая гипотеза была отклонена при

5%-ном, но не при 1%-ном уровне значимости; -

зона, где величина

b2

достаточно

близка к гипотетической величине (β

2, чтобы

нулевая гипотеза не была отклонена ни

при одном из двух рассматриваемых

уровней значимости.

На основании схемы

можно проверить, что если нулевая

гипотеза отклоняется

при 1%-ном уровне значимости, то она

автоматически отклоняется и при 5%-ном

уровне значимости. Следовательно, в

случае I

необходимо заявить лишь

об отклонении гипотезы при 1%-ном уровне.

Заявлять об ее отклонении при

5%-ном уровне нет необходимости. Это

равнозначно тому, чтобы сделать заявление

о возможности взятия прыгуном высоты

в 2 м, а затем, в качестве дополнения,

заявить о его возможности взять высоту

в 1,5 м. Аналогичным образом, для случая

3

вам необходимо сделать только заявление

о том, что в этом конкретном

случае гипотеза не будет отклонена при

5%-ном уровне значимости.

Отсюда автоматически следует, что она

не будет отклонена и при 1%-ном уровне,

и дополнение к этому заявлению имело

бы тот же эффект, как если бы к заявлению

о том, что прыгун в высоту не может взять

высоту в 1,5 м, было добавлено

утверждение о его неспособности взять

высоту в 2 м. Лишь в случае 2

нужно (и

желательно) представить результаты

обеих проверок.

Заметим, что если

вы обнаружили, что нулевую гипотезу

можно отвергнуть при

5%г-ном уровне значимости, то не нужно

на этом останавливаться. Вы обнаружили,

что нулевая гипотеза может быть отвергнута

при данном уровне значимости,

но остается 5% шансов совершить ошибку

I

рода. Вы должны также выполнить тест

при уровне значимости 1%. Если вы

обнаружили, что нулевая гипотеза

может быть отвергнута и при этом уровне

значимости, то это и есть результат,

который нужно приставить. Риск ошибки

I

рода составляет теперь только

1%, и ваш вывод будет намного более

убедительным. Это — случай 1, описанный

выше. Если вы не можете отвергнуть

гипотезу на 1%-ном уровне, то вы

пришли к случаю 2

и

должны

представить результаты обоих тестов.

а t-статистика

вычисляется вручную. Например, вновь

рассмотрим модель связи общей

инфляции и инфляции, вызванной ростом

заработной платы (2.61),

и предположим, что выбранная модель

оказалась следующей (в скобах —

стандартные ошибки):

(2.74)

(0.05) (0.10)

Если теперь

исследовать гипотезу о том, что общая

инфляция равна инфляции,

вызванной ростом заработной платы, то

наша нулевая гипотеза будет состоять

в том, что коэффициент при w

равен 1,0.

Соответствующая t-статистика

примет вид:

(2.75)

Если в выборке

содержится, скажем, 20 наблюдений, то

количество степеней

свободы составит 18, а критическое

значение для t

на 5%-ном уровне значимости

составит 2,101. Абсолютная величина

t-статистики

меньше этого числа, поэтому в данном

случае мы не отвергаем нулевую гипотезу.

Оценка, равная

0,82, меньше гипотетического значения

1,00, но не настолько меньше, чтобы

исключить возможность правильности

нулевой гипотезы. И последнее замечание

о представлении результатов оценивания

регрессии: некоторые авторы

помещают t-статистику

в скобках под коэффициентом вместо

стандарт ной

ошибки. Это нужно тщательно проверять,

а представляя свои результаты следует

ясно указать, какую из двух величин вы

приводите.

|

Общий случай |

Решение |

Пример зависимости общей инфляции |

|

Отклонить Н0 при |

||

|

|

1,29 |

|

|

Отклонить Н0 при |

||

|

|

1,21 |

|

|

При уровне значимости 5% или 1% гипотеза |

1,00 |

|

|

|

0,79 |

|

|

Отклонить Н0 при |

||

|

|

0,71 |

|

|

Отклонить Н0 при |

Рисунок 2.9.

Представление результатов проверки

гипотез по f-критерию

(суждения в

скобках представлять не нужно)

Значения р

Пятый столбец

результатов расчетов в табл. 2.6,

озаглавленный Р

>t,

представляет

альтернативный подход к описанию

значимости коэффициентов регрессии.

Числа в этом столбце показывают значения

р для

каждого коэффициента.

Это вероятности получения соответствующих

значений t-статистку

если нулевая

гипотеза Н0:

(β2

= 0 верна. Значение p

меньшее, чем 0,01, означает,

что эта вероятность меньше, чем 1%, что,

в свою очередь, означает, что

нулевая

гипотеза была бы отклонена при 1%-ном

уровне значимости; значение

p

между 0,01 и 0,05 означает, что нулевая

гипотеза была бы отклонена при

5%-ном уровне

значимости, но не при 1%-ном. Величина p,

равная или превышающая

0,05, свидетельствует, что нулевая гипотеза

не была бы отклонена при 5%-ном уровне

значимости.

Подход, основанный

на значениях p

более информативен, чем подход, основанный

на задании с 5%- и 1%-ного уровня значимости,

поскольку он дает точную

вероятность ошибки I

рода, если нулевая гипотеза верна.

Например, в табл.

2.6 для функции заработка, приведенной

выше, значение р

для коэффициента

наклона равно 0,0000, что означает, что

вероятность получения t-статистики

10,59 или больше составляет здесь менее

чем 0,005%. Следовательно мы

отвергнем гипотезу о равенстве нулю

коэффициента наклона при 1%-н: уровне

значимости. В действительности мы

отвергли бы здесь ее и при yровне

значимости 0,1%

(см. следующий подраздел). Выбор между

подходом, основанным

на значении р,

и подходом с

заданием уровня значимости 5%(1%) может

быть основан на негласном соглашении.

Так, в медицинской литературе

используются значения p,

в то время как в экономической литературе

обычно применяются

оценки 5%- и 1%-ного уровня значимости.

Вставка 2.6.

Терминология принятия (отклонения)

гипотезы

В этом подразделе

было показано, что следует отклонить

нулевую гипотезу, если t-статистика

больше, чем tкрит,

или меньше, чем — tкрит,

и не следует отклонять

эту гипотезу, если t-статистика

находится между t

и tкрит.

Почему «не отклонять»,

к чему это усложнение? Не было бы проще

сказать, что вы принимаете

гипотезу, если абсолютная величина t

-статистики меньше, чем

tкрит.

Аргументом против

использования «термина «принять»

является то, что вы способны «принять»

несколько взаимоисключающих гипотез

в одно и то же время.

Так, в примере с зависимостью между

общей инфляцией и инфляцией. вызванной

ростом заработной платы, вй не могли бы

отклонить нулевую гипотезуH0:

β2

= 0,9 или нулевую гипотезу H0:

β2

= 0,8. Логично утверждать, что вы не

отклоняете эти нулевые гипотезы, а также

нулевую гипотезу HQ;

β2

= 1, рассмотренную

выше, но практически бессмысленно

заявлять, что вы одновременно

принимаете все три гипотезы. В следующем

подразделе вы увидите, что можно

определить целый ряд гипотез, которые

не могут быть отклонены в результате

данного эксперимента, поэтому было бы

неосторожно выбрать одну из них как

«принятую».

Тесты с

уровнем значимости 0,1%

Если значение

t-статистики

очень велико, то следует проверить,

отвергается ли нулевая гипотеза при

уровне значимости 0,1%. Если возможно,

следует представить

результат такого теста, поскольку он

дает возможность отвергнуть

нулевую гипотезу с минимальным риском

допущения ошибки I

рода.

Вчера мне в очередной раз пришлось объяснять почему DataScientist-ы не используют ошибки первого и второго рода и зачем же ввели полноту и точность. Вот прямо заняться нам нечем, лишь бы новые критерии вводить.

И если ошибка второго рода выражается просто:

где Π — это полнота;

то вот ошибка первого рода весьма нетривиально выражается через полноту и точность (см.ниже).

Но это лирика. Самый важный вопрос:

Почему в DataScience используют полноту и точность и почти никогда не говорят об ошибках первого и второго рода?

Кто не знает или забыл — прошу под кат.

Бизнес-задача

Так как Хабр — это блог IT-шников, постараюсь по минимуму использовать мат.абстракции и рассказывать сразу на примере. Предположим, что мы решаем задачу Fraud-мониторинга в ДБО условного банка Roga & Copyta, сокращённо R&C.

Предположим, что у мы разработали некую автоматизированную экспертную систему (ЭС), определяющую для каждой платёжной транзакции: является ли данная транзакция мошеннической (fraud, F) или легитимной (genuine, G).

Необходимо определить «хорошие» критерии оценки качества системы и дать формулы расчета этих критериев.

Так как Roga & Copyta — это хоть и маленький, но всё же банк, то в нём работают люди меркантильные и ничего кроме денег их не интересует. Поэтому разрабатываемые критерии должны максимально прозрачно показывать: насколько выгодно им использовать нашу ЭС? Может быть выгодно установить ЭС конкурентов?

События и вероятности

Для каждой транзакции могут быть определены четыре события:

- Fr (fraud real) — событие того, что транзакция в действительности окажется мошеннической;

- Gr (genuine real) — событие того, что транзакция в действительности окажется легитимной;

- F — событие того, что ЭС «определит» транзакцию как мошенническую;

- G — событие того, что ЭС «определит» транзакцию как легитимную

Очевидно, что Fr и Gr — несовместные события; аналогично F и G — несовместные. По этой причине разумно рассматривать четыре вероятности:

Аббревиатуры читаются так:

- tn — true negative

- fn — false negative

- fp — false positive

- tp — true positive

Мы можем рассматривать условные вероятности:

Так же нам будут интересны и «обратные» условные вероятности:

Например вероятность означает следующее:

Какова вероятность того, что транзакция действительно окажется мошеннической, если ЭС «определила» это событие как мошенническое.

Не следует путать с

, которое можно определить словами:

Какова вероятность того, что ЭС «назовёт» транзакцию мошеннической, если данная транзакция действительно мошенническая.

Аналогично можно определить словами и другие условные вероятности.

Вспомним определения

В статистике любят говорить о нулевой гипотезе (H0) и альтернативной (H1) гипотезе. Обычно под нулевой гипотезой определяют «естественное» состояние. В случае фрод-мониторинга «естественным» состоянием является то, что транзакция легитимная. Это действительно разумно, хотя бы по той причине, что количество мошеннических транзакций гораздо меньше количества легитимных.

Поэтому за нулевую гипотезу примем Gr, а за альтернативную Fr.

Ошибки первого (O1) и второго (O2) рода определяются так:

Словами

Ошибка первого рода (O1) — это вероятность того, что ЭС «определит» транзакцию как мошенническую, при условии, что она легитимная.

Ошибка второго рода (O2) — это вероятность того, что ЭС «определит» транзакцию как легитимную, при условии, что она мошенническая.

Замечание: часто ошибку первого рода называют false positives а ошибку второго рода как false negatives. В том числе, таковы определения в википедии. Это верно по сути. Но

и

. Очень многие новички в DataScience делают такую ошибку и путаются.

Полнота (П) и точность (Т) по определению:

Т.е. полнота — это вероятность того, что ЭС «определит» транзакцию мошеннической, при условии, что она действительно мошенническая. А точность — это вероятность того, что транзакция действительно мошенническая, при условии, что ЭС «определила» транзакцию как мошенническую.

Полноту и точность можно выразить через tp, fp, fn следующим образом:

Вывод формул

Выводим тупо в лоб.

Для полноты:

Для точности:

Следует заметить, что именно эти формулы очень частно приводят в качестве определения полноты и точности. Тут вопрос во вкусе. Можно сказать, что квадрат — это прямоугольник, у которого все стороны равны и доказать, что ромб с прямым углом — это квадрат. А можно наоборот. Например, когда я учился в школе, у меня квадрат определяли как ромб с прямым углом и доказывали, что прямоугольник с равными сторонами — это квадрат.

Но все же определение полноты как и точности как T

мне кажется более правильным. Сразу понятно в чем физический смысл этих величин. Понятно, зачем они нужны.

Бизнес-смысл полноты и точности

Предположим, что для Roga & Copyta мы создали систему с полнотой в 80% и точностью в 10%.

Предположим, что без ЭС банк теряет на мошенничестве 1 миллиард тугриков (₮) в год. Это значит, что благодаря ЭС они смогут предотвратить хищение на сумму в 800 миллионов ₮. Останется еще 200 миллионов ₮ — это ущерб банку (или клиентам банка), который не смогла предотвратить ЭС.

А что на счет точности в 10%? Данная величина значит, что из 100 сработок ЭС только 10 будут попадать по цели, а в остальных случаях мы приостановим легитимные транзакции. Хорошо это или плохо?

Во-первых при остановки транзакции банк совершает какие-либо действия. Например звонит клиентам с просьбой подтвердить операции.

Во-вторых заблокировать легитимные транзакции тоже не всегда хорошая идея. Представьте, что вы сидите с девушкой в ресторане, просите счёт, оплачиваете картой… А тут бах… ЭС ошибочно подсчитала что вы — мошенник… Наверное не очень удобно будет перед барышней… Но мы, чтобы не усложнять, пока опустим эту проблему.

Итак, предположим один звонок стоит 1000 ₮. Так же предположим что средний чек хакера у нас составляет 100 тысяч ₮.

Так как мы предотвращаем мошенничества на 800 миллионов ₮, то в среднем у нас будет 8000 правильных мошеннических сработок. Но 8000 — это, судя по точности, лишь 10%; следовательно всего мы позвоним 80000 раз. Умножаем эту цифру на стоимость одного звонка (1000 ₮) и получаем аж 80 миллионов ₮!

Итоговый ущерб в год для банка R&C равен: 200 + 80 = 280 миллионов ₮. Но без ЭС банк терял бы один один миллиард. Следовательно выгода R&C составляет 720 миллионов тугриков.

нюанс

Следует различать полноту и точность по количеству транзакций и по суммам. Это четыре разные величины. Здесь я «смешал все в кучу», что, конечно не верно! ;)) Будем считать что полнота и точность 80% и 10% как по количеству транзакций, так и по денежным суммам.

Бизнес-смысл ошибок первого и второго рода

Ошибка второго рода элементарно выводится через полноту:

Вывод формулы элементарен (см. следующий параграф)

Поэтому что считать — полноту или упущенный фрод (ошибка второго рода) особой разницы не представляет.

А что на счет ошибки первого рода?

Это вероятность того, что ЭС назовёт мошеннической операцией транзакцию, при условии что она легитимная. Проблема в том, что легитимных транзакций существенно больше мошеннических. Есть банки, в которых более 50 платёжных транзакций в секунду… И это совсем не предел.

R&C — банк небольшой, там всего пять платёжных транзакций в секунду. Давайте посчитаем, сколько это в сутки:

В прошлом параграфе мы узнали, что в R&C 80000 сработок в год, это значит что в сутки в среднем 80000 / 365 = 219,17 сработок. Из них только 10% попали в цель (такова точность), то есть 22. Значит остальные — подлинные: 432000 — 22 = 431978.

Так как полнота 80%, то из этих 22 мы только 4.4 будем упускать.

Значит ошибка первого рода:

Слишком маленькая величина! Бизнес не любит такие числа. Так же сложнее, чем для точности высчитать пользу и ущерб для бизнеса. И есть еще одна проблема:

через ошибку первого рода, можно косвенно понять об объемах платёжных операций в банке!

Что касается точности, то такой проблемы нет. Специалисты из отдела безопасности R&C знают об объемах мошенничества. Они узнают о допустимой нагрузке на контактный центр у самой главной девочки + спрашивают руководство банка о желаемой полноте. Зная абсолютную нагрузку, желаемую полноту и объем фрода можно без труда вычислить приемлемую точность. Эти две цифры вписываются в техническое задание (или тендер).

Разработчику выдают выборку из мошеннических транзакций и легитимных. Если выборка репрезентативна, этих данных достаточно.

«Неправильность» точности с точки зрения чистой математики

Если объем транзакций увеличится в два раза, то точность уменьшится. Если объем мошенничества увеличится в два раза, то точность так же будет больше… С ошибкой первого рода такой проблемы нет, поэтому с точки зрения «чистой математики», эта величина гораздо более «правильная»…

Но на практике, если и резко увеличивается объем мошенничества, то как правило это фрод нового типа и ЭС просто не обучена его ловить… Точность останется той же (а вот полнота уменьшиться, т.к. появится фрод, который мы не умеем ловить). Что касается увеличения количества легитимных транзакций — то это увеличение постепенное и никаких «рывков» не будет.

Поэтому на практике точность — замечательный, понятный для бизнеса критерий оценки качества ЭС.

Вывод ошибок первого рода и второго рода из полноты и точности

Но может быть существует изящная формула вывода ошибки первого рода через точность?

Вот с ошибкой второго рода как все красиво:

Вывод формулы

К сожалению с O1 так изящно не получится. Вот отношение через точность (Т) и полноту (П):

Вывод формулы

Эй! Ты что такой ленивый! А ну давай сам попробуй!

Я сегодня плохо спал, Павел! Ну покажи!

Из и

можно составить выражение:

Откуда следует:

Уже из этого отношения легко получить формулу для O1

Заключение

Точность и полнота «не хуже» и «не лучше» чем ошибки первого и второго рода. Всё зависит от задачи. Мы же не едим столовой ложкой торт, а чайной борщ? Хотя это возможно.

Точность и полнота более понятные критерии качества. Ими легче оперировать. С помощью них просто вычислить предотвращённый ущерб в задаче фрод-мониторинга.

Если вы обнаружили описку или грамматическую ошибку — прошу написать в личку.

В машинном обучении различают оценки качества для задачи классификации и регрессии. Причем оценка задачи классификации часто значительно сложнее, чем оценка регрессии.

Содержание

- 1 Оценки качества классификации

- 1.1 Матрица ошибок (англ. Сonfusion matrix)

- 1.2 Аккуратность (англ. Accuracy)

- 1.3 Точность (англ. Precision)

- 1.4 Полнота (англ. Recall)

- 1.5 F-мера (англ. F-score)

- 1.6 ROC-кривая

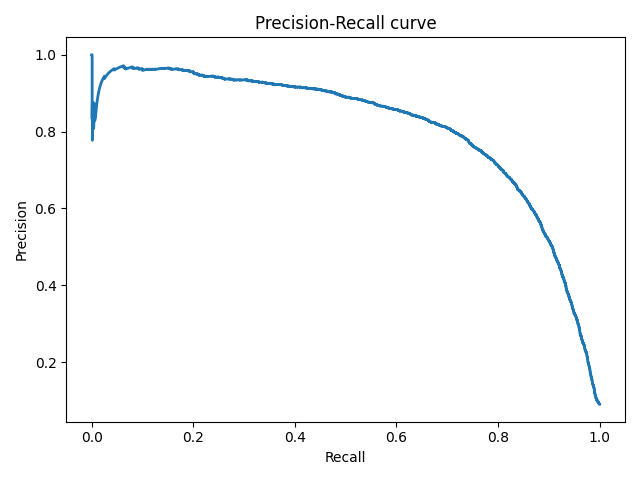

- 1.7 Precison-recall кривая

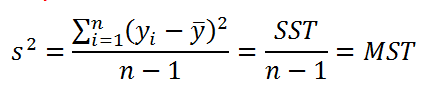

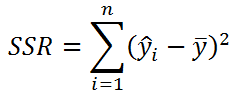

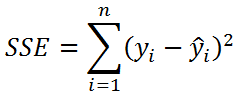

- 2 Оценки качества регрессии

- 2.1 Средняя квадратичная ошибка (англ. Mean Squared Error, MSE)

- 2.2 Cредняя абсолютная ошибка (англ. Mean Absolute Error, MAE)

- 2.3 Коэффициент детерминации

- 2.4 Средняя абсолютная процентная ошибка (англ. Mean Absolute Percentage Error, MAPE)

- 2.5 Корень из средней квадратичной ошибки (англ. Root Mean Squared Error, RMSE)

- 2.6 Cимметричная MAPE (англ. Symmetric MAPE, SMAPE)

- 2.7 Средняя абсолютная масштабированная ошибка (англ. Mean absolute scaled error, MASE)

- 3 Кросс-валидация

- 4 Примечания

- 5 См. также

- 6 Источники информации

Оценки качества классификации

Матрица ошибок (англ. Сonfusion matrix)

Перед переходом к самим метрикам необходимо ввести важную концепцию для описания этих метрик в терминах ошибок классификации — confusion matrix (матрица ошибок).

Допустим, что у нас есть два класса и алгоритм, предсказывающий принадлежность каждого объекта одному из классов.

Рассмотрим пример. Пусть банк использует систему классификации заёмщиков на кредитоспособных и некредитоспособных. При этом первым кредит выдаётся, а вторые получат отказ. Таким образом, обнаружение некредитоспособного заёмщика () можно рассматривать как «сигнал тревоги», сообщающий о возможных рисках.

Любой реальный классификатор совершает ошибки. В нашем случае таких ошибок может быть две:

- Кредитоспособный заёмщик распознается моделью как некредитоспособный и ему отказывается в кредите. Данный случай можно трактовать как «ложную тревогу».

- Некредитоспособный заёмщик распознаётся как кредитоспособный и ему ошибочно выдаётся кредит. Данный случай можно рассматривать как «пропуск цели».

Несложно увидеть, что эти ошибки неравноценны по связанным с ними проблемам. В случае «ложной тревоги» потери банка составят только проценты по невыданному кредиту (только упущенная выгода). В случае «пропуска цели» можно потерять всю сумму выданного кредита. Поэтому системе важнее не допустить «пропуск цели», чем «ложную тревогу».

Поскольку с точки зрения логики задачи нам важнее правильно распознать некредитоспособного заёмщика с меткой , чем ошибиться в распознавании кредитоспособного, будем называть соответствующий исход классификации положительным (заёмщик некредитоспособен), а противоположный — отрицательным (заемщик кредитоспособен ). Тогда возможны следующие исходы классификации:

- Некредитоспособный заёмщик классифицирован как некредитоспособный, т.е. положительный класс распознан как положительный. Наблюдения, для которых это имеет место называются истинно-положительными (True Positive — TP).

- Кредитоспособный заёмщик классифицирован как кредитоспособный, т.е. отрицательный класс распознан как отрицательный. Наблюдения, которых это имеет место, называются истинно отрицательными (True Negative — TN).

- Кредитоспособный заёмщик классифицирован как некредитоспособный, т.е. имела место ошибка, в результате которой отрицательный класс был распознан как положительный. Наблюдения, для которых был получен такой исход классификации, называются ложно-положительными (False Positive — FP), а ошибка классификации называется ошибкой I рода.

- Некредитоспособный заёмщик распознан как кредитоспособный, т.е. имела место ошибка, в результате которой положительный класс был распознан как отрицательный. Наблюдения, для которых был получен такой исход классификации, называются ложно-отрицательными (False Negative — FN), а ошибка классификации называется ошибкой II рода.

Таким образом, ошибка I рода, или ложно-положительный исход классификации, имеет место, когда отрицательное наблюдение распознано моделью как положительное. Ошибкой II рода, или ложно-отрицательным исходом классификации, называют случай, когда положительное наблюдение распознано как отрицательное. Поясним это с помощью матрицы ошибок классификации:

-

Истинно-положительный (True Positive — TP) Ложно-положительный (False Positive — FP) Ложно-отрицательный (False Negative — FN) Истинно-отрицательный (True Negative — TN)

Здесь — это ответ алгоритма на объекте, а — истинная метка класса на этом объекте.

Таким образом, ошибки классификации бывают двух видов: False Negative (FN) и False Positive (FP).

P означает что классификатор определяет класс объекта как положительный (N — отрицательный). T значит что класс предсказан правильно (соответственно F — неправильно). Каждая строка в матрице ошибок представляет спрогнозированный класс, а каждый столбец — фактический класс.

# код для матрицы ошибок # Пример классификатора, способного проводить различие между всего лишь двумя # классами, "пятерка" и "не пятерка" из набора рукописных цифр MNIST import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.metrics import confusion_matrix from sklearn.linear_model import SGDClassifier mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (англ. Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распозновать пятерки на целом обучающем наборе # Для расчета матрицы ошибок сначала понадобится иметь набор прогнозов, чтобы их можно было сравнивать с фактическими целями y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) print(confusion_matrix(y_train_5, y_train_pred)) # array([[53892, 687], # [ 1891, 3530]])

Безупречный классификатор имел бы только истинно-положительные и истинно отрицательные классификации, так что его матрица ошибок содержала бы ненулевые значения только на своей главной диагонали (от левого верхнего до правого нижнего угла):

import numpy as np

from sklearn.datasets import fetch_openml

from sklearn.metrics import confusion_matrix

mnist = fetch_openml('mnist_784', version=1)

X, y = mnist["data"], mnist["target"]

y = y.astype(np.uint8)

X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:]

y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки

y_test_5 = (y_test == 5)

y_train_perfect_predictions = y_train_5 # притворись, что мы достигли совершенства

print(confusion_matrix(y_train_5, y_train_perfect_predictions))

# array([[54579, 0],

# [ 0, 5421]])

Аккуратность (англ. Accuracy)

Интуитивно понятной, очевидной и почти неиспользуемой метрикой является accuracy — доля правильных ответов алгоритма:

Эта метрика бесполезна в задачах с неравными классами, что как вариант можно исправить с помощью алгоритмов сэмплирования и это легко показать на примере.

Допустим, мы хотим оценить работу спам-фильтра почты. У нас есть 100 не-спам писем, 90 из которых наш классификатор определил верно (True Negative = 90, False Positive = 10), и 10 спам-писем, 5 из которых классификатор также определил верно (True Positive = 5, False Negative = 5).

Тогда accuracy:

Однако если мы просто будем предсказывать все письма как не-спам, то получим более высокую аккуратность:

При этом, наша модель совершенно не обладает никакой предсказательной силой, так как изначально мы хотели определять письма со спамом. Преодолеть это нам поможет переход с общей для всех классов метрики к отдельным показателям качества классов.

# код для для подсчета аккуратности: # Пример классификатора, способного проводить различие между всего лишь двумя # классами, "пятерка" и "не пятерка" из набора рукописных цифр MNIST import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.metrics import accuracy_score from sklearn.linear_model import SGDClassifier mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распозновать пятерки на целом обучающем наборе y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) # print(confusion_matrix(y_train_5, y_train_pred)) # array([[53892, 687] # [ 1891, 3530]]) print(accuracy_score(y_train_5, y_train_pred)) # == (53892 + 3530) / (53892 + 3530 + 1891 +687) # 0.9570333333333333

Точность (англ. Precision)

Точностью (precision) называется доля правильных ответов модели в пределах класса — это доля объектов действительно принадлежащих данному классу относительно всех объектов которые система отнесла к этому классу.

Именно введение precision не позволяет нам записывать все объекты в один класс, так как в этом случае мы получаем рост уровня False Positive.

Полнота (англ. Recall)

Полнота — это доля истинно положительных классификаций. Полнота показывает, какую долю объектов, реально относящихся к положительному классу, мы предсказали верно.

Полнота (recall) демонстрирует способность алгоритма обнаруживать данный класс вообще.

Имея матрицу ошибок, очень просто можно вычислить точность и полноту для каждого класса. Точность (precision) равняется отношению соответствующего диагонального элемента матрицы и суммы всей строки класса. Полнота (recall) — отношению диагонального элемента матрицы и суммы всего столбца класса. Формально:

Результирующая точность классификатора рассчитывается как арифметическое среднее его точности по всем классам. То же самое с полнотой. Технически этот подход называется macro-averaging.

# код для для подсчета точности и полноты: # Пример классификатора, способного проводить различие между всего лишь двумя # классами, "пятерка" и "не пятерка" из набора рукописных цифр MNIST import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.metrics import precision_score, recall_score from sklearn.linear_model import SGDClassifier mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распозновать пятерки на целом обучающем наборе y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) # print(confusion_matrix(y_train_5, y_train_pred)) # array([[53892, 687] # [ 1891, 3530]]) print(precision_score(y_train_5, y_train_pred)) # == 3530 / (3530 + 687) print(recall_score(y_train_5, y_train_pred)) # == 3530 / (3530 + 1891) # 0.8370879772350012 # 0.6511713705958311

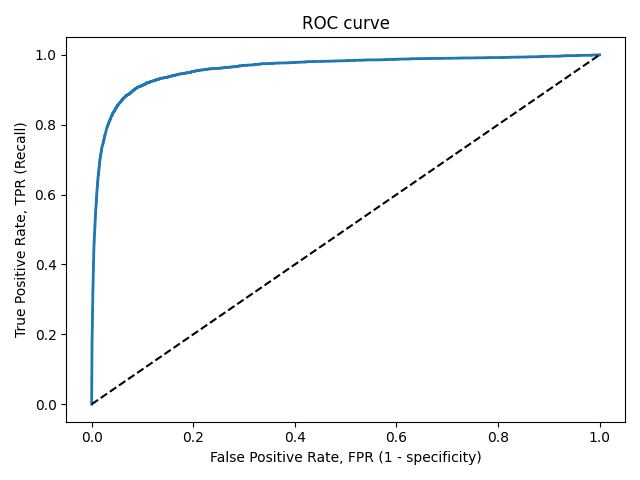

F-мера (англ. F-score)

Precision и recall не зависят, в отличие от accuracy, от соотношения классов и потому применимы в условиях несбалансированных выборок.

Часто в реальной практике стоит задача найти оптимальный (для заказчика) баланс между этими двумя метриками. Понятно что чем выше точность и полнота, тем лучше. Но в реальной жизни максимальная точность и полнота не достижимы одновременно и приходится искать некий баланс. Поэтому, хотелось бы иметь некую метрику которая объединяла бы в себе информацию о точности и полноте нашего алгоритма. В этом случае нам будет проще принимать решение о том какую реализацию запускать в производство (у кого больше тот и круче). Именно такой метрикой является F-мера.

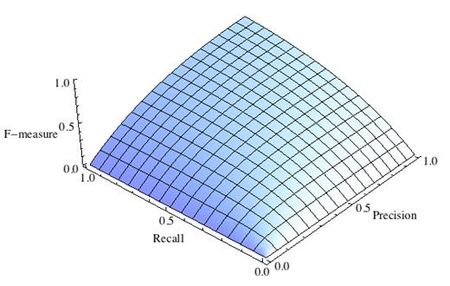

F-мера представляет собой гармоническое среднее между точностью и полнотой. Она стремится к нулю, если точность или полнота стремится к нулю.

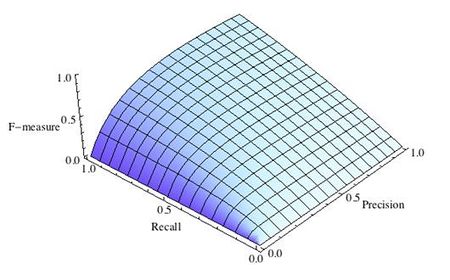

Данная формула придает одинаковый вес точности и полноте, поэтому F-мера будет падать одинаково при уменьшении и точности и полноты. Возможно рассчитать F-меру придав различный вес точности и полноте, если вы осознанно отдаете приоритет одной из этих метрик при разработке алгоритма:

где принимает значения в диапазоне если вы хотите отдать приоритет точности, а при приоритет отдается полноте. При формула сводится к предыдущей и вы получаете сбалансированную F-меру (также ее называют ).

-

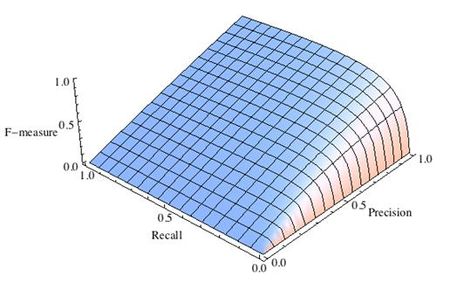

Рис.1 Сбалансированная F-мера,

-

Рис.2 F-мера c приоритетом точности,

-

Рис.3 F-мера c приоритетом полноты,

F-мера достигает максимума при максимальной полноте и точности, и близка к нулю, если один из аргументов близок к нулю.

F-мера является хорошим кандидатом на формальную метрику оценки качества классификатора. Она сводит к одному числу две других основополагающих метрики: точность и полноту. Имея «F-меру» гораздо проще ответить на вопрос: «поменялся алгоритм в лучшую сторону или нет?»

# код для подсчета метрики F-mera: # Пример классификатора, способного проводить различие между всего лишь двумя # классами, "пятерка" и "не пятерка" из набора рукописных цифр MNIST import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.linear_model import SGDClassifier from sklearn.metrics import f1_score mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распознавать пятерки на целом обучающем наборе y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) print(f1_score(y_train_5, y_train_pred)) # 0.7325171197343846

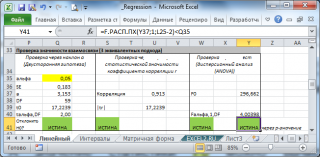

ROC-кривая

Кривая рабочих характеристик (англ. Receiver Operating Characteristics curve).

Используется для анализа поведения классификаторов при различных пороговых значениях.

Позволяет рассмотреть все пороговые значения для данного классификатора.

Показывает долю ложно положительных примеров (англ. false positive rate, FPR) в сравнении с долей истинно положительных примеров (англ. true positive rate, TPR).

Доля FPR — это пропорция отрицательных образцов, которые были некорректно классифицированы как положительные.

- ,

где TNR — доля истинно отрицательных классификаций (англ. Тrие Negative Rate), представляющая собой пропорцию отрицательных образцов, которые были корректно классифицированы как отрицательные.

Доля TNR также называется специфичностью (англ. specificity). Следовательно, ROC-кривая изображает чувствительность (англ. seпsitivity), т.е. полноту, в сравнении с разностью 1 — specificity.

Прямая линия по диагонали представляет ROC-кривую чисто случайного классификатора. Хороший классификатор держится от указанной линии настолько далеко, насколько это

возможно (стремясь к левому верхнему углу).

Один из способов сравнения классификаторов предусматривает измерение площади под кривой (англ. Area Under the Curve — AUC). Безупречный классификатор будет иметь площадь под ROC-кривой (ROC-AUC), равную 1, тогда как чисто случайный классификатор — площадь 0.5.

# Код отрисовки ROC-кривой # На примере классификатора, способного проводить различие между всего лишь двумя классами # "пятерка" и "не пятерка" из набора рукописных цифр MNIST from sklearn.metrics import roc_curve import matplotlib.pyplot as plt import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.linear_model import SGDClassifier mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распозновать пятерки на целом обучающем наборе y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) y_scores = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3, method="decision_function") fpr, tpr, thresholds = roc_curve(y_train_5, y_scores) def plot_roc_curve(fpr, tpr, label=None): plt.plot(fpr, tpr, linewidth=2, label=label) plt.plot([0, 1], [0, 1], 'k--') # dashed diagonal plt.xlabel('False Positive Rate, FPR (1 - specificity)') plt.ylabel('True Positive Rate, TPR (Recall)') plt.title('ROC curve') plt.savefig("ROC.png") plot_roc_curve(fpr, tpr) plt.show()

Precison-recall кривая

Чувствительность к соотношению классов.

Рассмотрим задачу выделения математических статей из множества научных статей. Допустим, что всего имеется 1.000.100 статей, из которых лишь 100 относятся к математике. Если нам удастся построить алгоритм , идеально решающий задачу, то его TPR будет равен единице, а FPR — нулю. Рассмотрим теперь плохой алгоритм, дающий положительный ответ на 95 математических и 50.000 нематематических статьях. Такой алгоритм совершенно бесполезен, но при этом имеет TPR = 0.95 и FPR = 0.05, что крайне близко к показателям идеального алгоритма.

Таким образом, если положительный класс существенно меньше по размеру, то AUC-ROC может давать неадекватную оценку качества работы алгоритма, поскольку измеряет долю неверно принятых объектов относительно общего числа отрицательных. Так, алгоритм , помещающий 100 релевантных документов на позиции с 50.001-й по 50.101-ю, будет иметь AUC-ROC 0.95.

Precison-recall (PR) кривая. Избавиться от указанной проблемы с несбалансированными классами можно, перейдя от ROC-кривой к PR-кривой. Она определяется аналогично ROC-кривой, только по осям откладываются не FPR и TPR, а полнота (по оси абсцисс) и точность (по оси ординат). Критерием качества семейства алгоритмов выступает площадь под PR-кривой (англ. Area Under the Curve — AUC-PR)

# Код отрисовки Precison-recall кривой # На примере классификатора, способного проводить различие между всего лишь двумя классами # "пятерка" и "не пятерка" из набора рукописных цифр MNIST from sklearn.metrics import precision_recall_curve import matplotlib.pyplot as plt import numpy as np from sklearn.datasets import fetch_openml from sklearn.model_selection import cross_val_predict from sklearn.linear_model import SGDClassifier mnist = fetch_openml('mnist_784', version=1) X, y = mnist["data"], mnist["target"] y = y.astype(np.uint8) X_train, X_test, y_train, y_test = X[:60000], X[60000:], y[:60000], y[60000:] y_train_5 = (y_train == 5) # True для всех пятерок, False для в сех остальных цифр. Задача опознать пятерки y_test_5 = (y_test == 5) sgd_clf = SGDClassifier(random_state=42) # классификатор на основе метода стохастического градиентного спуска (Stochastic Gradient Descent SGD) sgd_clf.fit(X_train, y_train_5) # обучаем классификатор распозновать пятерки на целом обучающем наборе y_train_pred = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3) y_scores = cross_val_predict(sgd_clf, X_train, y_train_5, cv=3, method="decision_function") precisions, recalls, thresholds = precision_recall_curve(y_train_5, y_scores) def plot_precision_recall_vs_threshold(precisions, recalls, thresholds): plt.plot(recalls, precisions, linewidth=2) plt.xlabel('Recall') plt.ylabel('Precision') plt.title('Precision-Recall curve') plt.savefig("Precision_Recall_curve.png") plot_precision_recall_vs_threshold(precisions, recalls, thresholds) plt.show()

Оценки качества регрессии

Наиболее типичными мерами качества в задачах регрессии являются

Средняя квадратичная ошибка (англ. Mean Squared Error, MSE)

MSE применяется в ситуациях, когда нам надо подчеркнуть большие ошибки и выбрать модель, которая дает меньше больших ошибок прогноза. Грубые ошибки становятся заметнее за счет того, что ошибку прогноза мы возводим в квадрат. И модель, которая дает нам меньшее значение среднеквадратической ошибки, можно сказать, что что у этой модели меньше грубых ошибок.

- и

Cредняя абсолютная ошибка (англ. Mean Absolute Error, MAE)

Среднеквадратичный функционал сильнее штрафует за большие отклонения по сравнению со среднеабсолютным, и поэтому более чувствителен к выбросам. При использовании любого из этих двух функционалов может быть полезно проанализировать, какие объекты вносят наибольший вклад в общую ошибку — не исключено, что на этих объектах была допущена ошибка при вычислении признаков или целевой величины.

Среднеквадратичная ошибка подходит для сравнения двух моделей или для контроля качества во время обучения, но не позволяет сделать выводов о том, на сколько хорошо данная модель решает задачу. Например, MSE = 10 является очень плохим показателем, если целевая переменная принимает значения от 0 до 1, и очень хорошим, если целевая переменная лежит в интервале (10000, 100000). В таких ситуациях вместо среднеквадратичной ошибки полезно использовать коэффициент детерминации —

Коэффициент детерминации

Коэффициент детерминации измеряет долю дисперсии, объясненную моделью, в общей дисперсии целевой переменной. Фактически, данная мера качества — это нормированная среднеквадратичная ошибка. Если она близка к единице, то модель хорошо объясняет данные, если же она близка к нулю, то прогнозы сопоставимы по качеству с константным предсказанием.

Средняя абсолютная процентная ошибка (англ. Mean Absolute Percentage Error, MAPE)

Это коэффициент, не имеющий размерности, с очень простой интерпретацией. Его можно измерять в долях или процентах. Если у вас получилось, например, что MAPE=11.4%, то это говорит о том, что ошибка составила 11,4% от фактических значений.

Основная проблема данной ошибки — нестабильность.

Корень из средней квадратичной ошибки (англ. Root Mean Squared Error, RMSE)

Примерно такая же проблема, как и в MAPE: так как каждое отклонение возводится в квадрат, любое небольшое отклонение может значительно повлиять на показатель ошибки. Стоит отметить, что существует также ошибка MSE, из которой RMSE как раз и получается путем извлечения корня.

Cимметричная MAPE (англ. Symmetric MAPE, SMAPE)

Средняя абсолютная масштабированная ошибка (англ. Mean absolute scaled error, MASE)

MASE является очень хорошим вариантом для расчета точности, так как сама ошибка не зависит от масштабов данных и является симметричной: то есть положительные и отрицательные отклонения от факта рассматриваются в равной степени.

Обратите внимание, что в MASE мы имеем дело с двумя суммами: та, что в числителе, соответствует тестовой выборке, та, что в знаменателе — обучающей. Вторая фактически представляет собой среднюю абсолютную ошибку прогноза. Она же соответствует среднему абсолютному отклонению ряда в первых разностях. Эта величина, по сути, показывает, насколько обучающая выборка предсказуема. Она может быть равна нулю только в том случае, когда все значения в обучающей выборке равны друг другу, что соответствует отсутствию каких-либо изменений в ряде данных, ситуации на практике почти невозможной. Кроме того, если ряд имеет тенденцию к росту либо снижению, его первые разности будут колебаться около некоторого фиксированного уровня. В результате этого по разным рядам с разной структурой, знаменатели будут более-менее сопоставимыми. Всё это, конечно же, является очевидными плюсами MASE, так как позволяет складывать разные значения по разным рядам и получать несмещённые оценки.

Недостаток MASE в том, что её тяжело интерпретировать. Например, MASE=1.21 ни о чём, по сути, не говорит. Это просто означает, что ошибка прогноза оказалась в 1.21 раза выше среднего абсолютного отклонения ряда в первых разностях, и ничего более.

Кросс-валидация

Хороший способ оценки модели предусматривает применение кросс-валидации (cкользящего контроля или перекрестной проверки).

В этом случае фиксируется некоторое множество разбиений исходной выборки на две подвыборки: обучающую и контрольную. Для каждого разбиения выполняется настройка алгоритма по обучающей подвыборке, затем оценивается его средняя ошибка на объектах контрольной подвыборки. Оценкой скользящего контроля называется средняя по всем разбиениям величина ошибки на контрольных подвыборках.

Примечания

- [1] Лекция «Оценивание качества» на www.coursera.org

- [2] Лекция на www.stepik.org о кросвалидации

- [3] Лекция на www.stepik.org о метриках качества, Precison и Recall

- [4] Лекция на www.stepik.org о метриках качества, F-мера

- [5] Лекция на www.stepik.org о метриках качества, примеры

См. также

- Оценка качества в задаче кластеризации

- Кросс-валидация

Источники информации

- [6] Соколов Е.А. Лекция линейная регрессия

- [7] — Дьяконов А. Функции ошибки / функционалы качества

- [8] — Оценка качества прогнозных моделей

- [9] — HeinzBr Ошибка прогнозирования: виды, формулы, примеры

- [10] — egor_labintcev Метрики в задачах машинного обучения

- [11] — grossu Методы оценки качества прогноза

- [12] — К.В.Воронцов, Классификация

- [13] — К.В.Воронцов, Скользящий контроль

Ошибки первого рода (англ. type I errors, α errors, false positives) и ошибки второго рода (англ. type II errors, β errors, false negatives) в математической статистике — это ключевые понятия задач проверки статистических гипотез. Тем не менее, данные понятия часто используются и в других областях, когда речь идёт о принятии «бинарного» решения (да/нет) на основе некоего критерия (теста, проверки, измерения), который с некоторой вероятностью может давать ложный результат.

Содержание

- 1 Определения

- 2 О смысле ошибок первого и второго рода

- 3 Вероятности ошибок (уровень значимости и мощность)

- 4 Примеры использования

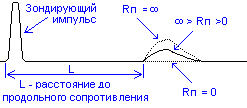

- 4.1 Радиолокация

- 4.2 Компьютеры

- 4.2.1 Компьютерная безопасность

- 4.2.2 Фильтрация спама

- 4.2.3 Вредоносное программное обеспечение

- 4.2.4 Поиск в компьютерных базах данных

- 4.2.5 Оптическое распознавание текстов (OCR)

- 4.2.6 Досмотр пассажиров и багажа

- 4.2.7 Биометрия

- 4.3 Массовая медицинская диагностика (скрининг)

- 4.4 Медицинское тестирование

- 4.5 Исследования сверхъестественных явлений

- 5 См. также

- 6 Примечания

Определения

Пусть дана выборка

где

,

сопоставляющий каждой реализации выборки

- Распределение

выборки

соответствует гипотезе

, и она точно определена статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, но она неверно отвергнута статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, и она точно определена статистическим критерием, то есть

.

- Распределение

выборки

соответствует гипотезе

, но она неверно отвергнута статистическим критерием, то есть

.

Во втором и четвертом случае говорят, что произошла статистическая ошибка, и её называют ошибкой первого и второго рода соответственно. [1][2]

| Верная гипотеза | |||

|---|---|---|---|

|

|

||

| Результат применения критерия |

|

верно принята верно принята |

неверно принята неверно принята (Ошибка второго рода) |

|

неверно отвергнута неверно отвергнута (Ошибка первого рода) |

верно отвергнута верно отвергнута |

О смысле ошибок первого и второго рода

Как видно из вышеприведённого определения, ошибки первого и второго рода являются взаимно-симметричными, то есть если поменять местами гипотезы

С учётом этого ошибку первого рода часто называют ложной тревогой, ложным срабатыванием или ложноположительным срабатыванием — например, анализ крови показал наличие заболевания, хотя на самом деле человек здоров, или металлодетектор выдал сигнал тревоги, сработав на металлическую пряжку ремня. Слово «положительный» в данном случае не имеет отношения к желательности или нежелательности самого события.

Термин широко используется в медицине. Например, тесты, предназначенные для диагностики заболеваний, иногда дают положительный результат (т.е. показывают наличие заболевания у пациента), когда на самом деле пациент этим заболеванием не страдает. Такой результат называется ложноположительным.

В других областях обычно используют словосочетания со схожим смыслом, например, «ложное срабатывание», «ложная тревога» и т.п. В информационных технологиях часто используют английский термин false positive без перевода.

Из-за возможности ложных срабатываний не удаётся полностью автоматизировать борьбу со многими видами угроз. Как правило, вероятность ложного срабатывания коррелирует с вероятностью пропуска события (ошибки второго рода). То есть: чем более чувствительна система, тем больше опасных событий она детектирует и, следовательно, предотвращает. Но при повышении чувствительности неизбежно вырастает и вероятность ложных срабатываний. Поэтому чересчур чувствительно (параноидально) настроенная система защиты может выродиться в свою противоположность и привести к тому, что побочный вред от неё будет превышать пользу.

Соответственно, ошибку второго рода иногда называют пропуском события или ложноотрицательным срабатыванием — человек болен, но анализ крови этого не показал, или у пассажира имеется холодное оружие, но рамка металлодетектора его не обнаружила (например, из-за того, что чувствительность рамки отрегулирована на обнаружение только очень массивных металлических предметов).

Слово «отрицательный» в данном случае не имеет отношения к желательности или нежелательности самого события.

Термин широко используется в медицине. Например, тесты, предназначенные для диагностики заболеваний, иногда дают отрицательный результат (т.е. показывают отсутствие заболевания у пациента), когда на самом деле пациент страдает этим заболеванием. Такой результат называется ложноотрицательным.

В других областях обычно используют словосочетания со схожим смыслом, например, «пропуск события», и т.п. В информационных технологиях часто используют английский термин false negative без перевода.

Степень чувствительности системы защиты должна представлять собой компромисс между вероятностью ошибок первого и второго рода. Где именно находится точка баланса, зависит от оценки рисков обоих видов ошибок.

Вероятности ошибок (уровень значимости и мощность)

Вероятность ошибки первого рода при проверке статистических гипотез называют уровнем значимости и обычно обозначают греческой буквой

Вероятность ошибки второго рода не имеет какого-то особого общепринятого названия, на письме обозначается греческой буквой

Обе эти характеристики обычно вычисляются с помощью так называемой функции мощности критерия. В частности, вероятность ошибки первого рода есть функция мощности, вычисленная при нулевой гипотезе. Для критериев, основанных на выборке фиксированного объема, вероятность ошибки второго рода есть единица минус функция мощности, вычисленная в предположении, что распределение наблюдений соответствует альтернативной гипотезе. Для последовательных критериев это также верно, если критерий останавливается с вероятностью единица (при данном распределении из альтернативы).