В статистике регрессия — это метод, который можно использовать для анализа взаимосвязи между переменными-предикторами и переменной-откликом.

Когда вы используете программное обеспечение (например, R, SAS, SPSS и т. д.) для выполнения регрессионного анализа, вы получите в качестве выходных данных таблицу регрессии, в которой суммируются результаты регрессии. Важно уметь читать эту таблицу, чтобы понимать результаты регрессионного анализа.

В этом руководстве рассматривается пример регрессионного анализа и дается подробное объяснение того, как читать и интерпретировать выходные данные таблицы регрессии.

Пример регрессии

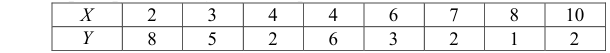

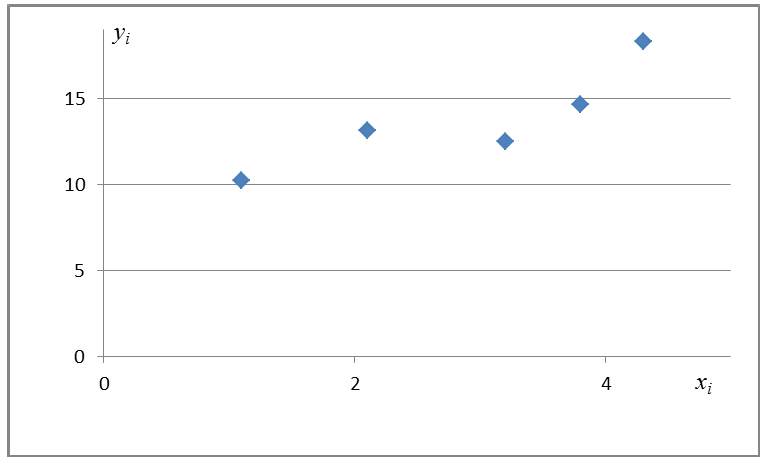

Предположим, у нас есть следующий набор данных, который показывает общее количество часов обучения, общее количество сданных подготовительных экзаменов и итоговый балл за экзамен, полученный для 12 разных студентов:

Чтобы проанализировать взаимосвязь между учебными часами и сданными подготовительными экзаменами и окончательным экзаменационным баллом, который получает студент, мы запускаем множественную линейную регрессию, используя отработанные часы и подготовительные экзамены, взятые в качестве переменных-предикторов, и итоговый экзаменационный балл в качестве переменной ответа.

Мы получаем следующий вывод:

Проверка соответствия модели

В первом разделе показано несколько различных чисел, которые измеряют соответствие регрессионной модели, т. е. насколько хорошо регрессионная модель способна «соответствовать» набору данных.

Вот как интерпретировать каждое из чисел в этом разделе:

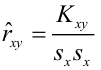

Несколько R

Это коэффициент корреляции.Он измеряет силу линейной зависимости между переменными-предикторами и переменной отклика. R, кратный 1, указывает на идеальную линейную зависимость, тогда как R, кратный 0, указывает на отсутствие какой-либо линейной зависимости. Кратный R — это квадратный корень из R-квадрата (см. ниже).

В этом примере множитель R равен 0,72855 , что указывает на довольно сильную линейную зависимость между предикторами часов обучения и подготовительных экзаменов и итоговой оценкой экзаменационной переменной ответа.

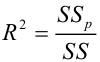

R-квадрат

Его часто записывают как r 2 , а также называют коэффициентом детерминации.Это доля дисперсии переменной отклика, которая может быть объяснена предикторной переменной.

Значение для R-квадрата может варьироваться от 0 до 1. Значение 0 указывает, что переменная отклика вообще не может быть объяснена предикторной переменной. Значение 1 указывает, что переменная отклика может быть полностью объяснена без ошибок с помощью переменной-предиктора.

В этом примере R-квадрат равен 0,5307 , что указывает на то, что 53,07% дисперсии итоговых экзаменационных баллов можно объяснить количеством часов обучения и количеством сданных подготовительных экзаменов.

Связанный: Что такое хорошее значение R-квадрата?

Скорректированный R-квадрат

Это модифицированная версия R-квадрата, которая была скорректирована с учетом количества предикторов в модели. Он всегда ниже R-квадрата. Скорректированный R-квадрат может быть полезен для сравнения соответствия различных моделей регрессии друг другу.

В этом примере скорректированный R-квадрат равен 0,4265.

Стандартная ошибка регрессии

Стандартная ошибка регрессии — это среднее расстояние, на которое наблюдаемые значения отклоняются от линии регрессии. В этом примере наблюдаемые значения отклоняются от линии регрессии в среднем на 7,3267 единиц.

Связанный: Понимание стандартной ошибки регрессии

Наблюдения

Это просто количество наблюдений в нашем наборе данных. В этом примере общее количество наблюдений равно 12 .

Тестирование общей значимости регрессионной модели

В следующем разделе показаны степени свободы, сумма квадратов, средние квадраты, F-статистика и общая значимость регрессионной модели.

Вот как интерпретировать каждое из чисел в этом разделе:

Степени свободы регрессии

Это число равно: количеству коэффициентов регрессии — 1. В этом примере у нас есть член пересечения и две переменные-предикторы, поэтому у нас всего три коэффициента регрессии, что означает, что степени свободы регрессии равны 3 — 1 = 2 .

Всего степеней свободы

Это число равно: количество наблюдений – 1. В данном примере у нас 12 наблюдений, поэтому общее количество степеней свободы 12 – 1 = 11 .

Остаточные степени свободы

Это число равно: общая df – регрессионная df.В этом примере остаточные степени свободы 11 – 2 = 9 .

Средние квадраты

Средние квадраты регрессии рассчитываются как регрессия SS / регрессия df.В этом примере регрессия MS = 546,53308/2 = 273,2665 .

Остаточные средние квадраты вычисляются как остаточный SS / остаточный df.В этом примере остаточная MS = 483,1335/9 = 53,68151 .

F Статистика

Статистика f рассчитывается как регрессия MS/остаточная MS. Эта статистика показывает, обеспечивает ли регрессионная модель лучшее соответствие данным, чем модель, которая не содержит независимых переменных.

По сути, он проверяет, полезна ли регрессионная модель в целом. Как правило, если ни одна из переменных-предикторов в модели не является статистически значимой, общая F-статистика также не является статистически значимой.

В этом примере статистика F равна 273,2665/53,68151 = 5,09 .

Значение F (P-значение)

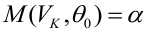

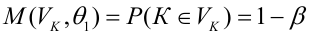

Последнее значение в таблице — это p-значение, связанное со статистикой F. Чтобы увидеть, значима ли общая модель регрессии, вы можете сравнить p-значение с уровнем значимости; распространенные варианты: 0,01, 0,05 и 0,10.

Если p-значение меньше уровня значимости, имеется достаточно доказательств, чтобы сделать вывод о том, что регрессионная модель лучше соответствует данным, чем модель без переменных-предикторов. Этот вывод хорош, потому что он означает, что переменные-предикторы в модели действительно улучшают соответствие модели.

В этом примере p-значение равно 0,033 , что меньше обычного уровня значимости 0,05. Это указывает на то, что регрессионная модель в целом статистически значима, т. е. модель лучше соответствует данным, чем модель без переменных-предикторов.

Тестирование общей значимости регрессионной модели

В последнем разделе показаны оценки коэффициентов, стандартная ошибка оценок, t-stat, p-значения и доверительные интервалы для каждого термина в регрессионной модели.

Вот как интерпретировать каждое из чисел в этом разделе:

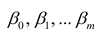

Коэффициенты

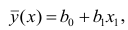

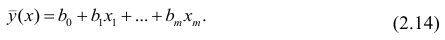

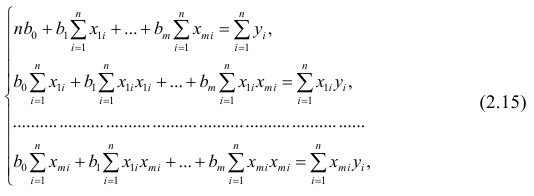

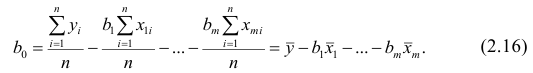

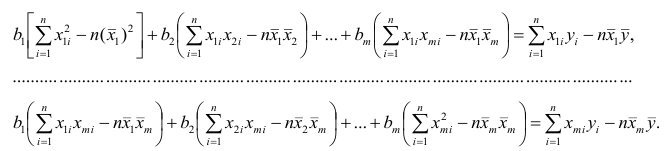

Коэффициенты дают нам числа, необходимые для записи оценочного уравнения регрессии:

у шляпа знак равно б 0 + б 1 Икс 1 + б 2 Икс 2 .

В этом примере расчетное уравнение регрессии имеет вид:

итоговый балл за экзамен = 66,99 + 1,299 (часы обучения) + 1,117 (подготовительные экзамены)

Каждый отдельный коэффициент интерпретируется как среднее увеличение переменной отклика на каждую единицу увеличения данной переменной-предиктора при условии, что все остальные переменные-предикторы остаются постоянными. Например, для каждого дополнительного часа обучения среднее ожидаемое увеличение итогового экзаменационного балла составляет 1,299 балла при условии, что количество сданных подготовительных экзаменов остается постоянным.

Перехват интерпретируется как ожидаемый средний итоговый балл за экзамен для студента, который учится ноль часов и не сдает подготовительных экзаменов. В этом примере ожидается, что учащийся наберет 66,99 балла, если он будет заниматься ноль часов и не сдавать подготовительных экзаменов. Однако будьте осторожны при интерпретации перехвата выходных данных регрессии, потому что это не всегда имеет смысл.

Например, в некоторых случаях точка пересечения может оказаться отрицательным числом, что часто не имеет очевидной интерпретации. Это не означает, что модель неверна, это просто означает, что перехват сам по себе не должен интерпретироваться как означающий что-либо.

Стандартная ошибка, t-статистика и p-значения

Стандартная ошибка — это мера неопределенности оценки коэффициента для каждой переменной.

t-stat — это просто коэффициент, деленный на стандартную ошибку. Например, t-stat для часов обучения составляет 1,299 / 0,417 = 3,117.

В следующем столбце показано значение p, связанное с t-stat. Это число говорит нам, является ли данная переменная отклика значимой в модели. В этом примере мы видим, что значение p для часов обучения равно 0,012, а значение p для подготовительных экзаменов равно 0,304. Это указывает на то, что количество учебных часов является важным предиктором итогового экзаменационного балла, а количество подготовительных экзаменов — нет.

Доверительный интервал для оценок коэффициентов

В последних двух столбцах таблицы представлены нижняя и верхняя границы 95% доверительного интервала для оценок коэффициентов.

Например, оценка коэффициента для часов обучения составляет 1,299, но вокруг этой оценки есть некоторая неопределенность. Мы никогда не можем знать наверняка, является ли это точным коэффициентом. Таким образом, 95-процентный доверительный интервал дает нам диапазон вероятных значений истинного коэффициента.

В этом случае 95% доверительный интервал для часов обучения составляет (0,356, 2,24). Обратите внимание, что этот доверительный интервал не содержит числа «0», что означает, что мы вполне уверены, что истинное значение коэффициента часов обучения не равно нулю, т. е. является положительным числом.

Напротив, 95% доверительный интервал для Prep Exams составляет (-1,201, 3,436). Обратите внимание, что этот доверительный интервал действительно содержит число «0», что означает, что истинное значение коэффициента подготовительных экзаменов может быть равно нулю, т. е. несущественно для прогнозирования результатов итоговых экзаменов.

Дополнительные ресурсы

Понимание нулевой гипотезы для линейной регрессии

Понимание F-теста общей значимости в регрессии

Как сообщить о результатах регрессии

Подготовка к

выполнению лабораторной работы.

1. По учебнику изучить темы:

«Статистические

методы анализа связи»

2.

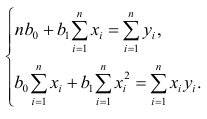

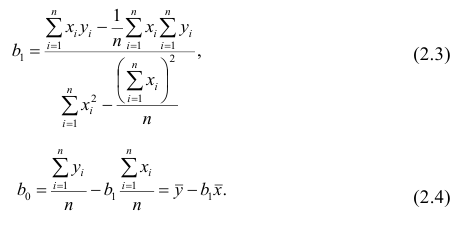

Уметь рассчитывать параметры уравнения

регрессии и линейного уравнения тренда,

находить табличные значения t-статистики

и F-критерия,

делать декомпозицию ряда динамики.

3.

Подготовить выборку по 5 признакам,

объемом не менее 50 единиц (например,

информация о деятельности по 50 предприятий

по 5 показателям: объем производства,

численность занятых, стоимость основных

средств, кредиторская задолженность и

балансовая прибыль). Такую информацию

можно найти в статистических сборниках,

internet,

экономической периодике. Можно

использовать данные из лабораторной

работы 1.

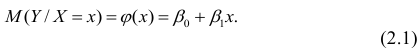

Задание 1.

-

Построить

уравнение парной линейной регрессии. -

Измерить

тесноту связи. -

Проверить

на значимость коэффициенты регрессии

и регрессионную модель.

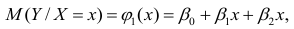

Задание 2.

-

Построить

уравнение множественной регрессии. -

Измерить

тесноту связи. -

Проверить

на значимость коэффициенты множественной

регрессии и регрессионную модель. -

Улучшить

регрессионную модель путем удаления

из модели факторов, не имеющих значимого

влияния на результат.

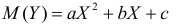

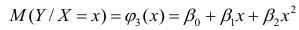

Задание

3.

-

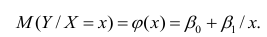

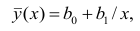

Построить

уравнение парной регрессии нелинейной

формы.

Выполнение

задания 1 в

ППП MS

Excel

2007.

Ход

работы:

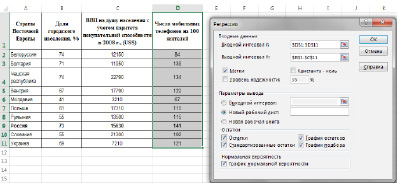

Определите

фактор, оказывающий влияние (x)

и результативный признак (y).

Для построения уравнения регрессии

воспользуемся Пакетом анализа:

Данные – Анализ данных – Регрессия.

В

окне Регрессия:

Входной

интервал Х – это столбец данных,

определенных вами как фактор (причина);

Входной интервал Y

– это столбец данных, определенных вами

как результат. Выходной интервал –

несколько чистых ячеек на том же листе,

где находятся исходные данные, или на

отдельном листе. В результате получаем

таблицу расчетов (см. пример в таблице

2).

Таблица

2. «Вывод итогов»

-

Регрессионная

статистикаМножественный

R0,502621

R-квадрат

0,252628

Нормированный

R-квадрат0,159206

Стандартная

ошибка25,16016

Наблюдения

50

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

1

1711,83

1711,83

2,704169

0,138707

Остаток

48

5064,27

633,0337

Итого

49

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

18,37277

19,30663

0,95163

0,369146

Переменная

x10,533713

0,324557

1,644436

0,138707

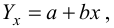

1.

Из таблицы берем значения коэффициентов

регрессии и получаем уравнение : у =

18,37277 + 0,533713х1 (коэффициенты при y

– пересечении и переменной x1).

2.

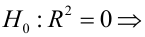

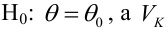

Проверка на значимость заключается в

проверке гипотезы Н0:а0=0,т.е.

проверке гипотезы о статистической

незначимости проверяемого параметра

а0, другими словами, проверки

вывода о том, что проверяемый параметр

сформировался под влиянием случайных

причин, а не в результате достаточно

сильного влияния, т.е. закономерности.

В таблице уровень значимости (Р-значение

t-статистики при

Y-пересечении) равен

0,369146, что значительно превышает уровень

0,05 или 5%. Делаем вывод о том, что гипотезу

о незначимости коэффициента регрессии

а0 принимаем. Аналогично проверяем

гипотезу о незначимости параметра b1

(при переменной x1)

и гипотезу о незначимости всей

регрессионной модели (по уровню значимости

F).

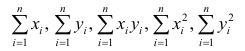

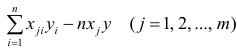

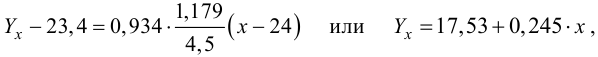

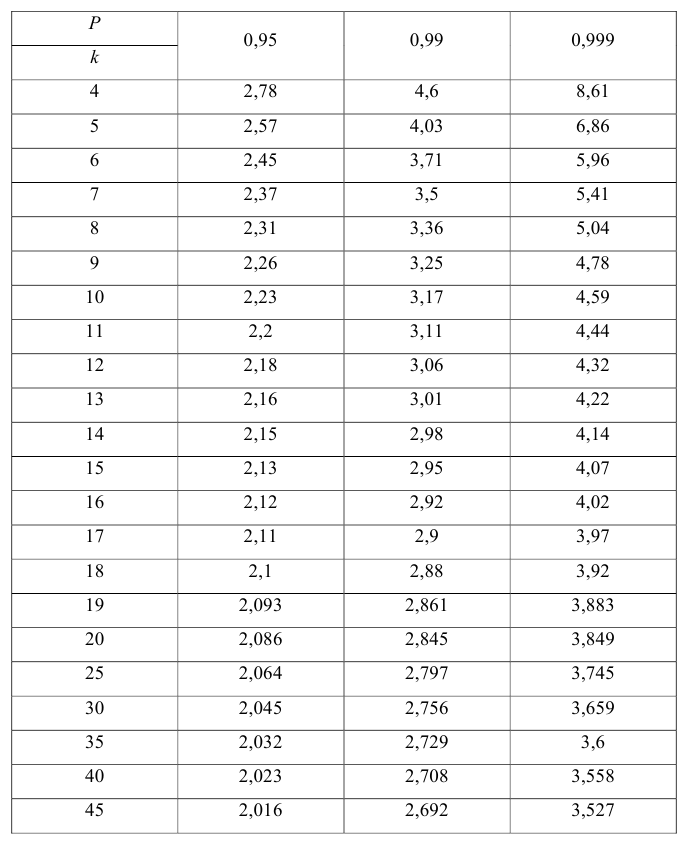

Проверку

значимости коэффициентов уравнения

можно сделать по значению t-статистики,

которое сравнивается с пороговым

значением, зафиксированным в таблице

t-статистики. Для коэффициента

а0 значение t-статистики

равно 0,951653, для коэффициента b1

значение t—статистики

равно 1,644436. Сравниваем каждое из этих

значений с пороговым значением. Если

пороговое значение t-статистики

меньше, чем в данной модели, проверяемый

коэффициент уравнения значим и наоборот.

Пороговое значение найдете в таблице

значений t-статистики.

Пороговое значение находим в таблице

в зависимости от выбранного уровня

значимости и числа степеней свободы,

рассчитанного по формуле:

k

= n – 3

k

— число степеней свободы:

n

— число наблюдений.

Выбранный

уровень значимости указывает вероятность

ошибки, т.е. при уровне значимости 0,05

проверяемый коэффициент уравнения

регрессии считается значимым с

вероятностью (1 – 0,05) или 95%; при уровне

значимости 0,01 проверяемый коэффициент

уравнения регрессии считается значимым

с вероятностью (1 – 0,01) или 99%.

Возможен

и другой способ проверки. В таблице 2,

кроме значений t-статистики,

дан уровень значимости t-статистики

( графа «Р – Значение»). Если уровень

значимости, приведенный в таблице, не

превышает 0,05 (5%), делаем вывод, то

проверяемый коэффициент значим и

наоборот. Кроме того, уровень значимости

может быть указан более точно, чем больше

или меньше 0,05. Так, «Р – Значение»

равное 0,369146 говорит о том, уровень ошибки

при проверке гипотезы о незначимости

коэффициента а0 уравнения регрессии

равен 0,369146 (36,92%), а для коэффициента b1

– 0,138707 (13,87%). Поскольку оба значения

ошибки гораздо больше 5%, гипотеза о

незначимости коэффициентов уравнения,

следовательно и самого уравнения

регрессии, принимается. Коэффициент a0

может быть принят лишь с вероятностью

(1–0,369146) или 63%, коэффициент b1

– с вероятностью (1-0,138707) или 88%.

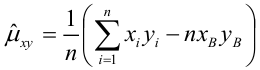

3.Оценку

тесноты связи делаем по R

– квадрат.

R

– квадрат измеряет тесноту связи

через отношение дисперсий результативного

признака. Чем ближе R

–квадрат к 0, тем слабее связь между

x и y, чем

ближе R –квадрат

с 1, тем сильнее связь.

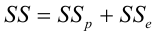

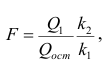

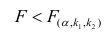

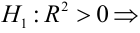

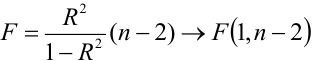

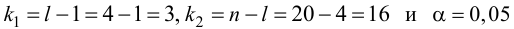

4.

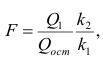

Проверка на значимость всей регрессионной

модели, т.е. уравнения регрессии и

коэффициента тесноты связи, проводим

по F-критерию.

Берем F-критерий из

таблицы 2 и сравниваем с пороговым

значением из таблицы «Значения

F-критерия». Если

пороговое значение F-критерия

меньше, чем в данном примере (2,704169),

проверяемая регрессионная модель

значима и наоборот. Пороговое значение

определяется в зависимости от выбранного

уровня значимости и числа степеней

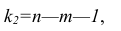

свободы (k1 и k2),

рассчитанных по формулам:

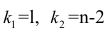

k1

= n– 3

k2

= n-m

где

k1 и k2—

число степеней свободы;

n

— число наблюдений;

m

– число параметров уравнения регрессии,

для парной регрессии равно 2.

Второй

вариант проверки – это определение

вероятности принятия гипотезы о

незначимости регрессионной модели по

уровню “Значимость F”,

равное в этом примере 0,138707 или 13,87%.

Данное значение, говорит о том, что

модель незначима.

Выполнение

задания 2 в ППП MS

Excel 2007.

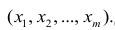

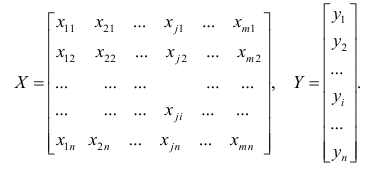

Определите

факторы, оказывающие влияние и обозначьте

их (x1,x2,…..xk).

Определите результативный признак (y).

Для построения уравнения регрессии

воспользуемся Пакетом анализа ППП

Ехсеl: Данные – Анализ

данных – Регрессия.

В

окне Регрессия:

Входной

интервал Х – это столбцы данных,

определенных вами как факторы (выделяются

единым массивом); Входной интервал Y

– это столбец данных, определенных вами

как результат. Выходной интервал –

несколько чистых ячеек на том же листе,

где находятся исходные данные, или на

отдельном листе. В результате получаем

таблицу расчетов (см. пример в таблице

3).

Таблица

3. «Вывод итогов»

-

Регрессионная

статистикаМножественный

R0,502621

R-квадрат

0,252628

Нормированный

R-квадрат0,159206

Стандартная

ошибка25,16016

Наблюдения

50

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

1

1711,83

1711,83

0,455188

0,769029

Остаток

48

5064,27

633,0337

Итого

49

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

22,80765

19,30663

0,351022

0,739878

Переменная

x10,469454

0,324557

0,812186

0,453601

Переменная

x20,119464

36,14581

0,226852

0,829522

Переменная

x319,47716

0,023568

2,692154

0,017188

Переменная

x410,17820

0,014578

2,811450

0,005123

1.

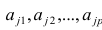

Из таблицы берем значения коэффициентов

регрессии и получаем уравнение:

y=22,80765+0,469454x1+0,119464x2+19,47716x3-10,1782x4

(коэффициенты при y –

пересечении и переменных x1,

x2, x3,

x4.

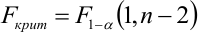

2.

Проверка на значимость заключается в

проверке гипотезы о статистической

незначимости проверяемых параметров,

или проверки вывода о том, что проверяемый

параметр сформировался под влиянием

случайных причин, а не в результате

достаточно сильного влияния, т.е.

закономерности. При этом уровень

значимости представляет собой вероятность

ошибки отклонения правильной гипотезы.

Договоримся, что допустимый уровень

значимости при выполнении лабораторной

работы примем равным 0,05 или 5%.

Проверку

значимости коэффициентов уравнения

можно сделать по значению t-статистики,

которое сравнивается с табличным

значением. Для коэффициента a0

значение t-статистики

равно 0,351022; для коэффициента b1

значение t-статистики

равно 0,812186; для b2 –

0,226852 и т.д. Сравниваем каждое из этих

значений с пороговым. Если пороговое

значение t-статистики

меньше, чем в данной модели, проверяемый

коэффициент уравнения значим и наоборот.

Пороговое значение найдете в таблице

t-статистики. Пороговое

значение определяется в зависимости

от выбранного уровня значимости и числа

степеней свободы, рассчитанного по

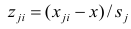

формуле:

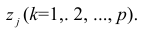

k

= n – m -1

k

— число степеней свободы:

n

— число наблюдений.

m

— число факторов.

Выбранный

уровень значимости указывает вероятность

ошибки, т.е. при уровне значимости 0,05

проверяемый коэффициент уравнения

регрессии считается значимым с

вероятностью (1 – 0,05) или 95%; при уровне

значимости 0,01 проверяемый коэффициент

уравнения регрессии считается значимым

с вероятностью (1 – 0,01) или 99%.

Возможен

и другой способ проверки. В таблице 1,

кроме значений t-статистики,

дан уровень значимости t-статистики

( графа «Р – Значение»). Если уровень

значимости, приведенный в таблице 2, не

превышает 0,05 (5%), делаем вывод, что

проверяемый коэффициент значим и

наоборот. Кроме того, уровень значимости

может быть указан более точно, чем просто

больше или меньше 0,05. Так, «Р – Значение»

равное 0,739878 говорит о том, коэффициент

a0 уравнения регрессии

можно считать значимым с вероятностью

0,739878 (73,99%), а коэффициент b1

– 0,453601 (45,36%), коэффициент b2

– 0,829522 (82,95%) и т.д. Поскольку все значения

вероятности гораздо меньше 95%, гипотеза

о незначимости коэффициентов уравнения

принимается, а уравнение регрессии

признается незначимым. Коэффициент a0

может быть принят лишь с вероятностью

(1–0,739878) или 26%, коэффициент b1

– с вероятностью (1-0,453601) или 55% и т.д.

Следовательно, перечисленные коэффициенты

незначимы.

3.

Оценку тесноты связи делаем по R

– квадрат.

R

– квадрат измеряет тесноту связи

через отношение дисперсий результативного

признака. Чем ближе R

–квадрат к 0, тем слабее связь между

Х и Y, чем ближе R

–квадрат с 1, тем сильнее связь.

Нормированный R

-квадрат дает скорректированную

оценку коэффициента детерминации, т.е.

долю вариации результата за счет

включенных в уравнение регресии факторов

в общей вариации результата с учетом

степеней свободы общей и остаточной

дисперсии. R – квадрат

представляет собой нескорректированную

оценку тесноты связи (без учета числа

степеней свободы). Различия между

скорректированной и нескорректированной

оценкой становятся важными, если мы

должны сравнивать между собой модели

с различным числом факторов. Сопоставлять

уравнения регрессии с различным числом

факторных признаков можно только по

скорректированным значениям (Нормированный

R — квадрат).

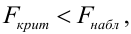

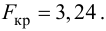

4.

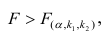

Проверка на значимость всей регрессионной

модели, т.е. уравнения регрессии и

коэффициента тесноты связи, проводим

по F-критерию.

Берем F-критерию из

таблицы 2 и сравниваем с пороговым

значением из таблицы «Значения F-критерия»

Приложения 2. Если пороговое значение

F-критерия меньше,

чем в данном примере (0,4552188), проверяемая

регрессионная модель значима и наоборот.

Пороговое значение определяется в

зависимости от выбранного уровня

значимости и числа степеней свободы

(k1 и k2),

рассчитанных по формулам:

k1

= n – 3

k2

= n-m

где

k1 и k2—

число степеней свободы;

n

— число наблюдений;

m

— число параметров уравнения регрессии,

для парной регрессии равно 2.

Второй

вариант проверки – это определение

вероятности принятия гипотезы о

незначимости регрессионной модели по

значению «Значимость F»,

равное в этом примере 0,769029 или 76,9%. Данное

значение ошибки при принятии гипотезы

означает, что F-критерий

незначим.

5.

Для того, что улучшить создаваемую

модель, надо сравнить между собой

несколько вариантов регрессионной

модели с различным числом факторов.

Вспомним, что предпочтительнее та

модель, которая при том же значении

коэффициента детерминации имеет меньшее

количество факторов, включенных в нее.

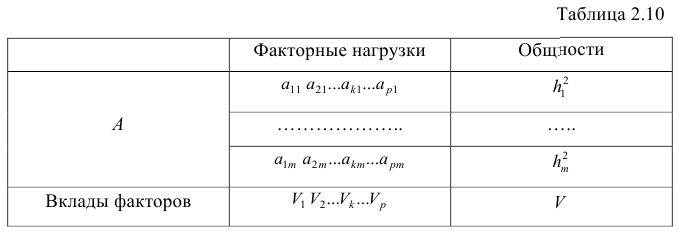

Например, сравним 2-факторную модель с

факторами х1 и х2 (таблица

4) с 3-факторной моделью, включающей

факторы х1, х2, х3

(таблица 5) и с 4-факторной моделью,

содержащей факторы х1, х2,

х3, х4 (таблица 6).

Таблица

4. Вывод итогов

-

Регрессионная

статистикаМножественный

R0,990069

R-квадрат

0,980237

Нормированный

R-квадрат0,974591

Стандартная

ошибка0,482617

Наблюдения

50

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

2

1711,83

1711,83

173,6

0,00000109

Остаток

47

5064,27

633,0337

Итого

49

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

23,76087

1,46212

16,25098

8,13Е-07

Переменная

x1-1,43478

0,311799

-4,60163

0,002479

Переменная

x2-0,86957

0,450043

-1,93218

0,094618

Таблица

5.Вывод итогов

-

Регрессионная

статистикаМножественный

R0,994937

R-квадрат

0,989899

Нормированный

R-квадрат0,984848

Стандартная

ошибка0,372678

Наблюдения

50

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

3

1711,83

1711,83

196

2,25Е-06

Остаток

46

5064,27

633,0337

Итого

49

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

16,5

3,234325

5,101528

0,002218

Переменная

x1-0,83333

0,347853

-2,39565

0,053612

Переменная

x2-0,83333

0,347853

-2,39565

0,053612

Переменная

x30,83333

0,347853

2,39548

0,053612

Таблица

6. Вывод итогов

-

Регрессионная

статистикаМножественный

R0,998085

R-квадрат

0,996173

Нормированный

R-квадрат0,993112

Стандартная

ошибка0,251271

Наблюдения

50

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

4

1711,83

1711,83

325,4193

3,16Е-06

Остаток

45

5064,27

633,0337

Итого

49

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

10,38235

3,052896

3,400821

0,019234

Переменная

x1-0,49216

0,263065

-1,87085

0,120281

Переменная

x2-0,65686

0,242496

-2,70876

0,042339

Переменная

x30,75098

0,236290

3,17821

0,024588

Переменная

x40,517647

0,180784

2,863347

0,035268

Сравним

модели но нормированным R-квадрат.

Самое большое значение у 3-факторной

модели. Видно, что по мере увеличения

факторов в уравнение регрессии

увеличивается значение нормированного

R-квадрат. Такое

возможно только в том случае, когда в

уравнение добавляются значимые факторы,

оказывающие значительное влияние на

результат. Именно поэтому их включение

в регрессионную модель в той

последовательности, в которой они

включены в модель, целесообразно.

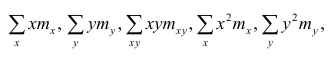

Улучшить

регрессионную модель можно, оценив

целесообразность включения каждого

фактора отдельно, по коэффициентам

парной корреляции: Данные – Анализ

данных – Корреляция. Входной интервал:

выделяем весь массив данных; Группирование

— по столбцам (ставим метку); Выходной

интервал – выделяем несколько

свободных ячеек. Также возможен другой

способ – при помощи функции

– Статистические – КОРРЕЛ, т.е. вводим

я ячейку:

=КОРРЕЛ(массив1;массив2)

где

массив1

– данные по одному признаку,

массив2

– данные по второму признаку.

Пример

расчетов представлен в таблице 7.

Таблица

7. Пример корреляционной матрицы

-

Y

x1

x2

x3

x4

x1

0,98473

x2

0,9594

0,8094

x3

0,969223

-0,9525

0,6921

x4

0,971908

-0,9513

0,71997

0,7199

В

таблице 7 перечислены коэффициенты,

показывающие тесноту связи между

признаками попарно. Сравним их друг с

другом по абсолютной величине. Особое

внимание обратим на межфакторные связи,

т.е. на связи между различными xk.

Если межфакторная связь сильнее, чем

связь фактора с результативным признаком,

такой фактор следует исключить из

уравнения регрессии. Наличие сильной

межфакторной связи свидетельствует о

сильной коллинеарности (взаимосвязи)

факторов. Для качественной регрессионной

модели недопустим уровень коллинеарности,

превышающий 0,8.

В

рассматриваемом примере самой сильной

является связь y с x1

(0,98473), затем по мере убывания y

с x4 (0,97908), y

с x3 (0,969223), y

с x2 (0,9594), x1

с x3 (0,9525), x1

с Х4 (0,9513), x1 с

x2 (0,8094), x2

с x4 (0,71997), x3

с x4 (0,7199), x2

с x3 (0,6921). Поскольку

межфакторные связи слабее связи

факторного и результативного признаков,

следует оставить в уравнении все

факторные признаки, но требованию

неколлинеарности факторов уравнения

регрессии отвечает лишь связь x2

с x4; x3

с x4 и x2

с x3. Однако для

окончательного вывода о целесообразности

присутствия в уравнении каждого из

факторных признаков, следует проверить

уровни значимости коэффициентов

уравнения по таблицам 3,4 и 5.

Поскольку

4-х факторная модель имеет самый высокий

уровень коэффициента детерминации,

начнем с нее. По Р-Значениям t-критерия

видим, что коэффициент b1

имеет Р-Значениям t-критерия

больше 5% (t-критерий равен

0,120281), следовательно x1

надо исключить из уравнения. (Это

объясняется тем, что несмотря на сильную

связь y и x1

мы исключаем x1 из

уравнения регрессии из-за наличия

сильной коллинеарности x1

с x2, x3,

x4).

Аналогичную

проверку сделаем для других значений

хk и для других

моделей. По Р-Значениям t-критерия

видно, что в 3-х факторной модели все

факторы находятся в одинаковом положении,

т.к. уровень Р-Значениям t-критерия

почти равен 5%. Для 2-х факторной модели

удаленным из уравнения должен быть

фактор x2 (Р-Значениям

t-критерия для

b2 = 0,094618, что больше

0,05). С учетом уровня Р-Значениям всей

модели (Р-Значения F-критерия)

можно сделать вывод о высокой надежности

всех трех моделей (0,00000109; 0,00000225; 0,00000316

соответственно).

Выполнение

задания 3 в ППП MS

Excel 2007.

В

ППП «Excel» регрессионная модель нелинейной

формы может быть выполнена только в

форме экспоненциального приближения:

– Статистические – ЛГРФПРИБЛ. Между

тем нелинейную форму уравнения можно

привести к линейной, осуществив процедуру

линеаризации. Например, показательная

функция

приводится

к линейной форме логарифмированием

обеих частей уравнения:

lgу

=lga+x lgb

получаем

Y=A

+ Bх,

где

Y=lgy; A=lga; B=lgb.

Теперь

пересчитываем исходные данные х и

у в lgx и lgy:

– Математические – LOG10.

В

качестве признака X возьмем тот признак,

коэффициент корреляции которого с

признаком Y наибольший.

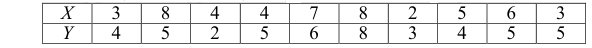

Таблица

8. Пример расчета для показательной

функции

-

x

y

Lg x

Lg

y2

3

1,079181

1,361728

5

4

1,653213

1,146128

8

5

1,892095

1,39794

9

6

1,94939

1,556303

6

7

1,748188

1,672098

3

8

1,361728

1,763428

2

9

1,50515

1,838849

5

1

1,812913

1,612784

8

2

1,991226

1,716003

7

3

1,939519

1,799341

Относительно

новых переменных, lgx

и lgy выводим таблицу

регрессии: Данные – Анализ данных

– Регрессия. В окне Регрессия в

качестве входного интервала х выделяем

столбец lgx ; в качестве

входного интервала у выделяем

столбец lgy.

Таблица

9.Вывод итогов

-

Регрессионная

статистикаМножественный

R0,850621

R-квадрат

0,352628

Нормированный

R-квадрат0,1905926

Стандартная

ошибка2,16016

-

Дисперсионный

анализdf

SS

MS

F

Значимость

FРегрессия

1

1711,83

1711,83

29,704177

0,0138707

Остаток

8

5064,27

633,0337

Итого

9

6776,1

-

Коэффициенты

Стандартная

ошибкаt-статистика

P-Значение

Y-пересечение

1,366991

9,30663

0,95163

0,369146

Переменная

x10,129613

0,324557

1,644436

0,138707

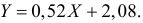

Уравнение

регрессии выглядит следующим образом:

У=1,366991+0,129613Х. Вернемся к исходным

переменным, т.е. перейдем от lgx

и lgy к х и у.

Получим уравнение:

Проверка

на значимость полученного уравнения и

измерение тесноты связи проводится

аналогично примерам, рассмотренным

выше. Методом линеаризации можно

достаточно быстро получить уравнения

регрессии различной формы. Выбор лучшей

формы уравнения регрессии зависит от

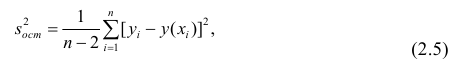

величины остатков. Остатки – это

расхождения эмпирических и теоретических

(регрессионных) значений результативного

признака. Чем больше сумма расхождений,

тем хуже уравнение регрессии описывает

связь фактора и результата.

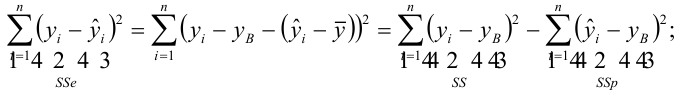

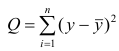

Остатки

рассчитываются как сумма квадратов

отклонений исходных значений от

регрессионных значений результативного

признака (см. Таблица 6: Дисперсионный

анализ – Остаток – SS

или MS).

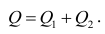

SS

– это сумма квадратов; MS

– это сумма квадратов в расчете на 1

единицу числа степеней свободы (df).

Сравнивать уравнения регрессии надо

по MS.

Чем меньше MS,

тем лучше форма уравнения регрессии.

- Авторы

- Резюме

- Файлы

- Ключевые слова

- Литература

Курзаева Л.В.

1

1 ФГБОУ ВО «Магнитогорский государственный технический университет им. Г.И. Носова»

Аналитическая статистика – одиниз самых сложных разделов анализа данных в плане изучения, при этом регрессионный анализ является одним из самых информативных. Такой анализ производится при решения следующих задач: установление и оценка взаимосвязи признаков; прогнозирование и предсказание; управление процессами. Существует два вида анализа двумерных данных, представленных переменными: корреляционный и регрессионныйанализ, последнийпозволяет определить форму взаимосвязи между признаками. В статье описывается простой способ проведения регрессионного анализа в MicrosoftExcel. Материалы данной статьи представляют методическую и практическую ценность для преподавателей, занимающихся вопросами повышения эффективности обучения в области основ анализа данных с информационных технологий, и осуществляющие реализацию образовательного процесса в вузах и на курсах повышения квалификаций.

Ключевыеслова: анализ данных

электронные таблицы

1. Овчинникова И.Г., Варфоломеева Т.Н., Гусева Е.Н. Учебно-методическое пособие для подготовки к вступительным экзаменам по информатике. -Магнитогорск, 2002. -С. 119

2. Овчинникова И.Г., Варфоломеева Т.Н., Корнещук Н.Г. Учебное пособие для подготовки к централизованному тестированию по информатике. -Магнитогорск, 2002. -С.205

3. Курзаева Л.В. Дистанционный курс «Основы математической обработки информации»: электронный учебно-методический комплекс // Хроники объединенного фонда электронных ресурсов Наука и образование. — 2014. -Т. 1. — № 12 (67). — С. 117

4. Курзаева Л.В. Введение в теорию систем и системный анализ: учеб. пособие/Л.В. Курзаева. -Магнитогорск: МаГУ, 2015. -211 с.

5. Курзаева Л.В. Введение в методы и средства получения и обработки информации для задач управления социальными и экономическими системами: учеб. пособие/Л.В. Курзаева, И.Г. Овчинникова, Г.Н. Чусавитина. -Магнитогорск:Магнитогорск. гос. техн. ун-та им. Г.И. Носова, 2016. -118 с.

Для реализации процедуры Регрессия необходимо: выбрать в меню Сервис команду Анализ данных. В появившемся диалоговом окне Анализ данных в списке Инструменты анализа выбрать строку Регрессия.

Рис.1. Окно «Регрессия»

В появившемся диалоговом окне (рис.1) задать:

Входной интервал Y– диапазон (столбец), содержащий данные со значениями объясняемой переменной;

Входной интервал Х– диапазон (столбцы), содержащий данные с заголовками.

Метки – флажок, который указывает, содержат ли первые элементы отмеченных диапазонов названия переменных (столбцов) или нет;

Константа-ноль– флажок, указывающий на наличие или отсутствие свободного члена в уравнении (а);

Уровень надежности– уровень значимости, (например, 0,05);

Выходной интервал – достаточно указать левую верхнюю ячейку будущего диапазона, в котором будет сохранен отчет по построению модели;

Новый рабочий лист– поставить значок и задать имя нового листа (Отчет – регрессия), в котором будет сохранен отчет.

Если необходимо получить значения и график остатков, а также график подбора (чтобы визуально проверить отличие экспериментальных точек от предсказанных по регрессионной модели), установите соответствующие флажки в диалоговом окне.

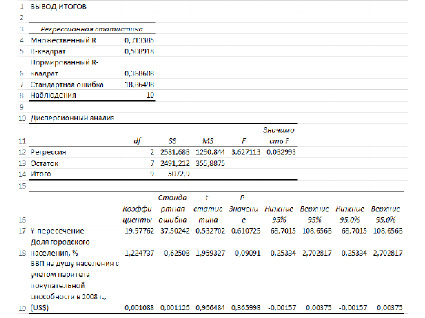

Рассмотрим результаты регрессионного анализа (рис. 2, 3).

Рис. 2. Вывод итогов регрессионного анализа

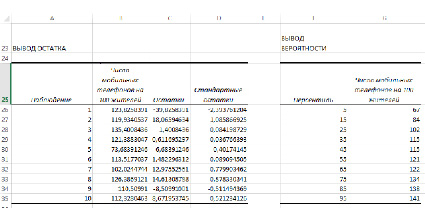

Рис. 3. Вывод остатков и вероятности по результатам регрессионного анализа

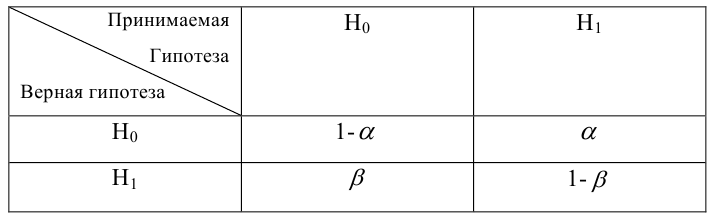

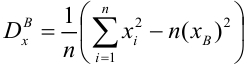

Множественный R – коэффициент корреляции

R-квадрат – это коэффициент линейной детерминации. Коэффициент является одной из наиболее эффективных оценок адекватности регрессионной R2модели, мерой качества уравнения регрессии в целом (или, как говорят, мерой качества подгонки регрессионной модели к наблюденным значениям.

Если R-квадрат > 0,95, говорят о высокой точности аппроксимации (модель хорошо описывает явление). Если R-квадрат лежит в диапазоне от 0,8 до 0,95, говорят об удовлетворительной аппроксимации (модель в целом адекватна описываемому явлению). Если R-квадрат < 0,6, принято считать, что точность аппроксимации недостаточна и модель требует улучшения (введения новых независимых переменных, учета нелинейностей и т. д.).

Нормированный R-квадрат – скорректированный (адаптированный, поправленный) коэффициент детерминации.

Недостатком коэффициента детерминации R-квадратявляется то, что он увеличивается при добавлении новых объясняющих переменных, хотя это и не обязательно означает улучшение качества регрессионной модели. В этом смысле предпочтительнее использовать нормированный, который в отличие от R-квадрат может уменьшаться при введении в модель новых объясняющих переменных, не оказывающих существенное влияние на зависимую переменную.

Наблюдения – число наблюдений (в нашем случае 10 стран).

Df– число степеней свободы связано с числом единиц совокупности и с числом определяемых по ней констант.

F и Значимость F позволяют проверить значимость уравнения регрессии, т.е. установить, соответствует ли математическая модель, выражающая зависимость между переменными, экспериментальным данным и достаточно ли включенных в уравнение объясняющих переменных (одной или нескольких) для описания зависимой переменной.

SS – Сумма квадратов отклонений значений признака Y.

MS – Дисперсия на одну степень свободы.

F – Наблюдаемое (эмпирическое) значение статистики F, по которой проверяется гипотеза равенства нулю одновременно всех коэффициентов модели. Значимость F – теоретическая вероятность того, что при гипотезе равенства нулю одновременно всех коэффициентов модели F-статистика больше эмпирического значения F.

На уровне значимости α=0,05 гипотеза H0:b1=0отвергается, если Значимость F<0.05, и принимается, если Значимость F

Значения коэффициентов регрессии находятся в столбце Коэффициенты и соответствуют:

У-пересечение – a;

переменная XI – b1;

переменная Х2 – b2 и т. Д.

Таким образом, получена следующая модель регрессии:

Y=1.2247X1+0.00108X2+19.9776

t-статистика соответствующего коэффициента.

P-Значение – вероятность, позволяющая определить значимость коэффициента регрессии. В случаях, когда Р-Значение>0,05, коэффициент может считаться нулевым, что означает, что соответствующая независимая переменная практически не влияет на зависимую переменную.

В нашем случае оба коэффициента оказались «нулевыми», а значит обе независимые переменные не влияют на модель.

Нижние 95% – Верхние 95% – доверительный интервал для параметра , т.е. с надежностью 0.95 этот коэффициент лежит в данном интервале. Поскольку коэффициент регрессии в исследованиях имеют четкую интерпретацию, то границы доверительного интервала для коэффициента регрессии не должны содержать противоречивых результатов. Так, например, «Доля городского населения, в %» не может лежать в интервале -0,25≥b1≥2,7. Такого рода запись указывает, что истинное значение коэффициента регрессии одновременно содержит положительные и отрицательные величины и даже ноль, чего не может быть.

Предсказанное Y — теоретические (расчетные) значения результативного признака.

Остатки – остатки по модели регрессии.

На основе данных об остатках модели регрессии был построен график остатков (рис. 4) и график подбора – поле корреляции фактических и теоретических (расчетных) значений результативной переменной (рис.5).

Рис. 4. График остатков по значениям признака «Доля городского населения, %»

Рис. 5. График подбора для признаков «Доля городского населения, %» и «Число мобильных телефонов на 100 жителей»

Рассмотрение графиков подбора позволяет предположить, что, возможно, качество модели можно усовершенствовать, исключив данные по Белоруссии как аномальные значения.

Библиографическая ссылка

Курзаева Л.В. РЕГРЕССИОННЫЙ АНАЛИЗ В ЭЛЕКТРОННЫХ ТАБЛИЦАХ // Международный журнал прикладных и фундаментальных исследований. – 2016. – № 12-7.

– С. 1234-1238;

URL: https://applied-research.ru/ru/article/view?id=11019 (дата обращения: 13.06.2023).

Предлагаем вашему вниманию журналы, издающиеся в издательстве «Академия Естествознания»

(Высокий импакт-фактор РИНЦ, тематика журналов охватывает все научные направления)

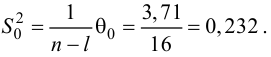

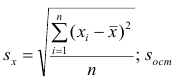

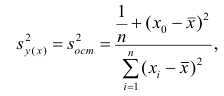

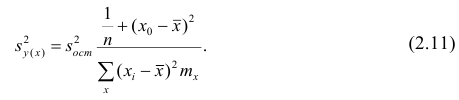

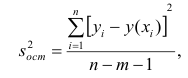

Стандартное

отклонение для оценки обозначается Se

и рассчитывается по формуле

среднеквадратичного отклонения:

.

Величина стандартного

отклонения характеризует точность

прогноза.

Вариант

5. Возвращаясь к данным нашего примера,

рассчитаем значение Se:

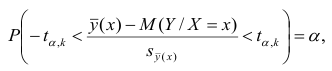

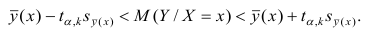

Предположим,

необходимо оценить значение Y для

конкретного значения независимой

переменной, например, спрогнозировать

объем продаж при затратах на рекламу в

объеме 10 тыс. долл. Обычно при этом также

требуется оценить степень достоверности

результата, одним из показателей которого

является доверительный интервал для

Y.

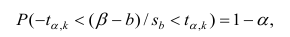

Граница доверительного

интервала для Y при заданной величине

X рассчитывается следующим образом:

где

Хp

– выбранное значение независимой

переменной, на основе которого выполняется

прогноз. Обратите внимание: t – это

критическое значение текущего уровня

значимости. Например, для уровня

значимости, равного 0,025 (что соответствует

уровню доверительности двухстороннего

критерия, равному 95%) и числа степеней

свободы, равного 10, критическое значение

t равно 2, 228 (см. Приложение II). Как можно

увидеть, доверительный интервал – это

интервал, ограниченный с двух сторон

граничными значениями предсказания

(зависимой переменной).

Вариант

6. Для нашего примера расходов на рекламу

в размере 10 тыс. долл. интервал предсказания

зависимой переменной (объема продаж) с

уровнем доверительности в 95% находится

в пределах [10,5951; 21,8361]. Его границы

определяются следующим образом (обратите

внимание, что в Варианте 2 Y’=16,2156):

Из приведенного

расчета имеем: для заданных расходов

на рекламу в объеме 10 тыс. долл., объем

продаж изменяется в диапазоне от 10,5951

до 21,8361 тыс. долл. При этом:

10,5951=16,2156-5,6205 и 21,8361=16,2156+5,6205.

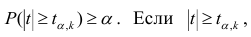

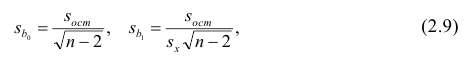

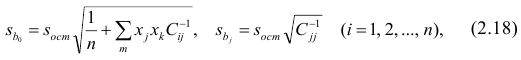

3. Стандартное отклонение для коэффициента регрессии Sb и t-статистика

Значения

стандартного отклонения для коэффициентов

регрессии Sb

и значение статистики тесно взаимосвязаны.

Sb

рассчитываются как

Или в сокращенной

форме:

Sb

задает интервал, в который попадают.

Все возможные значения коэффициента

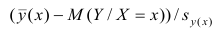

регрессии. t-статистика

(или t-значение)

– мера статистической значимости

влияния независимой переменной Х на

зависимую переменную Y

определяется путем деления оценки

коэффициента b

на его стандартное отклонение Sb.

Полученное значение затем сравнивается

с табличным (см. табл. В Приложении II).

Таким

образом, t-статистика

показывает, насколько велики величина

стандартного отклонения для коэффициента

регрессии (насколько оно больше нуля).

Практика показывает, что любое t-значение,

не принадлежащее интервалу [-2;2], является

приемлемым. Чем выше t-значение,

тем выше достоверность коэффициента

(т.е. точнее прогноз на его основе). Низкое

t-значение

свидетельствует о низкой прогнозирующей

силе коэффициента регрессии.

Вариант

7. Sb

для нашего примера равно:

t-статистика

определяется:

Так

как t=3,94>2,

можно заключить,

что

коэффициент

b

является

статистически

значимым.

Как

отмечалось раньше,

табличное

критическое

значение (уровень отсечения)

для 10 степеней свободы равно

2,228

(см.

табл.

в

Приложении

11).

Обратите

внимание:

—

t-значения

играют большую

роль для коэффициентов

множественной регрессии

(множественная

модель описывается

с помощью

нескольких

коэффициентов

b);

—

R2

характеризует

общее согласие (всего

«леса»

невязок

на

диаграмме

разброса),

в

то время как

t-значение

характеризует

отдельную

независимую переменную

(отдельное

«дерево»

невязок).

В

общем случае

табличное

t-значение

для

заданных

числа

степеней свободы и уровня

значимости используется,

чтобы:

—

установить

диапазон

предсказания:

верхнюю

и нижнюю границы

для прогнозируемого

значения при заданном значении

независимой

переменной;

-установить

доверительные

интервалы

для

коэффициентов

регрессии;

—

определить

уровень

отсечения

для t-теста.

РЕГРЕССИОННЫЙ

АНАЛИЗ С ПРИМЕНЕНИЕМ ЭЛЕКТРОННЫХ ТАБЛИЦ

MS EXCEL

Электронные

таблицы,

такие

как Excel,

имеют

встроенную

процедуру

регрессионного

анализа,

легкую

в

применении.

Регрессионный

анализ

с помощью

MS Ехсеl

требует

выполнения

следующих

действий:

—

выберите

пункт

меню

«Сервис

— Надстройки»;

—

в

появившемся

окне отметьте

галочкой

надстройку

Analysis

ToolPak

–

VBA нажмите

кнопку

ОК.

Если

в списке Analysis

ToolPak

—

VВА

отсутствует,

выйдите

из MS Ехсеl

и добавьте эту надстройку,

воспользовавшись

программой

установки Мiсrosоft

Office.

Затем

запустите Ехсеl

снова

и повторите

эти действия.

Убедившись,

что

надстройка

Analysis

ToolPak

—

VВА

доступна,

запустите

инструмент

регрессионного

анализа,

выполнив

следующие

действия:

—

выберите

пункт меню «Сервис

—

Анализ»

данных;

—

в появившемся окне выберите

пункт

«Регрессия»

и

нажмите

кнопку

ОК.

На

рисунке 16.3

показано окно ввода данных для

регрессионного

анализа.

Рисунок 16.3 – Окно

ввода данных для регрессионного анализа

Таблица

16.2

показывает

выходной

результат

регрессии,

содержащий

описанные

выше статистические

данные.

Примечание:

для

того чтобы получить

поточечный

график

(ХY график),

используйте

«Мастер

Диаграмм»

MS

Excel.

Получаем:

Y’

= 10,5386

+ 0,563197

Х (d

виде

Y’

=

а

+

bХ)

с R2=0,608373=60,84%.

Все

полученные

данные

ответствуют

данным,

рассчитанным

вручную.

Таблица 16.2 –

Результаты регрессионного анализа

в

электронных таблицах MS

Excel

|

Вывод |

||||||

|

Регрессионная |

||||||

|

Множественный |

0,7800 |

|||||

|

R-квадрат |

0,6084 |

|||||

|

Нормированный |

0,5692 |

|||||

|

Стандартная |

2,3436 |

|||||

|

Наблюдения |

12 |

|||||

|

Дисперсионный |

||||||

|

df |

SS |

MS |

F |

Значимость |

||

|

Регрессия |

1 |

85,3243 |

85,3243 |

15,5345 |

0,0028 |

|

|

Остаток |

10 |

54,9257 |

5,4926 |

|||

|

Итого |

11 |

140,2500 |

||||

|

Коэффи-циенты |

Стандарт-ная |

t-статистика |

Р- |

Нижние |

Верхние |

|

|

Свободный |

10,5836 |

2,1796 |

4,8558 |

0,0007 |

5,7272 |

15,4401 |

|

Линейный |

0,563197 |

0,1429 |

3,9414 |

0,0028 |

0,2448 |

0,8816 |

|

*Р |

Таблица

16.3 показывает выходной результат

регрессии, полученный с применением

популярного программного обеспечения

Minitab

для статистического анализа.

Таблица

16.3 – Результаты регрессионного анализа

Minitab

|

Анализ регрессии

Уравнение FO=10,6+0,563DLH |

|||||

|

Прогнозируемые |

Коэффициент |

Стандартное |

t-значение |

P |

|

|

Константа |

10,584 |

2,180 |

4,86 |

0,000 |

|

|

DLH |

0,5632 |

0,1429 |

3,94 |

0,003 |

|

|

s=2,344 |

R-квадрат=60,8% |

R-квадрат |

|||

|

Анализ |

|||||

|

Показатель |

DF |

SS |

MS |

F |

P |

|

Регрессия |

1 |

85,324 |

85,324 |

15,53 |

0,003 |

|

Отклонение |

10 |

54,926 |

5,493 |

||

|

Итого |

11 |

140,250 |

ВЫВОДЫ

C

помощью регрессионного анализа

устанавливается

зависимость

между

изменениями

независимых

переменных

и

значениями зависимой

переменной.

Регрессионный

анализ

— популярный

метод для прогнозирования

продаж.

В

этой

главе обсуждался

широко

распространенный

способ

оценки значений,

так

называемый

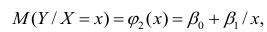

метод

наименьших

квадратов.

Метод

наименьших

квадратов

рассматривался

применительно

к

модели

простой

регрессии

Y

=

а

+ bх.

Обсуждались

различные

статистические

коэффициенты,

характеризующие

добротность

и надежность

уравнения

(согласие

модели)

и помогающие установить

доверительный

интервал.

Показано

применение

электронных

таблиц MS Ехсеl для

проведения

регрессионного

анализа

шаг за шагом.

С

помощью электронных

таблиц

можно не только составить

уравнение

регрессии,

но

и рассчитать статистические

коэффициенты.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

From Wikipedia, the free encyclopedia

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]

Like variance, mean squared error has the disadvantage of heavily weighting outliers.[11] This is a result of the squaring of each term, which effectively weights large errors more heavily than small ones. This property, undesirable in many applications, has led researchers to use alternatives such as the mean absolute error, or those based on the median.

See also[edit]

- Bias–variance tradeoff

- Hodges’ estimator

- James–Stein estimator

- Mean percentage error

- Mean square quantization error

- Mean square weighted deviation

- Mean squared displacement

- Mean squared prediction error

- Minimum mean square error

- Minimum mean squared error estimator

- Overfitting

- Peak signal-to-noise ratio

Notes[edit]

- ^ This can be proved by Jensen’s inequality as follows. The fourth central moment is an upper bound for the square of variance, so that the least value for their ratio is one, therefore, the least value for the excess kurtosis is −2, achieved, for instance, by a Bernoulli with p=1/2.

References[edit]

- ^ a b «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 2020-09-12.

- ^ Bickel, Peter J.; Doksum, Kjell A. (2015). Mathematical Statistics: Basic Ideas and Selected Topics. Vol. I (Second ed.). p. 20.

If we use quadratic loss, our risk function is called the mean squared error (MSE) …

- ^ a b Lehmann, E. L.; Casella, George (1998). Theory of Point Estimation (2nd ed.). New York: Springer. ISBN 978-0-387-98502-2. MR 1639875.

- ^ Gareth, James; Witten, Daniela; Hastie, Trevor; Tibshirani, Rob (2021). An Introduction to Statistical Learning: with Applications in R. Springer. ISBN 978-1071614174.

- ^ Wackerly, Dennis; Mendenhall, William; Scheaffer, Richard L. (2008). Mathematical Statistics with Applications (7 ed.). Belmont, CA, USA: Thomson Higher Education. ISBN 978-0-495-38508-0.

- ^ A modern introduction to probability and statistics : understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{cite book}}: CS1 maint: others (link) - ^ Steel, R.G.D, and Torrie, J. H., Principles and Procedures of Statistics with Special Reference to the Biological Sciences., McGraw Hill, 1960, page 288.

- ^ Mood, A.; Graybill, F.; Boes, D. (1974). Introduction to the Theory of Statistics (3rd ed.). McGraw-Hill. p. 229.

- ^ DeGroot, Morris H. (1980). Probability and Statistics (2nd ed.). Addison-Wesley.

- ^ Berger, James O. (1985). «2.4.2 Certain Standard Loss Functions». Statistical Decision Theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. p. 60. ISBN 978-0-387-96098-2. MR 0804611.

- ^ Bermejo, Sergio; Cabestany, Joan (2001). «Oriented principal component analysis for large margin classifiers». Neural Networks. 14 (10): 1447–1461. doi:10.1016/S0893-6080(01)00106-X. PMID 11771723.

From Wikipedia, the free encyclopedia

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]