Как распознать кракозябры?

Время на прочтение

1 мин

Количество просмотров 414K

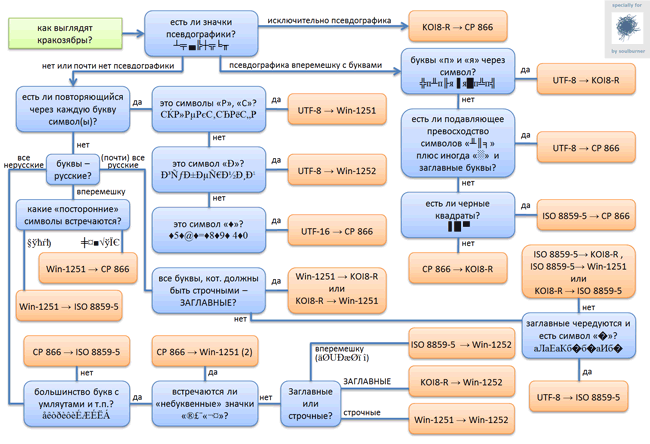

В комментариях к предыдущему посту про иероглифы сказали, что хорошо бы иметь такую же блок-схему для кракозябр.

Итак, вуаля!

За источник информации была взята статья из вики. В блок-схеме «UTF-16 → CP 866» означает, что исходная кодировка была «UTF-16», а распозналась она как «CP 866».

Как всегда — кликабельно. Исходник в .docx: здесь.

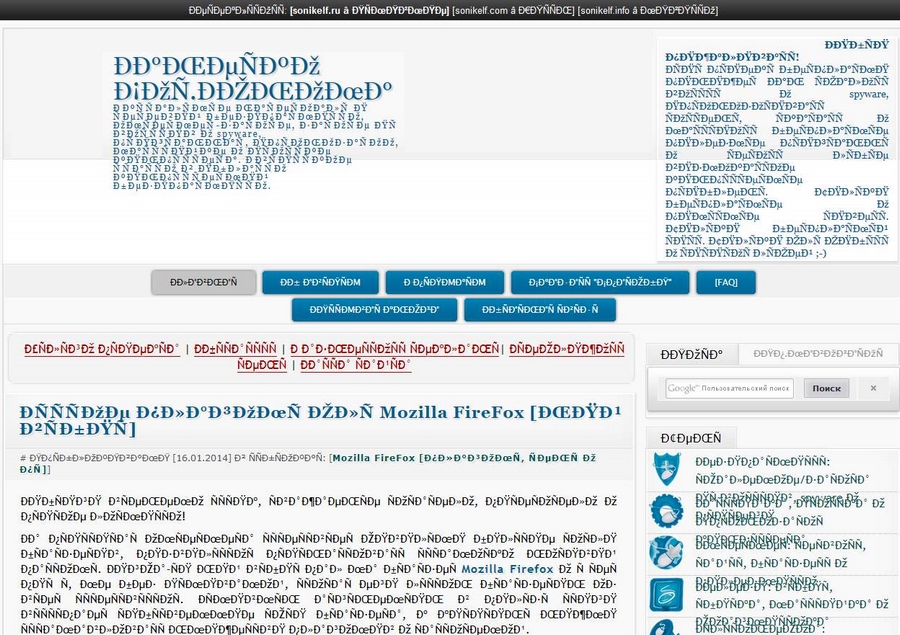

ыЙТПЛБС ØàÞÚÐï ╒┌тр╪ф╪┌ПрЎ.ТруНЬ_аЭШЩ ФРбв ЬЮ!…

Нет, мы не сошли с ума. Просто сегодня будем разбираться, как устранить ошибки кодировки и вернуть на сайт читаемый текст. Узнаем, как кодировка влияет на SEO-оптимизацию, и познакомимся с полезными сервисами, которые позволят вовремя идентифицировать ошибки.

Что такое кодировка, и когда возникают ошибки с отображением текста

Если вместо нормального текста на вашем сайте отображается странный набор символов, значит, есть проблемы с кодировкой. Впрочем, иногда кодировка на сайте является стандартизированной и выбрана корректно, но вместо текста все равно отображаются иероглифы.

Кодировка – это набор символов и система их передачи для последующего вывода на экран. Кроме алфавита при помощи кодировки передаются также специальные символы и цифры.

Сегодня массово используются 2 вида кодировки: Windows-1251 и UTF-8. Чаще всего «кракозябра» появляется, когда на одном сайте используется сразу несколько видов кодировки (да, такое бывает чаще, чем может показаться на первый взгляд).

Можно выделить и другие причины неполадок:

- Используется устаревший браузер.

- В браузере / программе установлена одна кодировка, на сайте – другая. В таком случае нужно поменять кодировку в программе.

- В БД и других файлах сайта указаны несовпадающие кодировки. В этом случае нужно выбрать одну кодировку для всего сайта.

Как поменять кодировку в браузере

Проблему с кодировкой на стороне браузера исправить легко.

Internet Explorer

- Открываем проблемную веб-страницу.

- Вызываем контекстное меню, кликнув правой кнопкой мыши по любому месту на странице.

- Выбираем «Кодировка».

- Кликаем Unicode (UTF-8).

Chrome

Chrome современный и модный браузер, но вот кодировку стандартными средствами поменять в нем нельзя (сюрприз!). Будем делать это через расширение.

- Открываем магазин Chrome.

- Кликаем «Расширения» в левой части экрана.

- Указываем слово «кодировка».

- Устанавливаем любое подходящее расширение.

Safari

- Выбираем пункт «Вид».

- Кликаем по разделу «Кодировка текста».

- Выбраем вариант Unicode (UTF-8).

Firefox

- Выбираем пункт «Вид».

- Кликаем по раздел «Кодировка текста».

- Нужно выбрать вариант Unicode (UTF-8).

Как выбрать кодировку

Если в качестве CMS вы используете WordPress, Joomla, Drupal, OpenCart или TYPO3, то дополнительно настраивать ничего не нужно. Эти движки по умолчанию работает именно с UTF-8. Все должно работать из коробки. Просто убедитесь, что везде прописана UTF-8.

В самых сложных случаях придется отдельно скачивать шаблоны под конкретную кодировку, предварительно создав MySQL. Последнее актуально, например, для DLE. Если же ваш cайт полностью самописный, просто проследите за тем, чтобы везде была установлена идентичная кодировка, желательно – UTF-8.

Какую кодировку выбрать

Сегодня большинство экспертов солидарны в том, что наиболее удобной кодировкой является UTF-8. Этот стандарт поддерживает большинство браузеров, баз данных, серверов и языков. Еще одно преимущество – она изначально была кроссплатформенной.

UTF-8 может закодировать любой unicode-символ. Пожалуй, именно это достоинство позволило кодировке стать одной из самых популярных в мире.

Windows-1251 известна в меньшей степени, но Windows-1251 и не отличается такой универсальностью и распространенностью как UTF-8. Проблемы с кодировкой могут встречаться на всех сайтах, даже на отлаженных площадках, которые работают в течение многих лет. Чтобы предотвратить проблемы с «кракозябрами» на своем сайте в будущем, необходимо с самого начала выбирать единую кодировку. Как вы уже догадались, лучший кандидат на эту роль – UTF-8.

Как узнать, какая кодировка используется на моем сайте

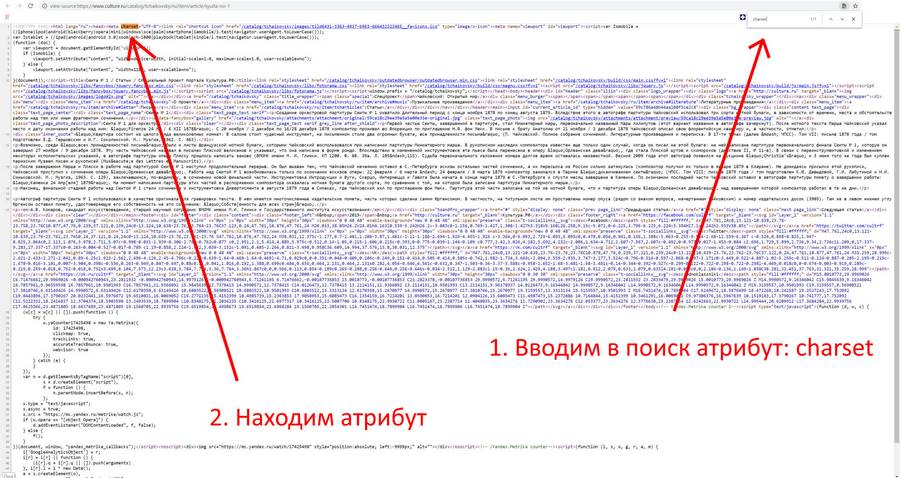

Узнать, какая кодировка используется на всем сайте или на конкретной странице, можно за несколько секунд. Для этого нужно просмотреть исходник HTML-страницы. Чтобы увидеть его, используем одновременное нажатие горячих клавиш Сtrl + U (на «Маке» активируем шорткатом Option/Alt + Command + U). Появится такое окно:

Теперь используем сочетание горячих клавиш Ctrl + F (Command + F) – откроется окно поиска. Вводим в поисковую строку атрибут charset (он же character set, кодировка документа). После этого атрибута мы увидим знак равенства. За ним и будет указана кодировка страницы.

Если атрибут charset не задан, его придется задать. Предварительно нужно проверить сайт при помощи сторонних сервисов. Один из них – Browserstack. Платформа платная, но, чтобы проверить кодировку, платить необязательно. Достаточно открыть сайт и выбрать пункт Get started free, создать аккаунт (можно просто залогиниться при помощи «Google-аккаунта»). После авторизации появится такое окно:

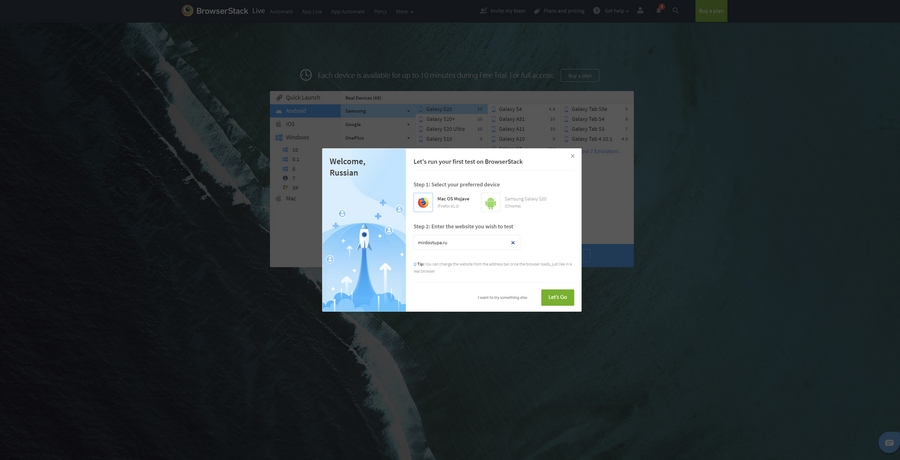

Выбираем интересующую нас операционную систему / устройство и вводим сайт, который нужно протестировать:

Если с кодировкой на сайте что-то не так, все ошибки будут представлены в результатах теста.

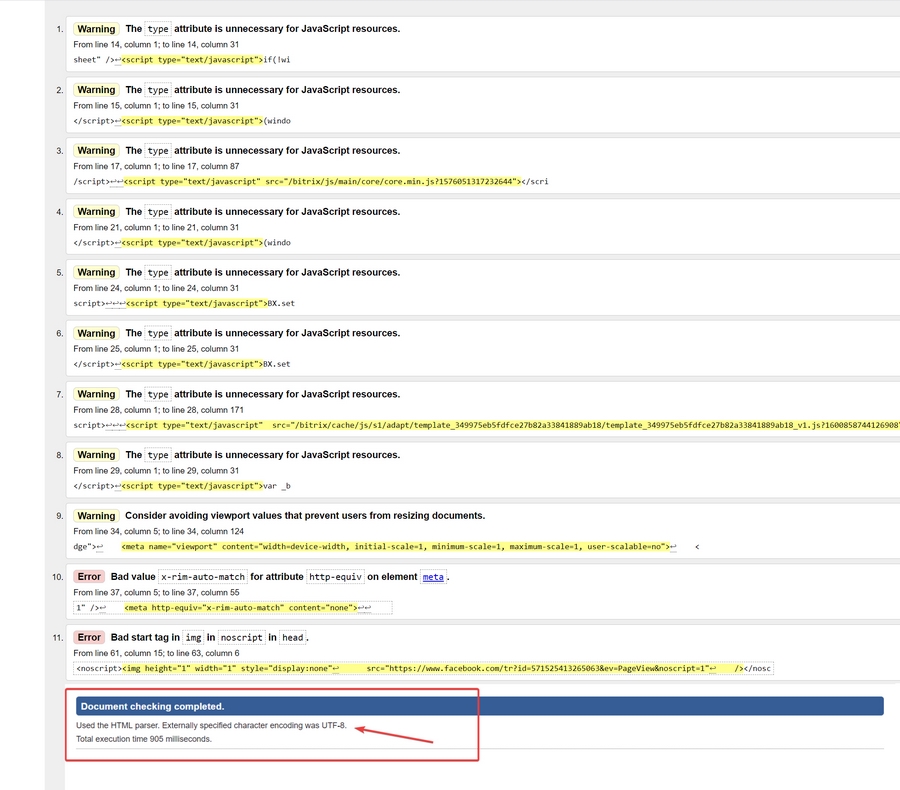

Для проверки и определения ошибок кодировки можно использовать не только Browserstack. Альтернатива – бесплатный сервис Validator. Он позволит идентифицировать кодировку сразу по нескольким данным, включая заголовки. Пример ошибки кодировки в результатах анализа Validator:

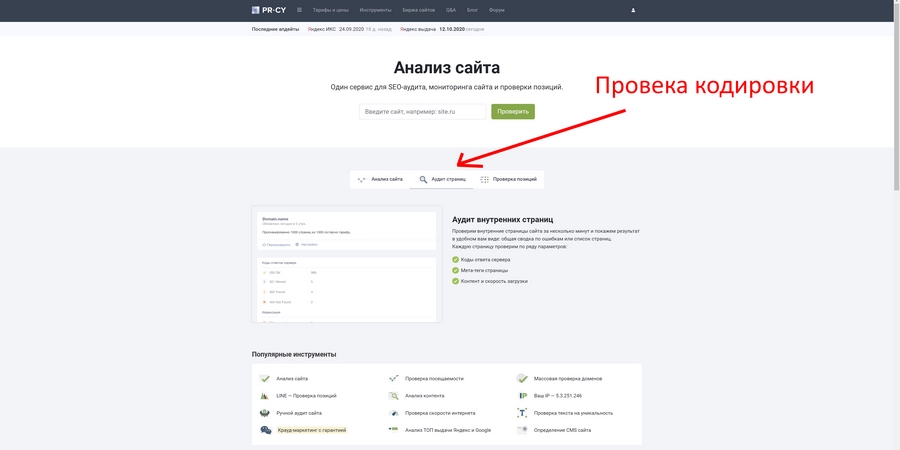

Также неплохие возможности для проверки технических ошибок сайта дает pr-cy.ru. Не забудьте выбрать пункт «Аудит страниц»:

Хорошие инструменты для проверки кодировки предоставляют сервисы NetPeak и SeoFrog. Последний удобен еще тем, что позволяет проверить кодировку сразу по всем страницам сайта, а не только по одной.

Кодировка и оптимизация

Даже если кодировка на сайте не совсем обычная или отличается на разных страницах, Google и «Яндекс» все равно проиндексируют такой сайт, но при условии, что контент уникален и не переспамлен ключами. Одна из самых неприятных ошибок здесь – несовместимость кодировки веб-ресурса с той, которая используется на сервере. Даже в таком случае Google, например, способен корректно идентифицировать ошибку. Сайт будет в выдаче, если соответствующие условия были соблюдены.

Ошибки кодировки сами по себе не влияют на оптимизацию сайта прямым образом. Они сказываются на отказах и времени, проведенном на сайте, а также на иных поведенческих показателях аудитории.

Если на вашем сайте возникают ошибки кодировки, и контент отображается некорректно, то посетитель ни при каких обстоятельствах не будет тратить свое время, пытаясь настроить правильную кодировку и, тем более, пытаться ее преобразовать в читаемую. Большинство посетителей просто не знают, как это сделать, но даже если знают, не будут тратить время и точно уйдут к конкурентам на тот сайт, где содержимое изначально отображается корректно.

Устранить проблемы кодировки сложно: мало поменять ее на одной или нескольких страницах. Обычно приходится исправлять ее также в мете (одноименных тегах), БД MySQL, файле htaccess и других системных файлах сайта.

Как исправить ошибки кодировки на своем сайте

Инструкция предназначена только для опытных пользователей и не является призывом к действию. Код и настройки я привожу исключительно в качестве примера. Если вы решитесь вносить изменения в БД и системные файлы, особенно в root, обязательно сделайте резервную копию всех данных сайта!

Документы / HTML-файлы

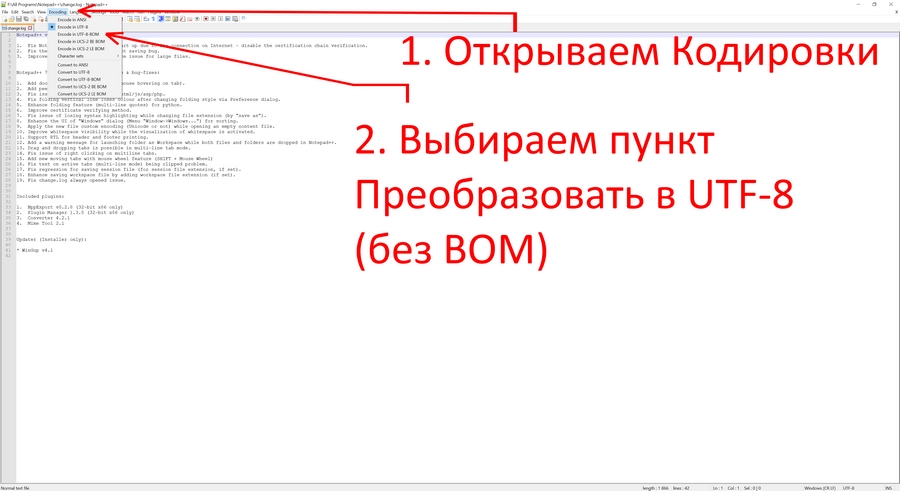

Если возникают проблемы с документами, необходимо удостовериться в том, что они имеют одинаковую кодировку, и в том, что она вообще задана. Для этого открываем HTML-файл при помощи любого редактора, который позволяет работать с кодом. Например, через Notepad++. Открываем проблемный документ и выполняем следующую последовательность действий:

Htaccess

«Кракозябра» может появляться даже в тех случаях, когда ошибки в документах уже исправлены. В таком случае нужно проверить файл htaccess. Открываем его при помощи редактора кода, затем, используя одновременное сочетание горячих клавиш Ctrl + F, открываем окно «Поиск по странице» и вводим уже знакомый нам атрибут Charset. Если атрибут найден, его необходимо исправить на тот, который является стандартным для вашего сайта. Если его нет вообще, добавляем атрибут AddDefaultCharset UTF-8 в любом месте в самом начале документа.

Теги типа meta

Именно мета-тег используется для установки требуемой кодировки. Кроме этого, в нем прописываются и другие мета-теги, которые задействованы для хранения информации, используемой браузерами. Прописываются теги типа meta в head-разделе. Выглядит следующим образом:

<!DOCTYPE HTML>

<html>

<head>

<title>Тег META</title>

<meta charset="utf-8">

</head>

<body>

<p>...</p>

</body>

</html>

Этот код приводится в качестве примера. Не исключено появление ошибок.

Базы данных

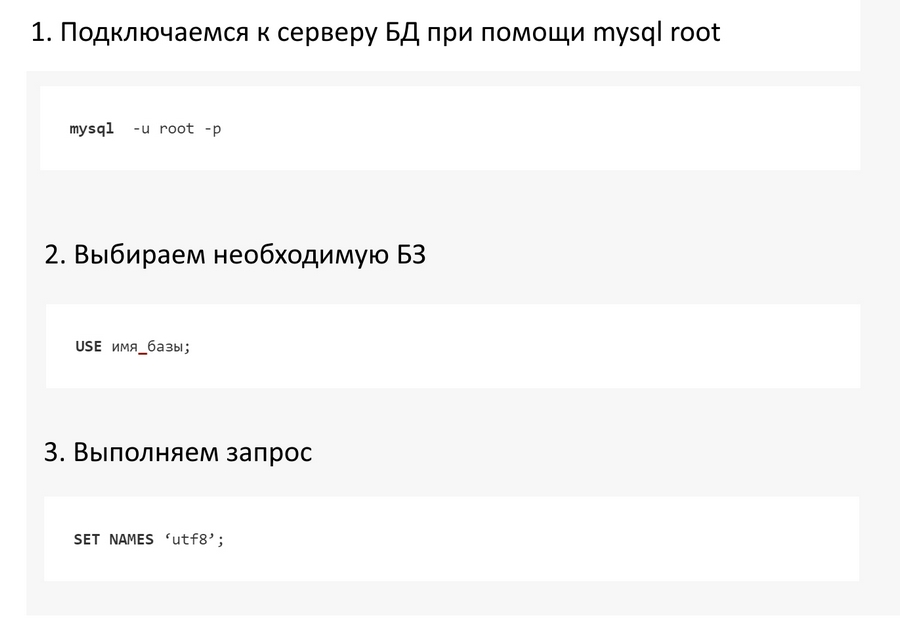

Если «кракозябры» при открытии страниц так и не исчезают, придется проверять MySQL. Нас интересуют значения, прописанные в таблицах баз данных. Чтобы устранить эту проблему, необходимо подключиться к серверу через mysql root. Для этого выполняем следующие шаги:

Так мы приведем кодировку БД к единому стандарту UTF-8.

Онлайн-декодеры

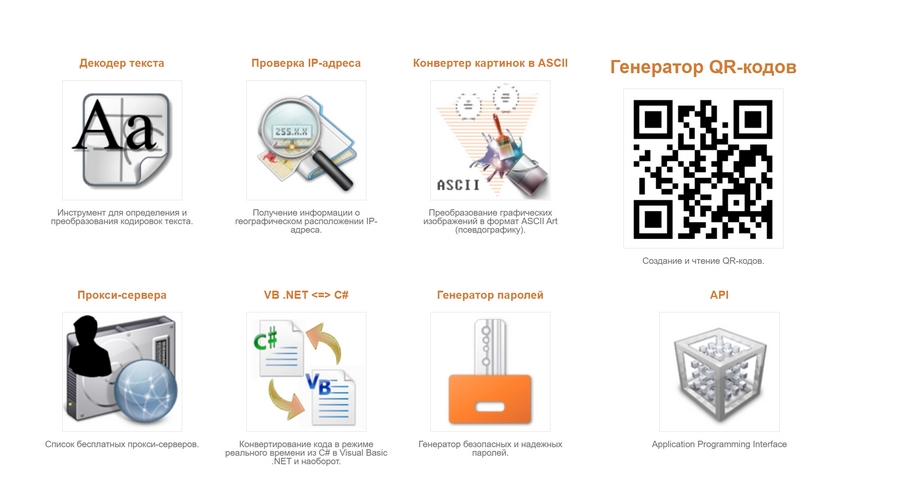

Онлайн-декодеры и другие инструменты с аналогичным функционалом позволяют преобразовать «кракозябру» в читаемый текст. Foxtools – приятный и удобный декодер, который работает в автоматическом режиме. У Foxtools вообще много полезных инструментов:

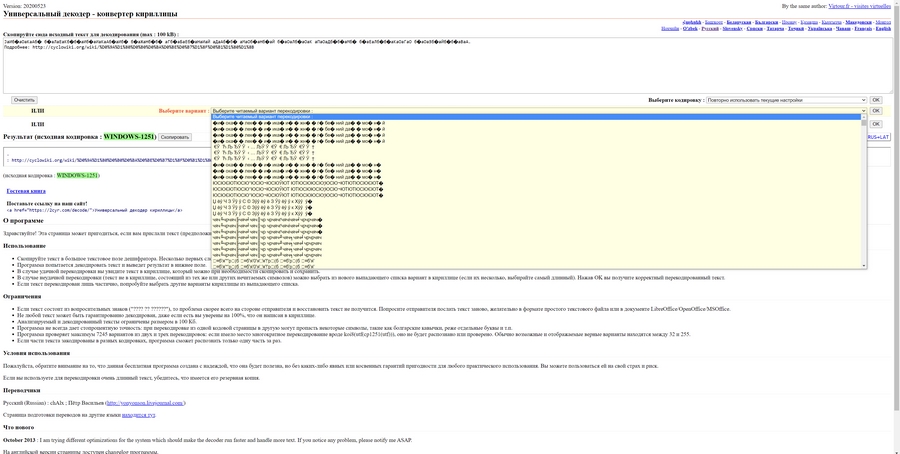

2cyr – еще более функциональный инструмент, который не только преобразует «кракозябры» в читаемый текст, но и выводит множество возможных вариантов. Бывает и такое, что все варианты «расшифровки» являются некорректными:

Итоги

Чтобы вовремя идентифицировать проблемы с кодировкой на своем сайте, используйте перечисленные выше инструменты. Не забывайте и об онлайн-декодерах: они эффективно расшифровывают нечитаемый текст в случаях, когда необходимо быстро преобразовать «кракозябру». Помните, что иероглифы на сайте недопустимы, и устранять такие ошибки нужно как можно скорее. В противном случае ухудшатся поведенческие факторы, и сайт может навсегда выпасть из поисковой выдачи.

Пусть — булевое множество. Рассмотрим и расстояние Хемминга . Пусть — разделяемый код постоянной длины. Обозначим .

Содержание

- 1 Коды, обнаруживающие и исправляющие ошибки

- 2 Булев шар

- 3 Определение и устранение ошибок в общем случае

- 4 Граница Хэмминга, граница Гильберта

- 5 См. также

Коды, обнаруживающие и исправляющие ошибки

| Определение: |

| Код обнаруживает ошибок, если . |

| Определение: |

| Код исправляет ошибок, если . |

| Утверждение: |

|

Код, исправляющий ошибок, обнаруживает ошибок. |

Булев шар

| Определение: |

| Булев шар — подмножество вида . называется его центром, — радиусом. Булев шар с центром и радиусом обознчается . |

| Определение: |

| Обьёмом шара в называется величина . Обьём шара радиуса в обозначается . |

| Утверждение: |

|

Обьём шара не зависит от его центра. |

|

Заметим, что шар всегда можно получить из другого шара с помощью «параллельного переноса» на вектор (здесь обозначает побитовый ), т.е. . |

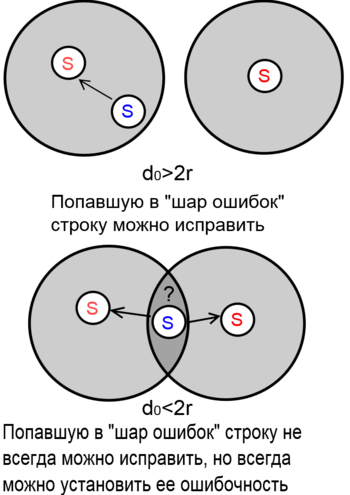

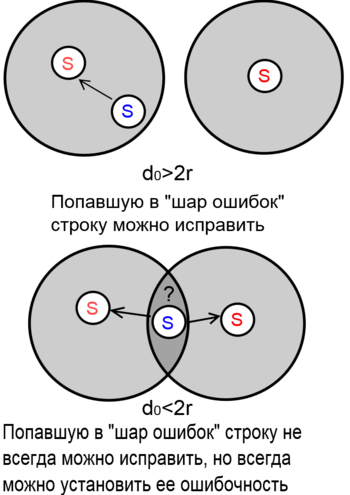

Можно сформулировать свойство кодов, исправляющих ошибок, в терминах булевых шаров.

| Лемма: |

|

Пусть — код, исправляющий ошибок. |

| Доказательство: |

|

Т.к код исправляет ошибок, по определению . Допустим, такие, что и , т.е существует , такой что и . Тогда по неравенству треугольника . Это противоречит тому, что . |

Определение и устранение ошибок в общем случае

Пусть — исходный алфавит, — кодирование,

— расстояние Хэмминга между двумя кодами.

Код, может исправлять и обнаруживать ошибок. Действительно, при любом натуральном количестве допустимых ошибок любоое кодовое слово образует вокруг себя проколотый шар таких строк , что . Если этот шар не содержит других кодов (что выполняется при ) , то можно утверждать, что если в него попадает строка, то она ошибочна. Если шары всех кодов не пересекаются (что выполняется при ), то попавшую в шар строку можно считать ошибочной и исправить на центр шара — строку .

Граница Хэмминга, граница Гильберта

| Теорема (Граница Хэмминга): |

|

Пусть — код для -символьного алфавита, исправляющий ошибок. |

| Доказательство: |

|

Это прямое следствие предыдущей леммы. Их суммарный обьём равен , и он не может превосходить общее число возможных веткоров . |

Граница Хэмминга даёт верхнюю оценку на скорость передачи сообщений в канале с ошибками.

Прологарифмировав неравенство, получим .

Здесь это плотность кодирования, количество информации в одном символе алфавита на размер кода.

Таким образом, при кодировании с защитой от ошибок падает скорость передачи.

Аналогично составляется оценка в другую сторону.

| Теорема (Граница Гильберта): |

|

Если выполнено неравенство , то существует код для -символьного алфавита , исправляющий ошибок. |

Примером кода для случая является код Хэмминга.

См. также

- Избыточное кодирование, код Хэмминга

Процедура

декодирования циклического кода с

обнаружением ошибок, по аналогии с

процессом кодирования основана на

использовании свойства делимости без

остатка кодового многочлена Р(x)

циклического (n,m)-кода

на порождающий многочлен g(x).

Поэтому алгоритм декодирования включает

в себя деление принятого кодового слова,

описываемого многочленом F(x)

на g(x),

вычисление и анализ остатка R(x).

Если R(x)=0,

то принятое кодовое слово считается

неискаженным. Если R(x)0,

то принятое кодовое слово стирается и

формируется сигнал «ошибка».

2 Способы декодирования с исправлением ошибок

Декодирование

заключается в определении номера

искаженного разряда и его автоматического

исправления. А также отделения

информационных разрядов от контрольных.

Рассмотрим три

методики декодирования

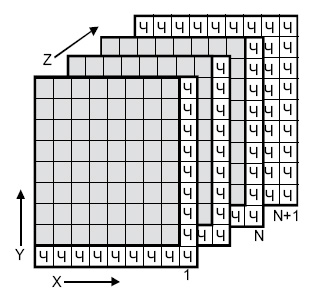

Определение

искаженного разряда с помощью матрицы

ошибок.

Матрица одиночных

ошибок имеет вид

,

где

—

единичная матрица;— прямоугольная проверочная матрица.

Строки матрицы

определяются из выражений

— остаток от деления

на образующий полином

,

где

— значениеi-той

строки матрицы

;

i

— номер строки матрицы

.

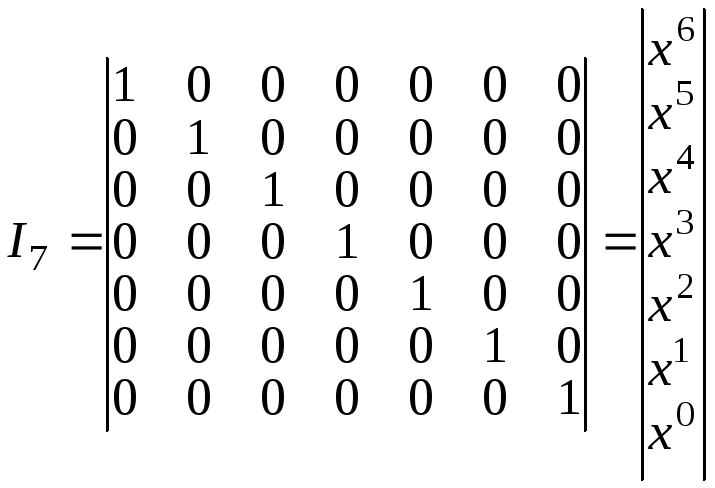

Пример. Матрица

для (7,4)-кода на основе порождающего

многочленаимеет вид

Единичная матрица

размерности 7х7

Рассчитаем

проверочную матрицу

.

При

.

Определим остаток

от деления

на образующий полином

.

.

При

.

Определим остаток

от деления

на образующий полином

.

.

При

.

Определим остаток

от деления

на образующий полином

.

111.

При

.

101.

При

.

100.

При

.

010.

При

.

001.

Тогда матрица

ошибок

Для определения

искаженного разряда необходимо определить

остаток от деления принятой кодовой

комбинации

на порождающий многочлен

.

Пример

Внесем искажения

в четвертый разряд

Находим остаток

|

1 |

|

|

1 |

|

|

1 1 1 1 |

|

|

|

|

|

0 0 1 0 0 0 |

|

|

|

|

|

1 0 1 |

— |

Н

строку в матрице ошибок с полученным

остатком (синдромом) 1 0 1

Искаженный разряд

– это разряд в данной строке, в которой

стоит «1».

Искаженный разряд

исправляем посредством сложения строки

в матрице ошибок с полученной комбинацией

Сообщение исправлено.

Метод

дополнительного деления первоначального

остатка на образующий многочлен

Метод дополнительного

деления основывается на предыдущем

методе т.к. каждый такт дополнительного

деления (приписывания нуля справа)

соответствует переходу от данной строки

матрицы ошибок (строка с первоначальным

остатком) к строке следующей вверх

матрицы.

Дополнительное

деление продолжается до получения

остатка с «1» в первом разряде и нулями

в остальных разрядах, потому что этот

остаток равен остатку последней строки

матрицы ошибок. Отсчет искаженного

разряда производится от старшего разряда

сообщения, по количеству тактов

дополнительного деления. Такой отсчет

соответствует возвратному движению в

матрице ошибок.

Пример.

Внесем искажения

в четвертый разряд

Находим остаток

|

1 |

|

|

1 |

|

|

1 1 1 1 |

|

|

|

|

|

0 0 1 0 0 0 |

|

|

|

|

|

1 0 1 |

— |

Д

деление

|

|

Дополнительное |

|

1 |

|

|

|

Дополнительное |

|

1 |

|

|

|

Дополнительное |

|

1 |

|

|

0 |

— |

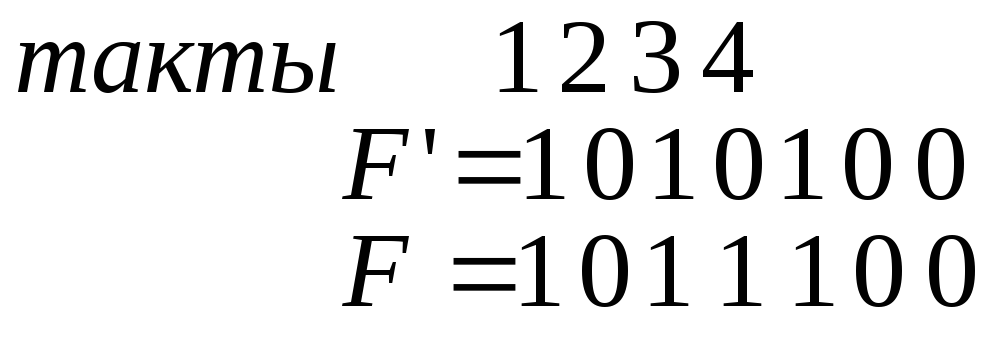

Понадобилось 4

такта дополнителоного деления. Тогда

Четвертый такт

указывает номер искаженного разряда,

который исправляем.

Метод циклических

сдвигов

Метод циклических

сдвигов заключается в следующем:

-

Находится

остаток от деления

на

.

Если остаток равен нулю, то ошибок нет. -

Если

остаток отличен от нуля, определяется

вес остатка

и выполнения условия

,

где—

количество исправляемых ошибок.

Если условие

выполняется, то производится суммирование

по модулю 2 полученного остатка с

комбинацией, из которой он получен.

Затем производятся сдвиги вправо столько

раз сколько было сделано сдвигов влево

В результате получаем исправленной

сообщение.

-

Если

вес остатка больше кратности исправляемых

разрядов, то производится сдвиг влево

полученной комбинации, т.е. умножение

кодовой комбинации на

.

И снова находится остаток от деления

и переход к п.2.

Пример.

,

.

Внесем искажения

в четвертый разряд

.

Находим остаток

1 0 1.

Вес остатка

.

1-й циклический

сдвиг

Находим остаток

|

0 |

|

|

1 |

|

|

0 |

|

|

1 |

|

|

1 |

— |

Вес остатка

.

2-й циклический

сдвиг

Находим остаток

|

1 |

|

|

1 |

|

|

1 |

|

|

1 |

|

|

1 |

|

|

1 |

|

|

0 |

— |

Вес остатка

.

3-й циклический

сдвиг

Находим остаток

|

0 |

|

|

1 |

|

|

0 |

|

|

1 |

|

|

0 |

|

|

1 |

|

|

0 |

— |

Вес остатка

.

4-й циклический

сдвиг

Находим остаток

|

1 0 0 1 0 1 0 |

|

|

|

|

|

0 1 0 0 0 |

|

|

|

|

|

0 1 0 1 1 |

|

|

1 1 0 1 |

|

|

0 1 1 0 0 |

|

|

1 1 0 1 |

|

|

0 0 0 01 |

— |

Вес остатка

.

Вес равен «1»

поэтому циклические сдвиги закончились.

Теперь необходимо остаток сложить с

той комбинацией, с которой мы его получили

|

1 0 0 1 0 1 0 |

|

|

|

1 0 0 1 0 1 1 |

Затем производятся

сдвиги вправо столько раз, сколько было

сделано сдвигов влево

1 0 0 1 0 1 1

1-й сдвиг

1 1 0 0 1 0 1

2-й сдвиг

1 1 1 0 0 1 0

3-й сдвиг

0 1 1 1 0 0 1

4-й сдвиг

1 0 1 1 1 0 0

Сообщение исправлено

.

Свойства

циклических кодов по обнаружению ошибок

Свойства циклических

кодов полностью определяются выбранным

порождающим (образующим) многочленом

.

I. Если порождающий

многочлен

содержит более одного члена, то циклический

код обнаруживает все одиночные ошибки.

При представлении циклического кода

многочленами одиночная ошибка описывается

одночленом,

где— указывает номер искаженного разряда

.

Поскольку одночлен не делится на

многочлен без остатка, то ошибка будет

обнаружена.

2. Циклический код

с порождающим многочленом

обнаруживает все нечетные ошибки.

Используя правила построения проверочной

матрицы для,

получим.

При такой проверочной матрице остаток

определяется суммой по модулю 2 всех

элементов принятой кодовой комбинации

(проверка на четность). Поэтому все

искажения на нечетном количестве позиций

будут обнаружены.

3. Циклический код

обнаруживает все одиночные и двукратные

ошибки, если разрядность кода

не больше длины цикла

используемого порождающего многочлена,

т.е..

Под длиной цикла многочлена понимают

минимальный показатель степени двучлена,

при котором этот двучлен делится без

остатка на образующий многочлен.

4. Циклический код

с многочленом

степени

обнаруживает все групповые ошибки

длительностью вразрядов и менее. Любая групповая ошибка

вразрядов описывается многочленом

степени,

т.е..

Многочлен же степенина многочлен степени

не делится и, таким образом, ошибка

обнаруживается.

5. Циклический код

с порождающим многочленом

степени

не обнаруживает

часть ошибок

-й

кратности.

6. Циклический код

с порождающим многочленом

степени

не обнаруживает

часть ошибок более

-й

кратности.

Анализируя

перечисленные свойства циклического

кода, можно увидеть, что способности

кода по обнаружению и исправлению ошибок

полностью определяются выбранным

образующим многочленом

.

При обнаружении

ошибок стандартные многочлены имеют

вид:

,

при длине кодовой комбинации

,

или

,

при длине кодовой комбинации

;

,

при длине кодовой комбинации

.

Разработан ряд

методик по выбору порождающего многочлена

.

В литературе коды называют по фамилиям

ученых, предложивших ту или иную методику.

Так получили свое название коды

Боуза-Чоудхури-Хоквингема (БЧХ), коды

Рида-Соломона, коды Файра и др.

Укороченные

циклические коды

Циклические коды

предполагают равенство разрядности

формируемой кодовой комбинации длине

цикла порождающего

многочлена, т.е.

.

Однако, это требование на практике

трудно выполнимо, поскольку разрядность

комбинаций, выдаваемых источником

информации, зачастую отличается от

целесообразной, в результате чего.

В этих случаях циклический код

преобразуют

и используют так называемый укороченный

циклический код, который получается из

циклического путем исключения в нем

определенного числа разрядов.

При этом число

столбцов проверочной матрицы

уменьшается на величину, равную числу

исключаемых информационных разрядов,

причем исключаются столбцы с наивысшими

номерами. Свойства кода по обнаружению

ошибок при этом не изменяются.

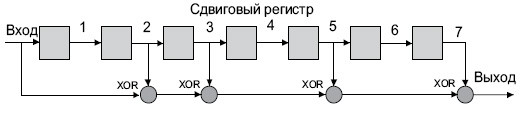

Принципы построения

кодирующих и декодирующих устройств

циклических кодов

Кодирующие и

декодирующие устройства циклических

кодов строятся на основе регистров с

обратными связями. Такие регистры иногда

называют многотактными линейными

переключающими схемами. При кодировании

и декодировании циклических кодов

получаемый остаток содержит число

разрядов, равное показателю степени

порождающего многочлена

.

Поэтому регистр с обратными связями

(ОС) должен содержатьячеек памяти. Как ранее указывалось,

столбцы проверочной матрицыявляются остатками от деления одночлена

на

.

Разделить жепри помощи регистра с ОС это значит

осуществить сдвиг записанной в этот

регистр „1″ натактов после ввода ее в первую ячейку.

Таким образом, при каждом сдвиге

записанной в регистр „1” должен

получаться остаток, соответствующий

делениюна

.

Следовательно, содержание регистра при

каждом тактовом сдвиге должно

соответствовать содержанию столбца

проверочной матрицы.

В качестве примера

на рис. 8.15 показаны схема регистра с ОС

для порождающего многочлена

и состояние ячеек этого регистра при

сдвиге «1» записанных в первую ячейку

(табл. 8.19). На конкретном примере покажем,

что данный регистр производит операцию

деления.

Пусть требуется

закодировать кодовую комбинацию вида

1 1 0 1, многочлен которой имеет вид

.

Разделим многочлен

и отметим остатки, полученные перед

каждым следующим тактом деления:

|

х |

х |

||||

|

|

х |

||||

|

x5+ |

|||||

|

|

x5+ |

||||

|

x4 |

|||||

|

|

x4 |

||||

|

х3+ |

|||||

|

|

х |

||||

|

1 |

— |

|

|||

Рис. 8.15. Схема

регистра с ОС для порождающего многочлена

.

Табл. 8.19. К пояснению

процесса кодирования

Деление сводится

к последовательному сложению по модулю

2 делителя со старшими разрядами делимого

или полученного остатка. Регистр с

обратными связями производит аналогичные

операции. Определим содержание регистра

перед каждым тактом деления и сравним

их с остатками, полученными путем

обычного деяния.

Процесс деления

в регистре производится только при

поступлении «1» в цепь обратной

связи. Поэтому содержание регистра, при

котором «1» находится в последней

ячейке, будет являться остатком перед

следующим тактом деления. В табл. 8.19

показано содержание ячеек регистра по

тактам. Сравнение остатков, полученных

как при обычном делении, так и при делении

с помощью регистра, показывает, что они

полностью совпадают.

Регистры с обратными

связями в соответствии с выбранным

порождающим многочленом строятся по

следующим правилам:

1. Число ячеек

регистра выбирают равным степени

порождающего многочлена

.

2. Количество

сумматоров по модулю 2 берется на единицу

меньше числа ненулевых членов порождающего

многочлена.

3. Входы всех ячеек

регистра обозначают

.

Выход последней ячейки обозначается, а вход первой —

.

Рис 8.16. Схема

регистра с ОС для порождающего многочлена

с обозначением

.

4. Сумматоры по

модулю 2 устанавливаются на входе тех

ячеек, для которых в формуле порождающего

многочлена

имеет ненулевое значение. Например, для

(рис. 8.16) сумматоры устанавливаются на

входах ячеек 1 и 2 триггеров.

5. Выход последней

ячейки соединяется со входами сумматоров.

6. Выходы предыдущих

ячеек соединяются со входами последующих

через сумматоры или без них, в зависимости

от того, установлены они между ячейками

или нет.

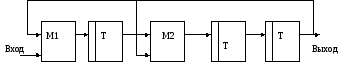

Рис.26.2

Кодирующее устройство

Структурная схема

кодирующего устройства при порождающем

многочлене

показана на рис.8.17. В регистре с обратными

связями передаваемая кодовая комбинация

делится на исходный многочлен. При

помощи линии задержки передаваемая

комбинация смещается наразрядов (в данном случае

=4),

что равносильно умножению многочлена,

отображающего передаваемую кодовую

комбинацию, на.

Устройство

функционирует следующим образом.

Передаваемая кодовая комбинация

последовательно подается на вход

регистра и линии задержки. Ключ

находится в положений «1» ключ

— в положении «Включено»

(рис.8.18).

После того как

последний импульс с выхода линии задержки

передан в линию связи, ключ

.

переключается в положение ,, 2″— в положение „Выключено» и содержимое

регистра (остаток от деления) передается

в линию связи (рис.8.19).

Приведенная схема

кодирующего устройства обладает одним

существенным недостатком. Кодированное

сообщение задерживается на число тактов,

равное числу ячеек регистра. Устранить

такой недостаток можно при использовании

кодирующего.устройства без линии

задержки. В качестве примера на рис.8.20

изображена структурная схема такого

устройства с

.

Регистры с обратными

связями для таких кодирующих устройств

строятся по правилам, указанным ранее.

Однако один из сумматоров устанавливается

не на входе первой ячейки памяти, а на

выходе последней ячейки.

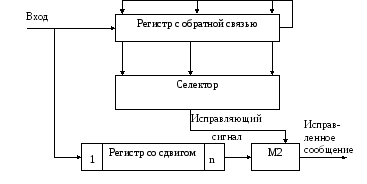

Декодирующие

устройства также строятся на основе

использования регистров с обратными

связями. На рис.8.21 приведена структурная

схема декодирующего устройства,

предназначенного для обнаружения

ошибок. После приема кодовой комбинации

в регистре с обратными связями образуется

остаток

.

Если этот остаток равен 0, то сигнал

запрета на выдачу принятой кодовой

комбинации потребителю не выдается.

При использовании

циклических кодов в качестве кодов с

исправлением ошибок схема декодирующего

устройства усложняется.

Кратко рассмотрим

методику построения таких декодирующих

устройств для наиболее простого метода

исправления ошибок -последовательного.

Этот метод основан

на следующем свойстве. Если возникшая

в кодовой комбинации ошибка исправляема,

то после введения принятой кодовой

комбинации в регистр с ОС можно

восстановить вектор ошибок. После

поразрядного сложения этого вектора с

вектором, отображающим принятую кодовую

комбинацию, ошибка исправляется.

Структурная схема такого декодирующего

устройства приведена на рис.8.22.

Принятая кодовая

комбинация поразрядно поступает в

регистр со сдвигом и в регистр с ОС.

Затем принятая комбинация последовательным

кодом через сумматор по модулю 2 (М2)

выдается потребителю. В то время, когда

искаженный разряд будет на выходе

регистра со сдвигом, при исправляемых

кодом ошибках содержание регистра с ОС

будет вполне определенным. Селектор

выделяет эту известную кодовую комбинацию

и выдает на сумматор по модулю 2 импульс

для исправления искаженного разряда.

Одновременно в регистр с ОС записывается

кодовая комбинация, при помощи которой

устраняется влияние исправленного

разряда на содержание этого регистра.

Рис 8.22. Декодирующее

устройство с исправлением ошибок

Вероятности

ошибочного декодирования циклических

кодов

Вектором ошибки

называется двоичная последовательность

длины

,

в которой единицы стоят на позициях

символов принятых с ошибкой. Отсюда

вероятность не обнаружения ошибки

заданным кодом равна вероятности

появления в заданном дискретном канале

векторов ошибок, совпадающих с кодовыми

словами

Относительно

просто эти вероятности могут быть

рассчитаны для двоичного симметричного

канала без памяти. В таком канале каждый

двоичный символ с некоторой фиксированной

вероятностью

принимается правильно и с вероятностью

изменяется помехой на обратный.

Передача/прием каждого символа полагается

событием независимым (канал без памяти).

Если по такому

каналу передается кодовое слово длины

,

то вероятность

того, что не произойдет ни одной ошибки,

равна.

Вероятность

того, что

будет одна ошибка в заданном символе,

равна

.

Вероятность того,

что слово на выходе канала будет

отличаться от переданного слова в

заданных

разрядах, т.е. вектор ошибок содержит

единиц, равна

.

Вероятность того,

что слово на выходе канала будет

отличаться от переданного слова в

любых

разрядах, равна

,

где

—

число сочетаний из

по

.

Предположим, что

некоторый линейный код (5,3) содержит

одно нулевое слово (как всякий линейный

код), два слова, вес которых равен 2,

четыре слова — весом 3, одно слово —

весом 4 (всего

слов).

Вероятность

необнаруживаемой этим кодом ошибки

равна вероятности появления в ДСК

векторов ошибок, совпадающих с кодовыми

словами, т.е.:

В режиме исправления

ошибок декодер вычисляет остаток

от деления

принятой последовательности

на

.

Этот остаток

называют синдромом.

Принятый

полином

представляет

собой сумму по модулю 2 переданного

слова

и вектора

ошибок

:

.

Тогда синдром

,

так как по

определению циклического кода

.

Некоторому синдрому

может быть

поставлен в соответствие определенный

вектор ошибок

.

Тогда

переданное слово

находят, складывая

.

Однако один и тот

же синдром может соответствовать

различным

векторам ошибок. Предположим, синдром

соответствует вектору ошибок

.

Но и все векторы ошибок, равные сумме,

где— любое кодовое слово, будут давать тот

же синдром. Поэтому, поставив в соответствие

синдромувектор ошибок

,

мы будем

осуществлять правильное декодирование

в случае, когда действительно вектор

ошибок равен

,

во всех остальныхслучаях декодирование будет ошибочным.

Для уменьшения

вероятности ошибки декодирования из

всех возможных векторов ошибок, дающих

один и тот же синдром, следует выбирать

в качестве исправляемого наиболее

вероятный в заданном канале.

Например, для

двоичного симметричного канала, в

котором вероятность

ошибочного

приема двоичного символа существенно

меньше вероятности

правильного

приема, вероятность появления векторов

ошибок уменьшается с увеличением их

веса

.

В этом случае следует исправлять в

первую очередь вектор ошибок меньшего

веса.

Если кодом могут

быть исправлены только все векторы

ошибок веса

и меньше, то любой вектор ошибки веса

отдоп будет

приводить к ошибочному декодированию.

Вероятность

ошибочного декодирования будет равна

вероятности

появления

векторов ошибок веса

и больше в заданном канале. Для ДСК эта

вероятность будет равна

Общее число

различных векторов ошибок, которые

может исправлять циклический код,

равно числу ненулевых синдромов

.

Соседние файлы в папке Пособие ТЕЗ_рус12

- #

- #

- #

- #

- #

- #

- #

- #

- #

6.5.1. Весовой коэффициент двоичных векторов и расстояние между ними

6.5.2. Минимальное расстояние для линейного кода

6.5.3. Обнаружение и исправление ошибок

6.5.3.1. Распределение весовых коэффициентов кодовых слов

6.5.3.2.Одновременное обнаружение и исправление ошибок

6.5.4. Визуализация пространства 6-кортежей

6.5.5. Коррекция со стиранием ошибок

6.5.1. Весовой коэффициент двоичных векторов и расстояние между ними

Конечно же, понятно, что правильно декодировать можно не все ошибочные комбинации. Возможности кода для исправления ошибок в первую очередь определяются его структурой. Весовой коэффициент Хэмминга (Hamming weight) w(U) кодового слова U определяется как число ненулевых элементов в U. Для двоичного вектора это эквивалентно числу единиц в векторе. Например, если U=100101101, то w(U) = 5. Расстояние Хэмминга (Hamming distance) между двумя кодовыми словами U и V, обозначаемое как d(U, V), определяется как количество элементов, которыми они отличаются.

U=100101101

V=011110100

d(U,V)=6

Согласно свойствам сложения по модулю 2, можно отметить, что сумма двух двоичных векторов является другим двоичным вектором, двоичные единицы которого расположены на тех позициях, которыми эти векторы отличаются.

U + V=111011001

Таким образом, можно видеть, что расстояние Хэмминга между двумя векторами равно весовому коэффициенту Хэмминга их суммы, т.е. d(U, V) = w(U + V). Также видно, что весовой коэффициент Хэмминга кодового слова равен его расстоянию Хэмминга до нулевого вектора.

6.5.2. Минимальное расстояние для линейного кода

Рассмотрим множество расстояний между всеми парами кодовых слой в пространстве Vn. Наименьший элемент этого множества называется минимальным расстоянием кода и обозначается dmin. Как вы думаете, почему нас интересует именно минимальное расстояние, а не максимальное? Минимальное расстояние подобно наиболее слабому звену в цепи, оно дает нам меру минимальных возможностей кода и, следовательно, характеризует его мощность.

Как обсуждалось ранее, сумма двух произвольных кодовых слов дает другой элемент пространства кодовых слов. Это свойство линейных кодов формулируется просто: если U и V — кодовые слова, то и W = U + V тоже должно быть кодовым словом. Следовательно, расстояние между двумя кодовыми словами равно весовому коэффициенту третьего кодового слова, т.е. d(U, V) = w(U + V) = w(W). Таким образом, минимальное расстояние линейного кода можно определить, не прибегая к изучению расстояний между всеми комбинациями пар кодовых слов. Нам нужно лишь определить вес каждого кодового слова (за исключением нулевого вектора) в подпространстве; минимальный вес соответствует минимальному расстоянию dmin. Иными словами, dmin соответствует наименьшему из множества расстояний между нулевым кодовым словом и всеми остальными кодовыми словами.

6.5.3. Обнаружение и исправление ошибок

Задача декодера после приема вектора r заключается в оценке переданного кодового слова Ui. Оптимальная стратегия декодирования может быть выражена в терминах алгоритма максимального правдоподобия (см. приложение Б); считается, что передано было слово Ui, если

(6.41)

Поскольку для двоичного симметричного канала (binary symmetric channel — BSC) правдоподобие Ui относительно r обратно пропорционально расстоянию между r и U, можно сказать, что передано было слово Ui, если

(6.42)

Другими словами, декодер определяет расстояние между r и всеми возможными переданными кодовыми словами Uj, после чего выбирает наиболее правдоподобное Uj, для которого

(6.43)

где М = 2k — это размер множества кодовых слов. Если минимум не один, выбор между минимальными расстояниями является произвольным. Наше обсуждение метрики расстояний будет продолжено в главе 7.

На рис. 6.13 расстояние между двумя кодовыми словами U и V показано как расстояние Хэмминга. Каждая черная точка обозначает искаженное кодовое слово. На рис. 6.13, а проиллюстрирован прием вектора r1 находящегося на расстоянии 1 от кодового слова U и на расстоянии 4 от кодового слова V. Декодер с коррекцией ошибок, следуя стратегии максимального правдоподобия, выберет при принятом векторе r1 кодовое слово U. Если r1 получился в результате появления одного ошибочного бита в переданном векторе кода U, декодер успешно исправит ошибку. Но если же это произошло в результате 4-битовой ошибки в векторе кода V, декодирование будет ошибочным. Точно так же, как показано на рис. 6.13, б, двойная ошибка при передаче U может привести к тому, что в качестве переданного вектора будет ошибочно определен вектор r2, находящийся на расстоянии 2 от вектора U и на расстоянии 3 от вектора кода V. На рис. 6.13 показана ситуация, когда в качестве переданного вектора ошибочно определен вектор r3, который находится на расстоянии 3 от вектора кода U и на расстоянии 2 от вектора V. Из рис. 6.13 видно, что если задача состоит только в обнаружении ошибок, а не в их исправлении, то можно определить искаженный вектор — изображенный черной точкой и представляющий одно-, двух-, трех- и четырехбитовую ошибку. В то же время пять ошибок при передаче могут привести к приему кодового слова V, когда в действительности было передано кодовое слово U; такую ошибку невозможно будет обнаружить.

Из рис. 6.13 можно видеть, что способность кода к обнаружению и исправлению ошибок связана с минимальным расстоянием между кодовыми словами. Линия решения на рисунке служит той же цели, что и в процессе демодуляции, — для разграничения областей решения.

а)

б)

в)

Рис. 6.13. Возможности определения и исправления ошибок: а) принятый вектор r1; б) принятый вектор r2; в) принятый вектор r3

В примере, приведенном на рис. 6.13, критерий принятия решения может быть следующим: выбрать U, если r попадает в область 1, и выбрать V, если r попадает в область 2. Выше показывалось, что такой код (при dmin = 5) может исправить две ошибки. Вообще, способность кода к исправлению ошибок t определяется, как максимальное число гарантированно исправимых ошибок на кодовое слово, и записывается следующим образом [4].

(6.44)

Здесь означает наибольшее целое, не превышающее х. Часто код, который исправляет все искаженные символы, содержащие ошибку в t или меньшем числе бит, также может исправлять символы, содержащие t +1 ошибочных бит. Это можно увидеть на рис. 6.11. В этом случае dmin = 3, поэтому из уравнения (6.44) можно видеть, что исправимы все ошибочные комбинации из t = 1 бит. Также исправима одна ошибочная комбинация, содержащая / +1 (т.е. 2) ошибочных бит. Вообще, линейный код (n, k), способный исправлять все символы, содержащие t ошибочных бит, может исправить всего 2n—k ошибочных комбинаций. Если блочный код с возможностью исправления символов, имеющих ошибки в t бит, применяется для исправления ошибок в двоичном симметричном канале с вероятностью перехода р, то вероятность ошибки сообщения Рм(вероятность того, что декодер совершит неправильное декодирование и п-битовый блок содержит ошибку) можно оценить сверху, используя уравнение (6.18).

(6.45)

Оценка переходит в равенство, если декодер исправляет все ошибочные комбинации, содержащие до t ошибочных бит включительно, но не комбинации с числом ошибочных бит, большим t. Такие декодеры называются декодерами с ограниченным расстоянием. Вероятность ошибки в декодированном бите РB зависит от конкретного кода и декодера. Приближенно ее можно выразить следующим образом [5].

(6.46)

В блочном коде, прежде чем исправлять ошибки, необходимо их обнаружить. (Или же код может использоваться только для определения наличия ошибок.) Из рис. 6.13 видно, что любой полученный вектор, который изображается черной точкой (искаженное кодовое слово), можно определить как ошибку. Следовательно, возможность определения наличия ошибки дается следующим выражением.

(6.47)

Блочный код с минимальным расстоянием dmin гарантирует обнаружение всех ошибочных комбинаций, содержащих dmin — 1 или меньшее число ошибочных бит. Такой код также способен обнаружить и большую ошибочную комбинацию, содержащую dmin или более ошибок. Фактически код (n, k) может обнаружить 2n – 2k ошибочных комбинаций длины п. Объясняется это следующим образом. Всего в пространстве 2n n-кортежей существует 2n -1 возможных ненулевых ошибочных комбинаций. Даже правильное кодовое слово — это потенциальная ошибочная комбинация. Поэтому всего существует 2k -1 ошибочных комбинаций, которые идентичны 2k -1 ненулевым кодовым словам. При появлении любая из этих 2k — 1 ошибочных комбинаций изменяет передаваемое кодовое слово Uj на другое кодовое слово Uj. Таким образом, принимается кодовое слово Uj и его синдром равен нулю. Декодер принимает Uj за переданное кодовое слово, и поэтому декодирование дает неверный результат. Следовательно, существует 2k -1 необнаружимых ошибочных комбинаций. Если ошибочная комбинация не совпадает с одним из 2k кодовых слов, проверка вектора r с помощью синдромов дает ненулевой синдром и ошибка успешно обнаруживается. Отсюда следует, что существует ровно 2n-2k выявляемых ошибочных комбинаций. При больших n, когда 2k<<2n, необнаружимой будет только незначительная часть ошибочных комбинаций.

6.5.3.1. Распределение весовых коэффициентов кодовых слов

Пусть Aj — количество кодовых слов с весовым коэффициентом j в линейном коде (п, k). Числа A0,A1,…,An называются распределением весовых коэффициентов этого кода. Если код применяется только для обнаружения ошибок в двоичном симметричном канале, то вероятность того, что декодер не сможет определить ошибку, можно рассчитать, исходя из распределения весовых коэффициентов кода [5].

(6.48)

где р — вероятность перехода в двоичном симметричном канале. Если минимальное расстояние кода равно dmin значения от А1 до , равны нулю.

Пример 6.5. Вероятность необнаруженной ошибки в коде

Пусть код (6,3), введенный в разделе 6.4.3, используется только для обнаружения наличия ошибок. Рассчитайте вероятность необнаруженной ошибки, если применяется двоичный симметричный канал, а вероятность перехода равна 10-2.

Решение

Распределение весовых коэффициентов этого кода выглядит следующим образом: A0=1, А1= А2 = 0, A3 = 4, A5 = 0, A6 = 0. Следовательно, используя уравнение (6.48), можно записать следующее.

Для р = 10-2 вероятность необнаруженной ошибки будет равна 3,9 х 10-6.

6.5.3.2. Одновременное обнаружение и исправление ошибок

Возможностями исправления ошибок с максимальным гарантированным (t), где t определяется уравнением (6.44), можно пожертвовать в пользу определения класса ошибок. Код можно использовать для одновременного исправления α и обнаружения β ошибок, причем , а минимальное расстояние кода дается следующим выражением [4].

(6.49)

При появлении t или меньшего числа ошибок код способен обнаруживать и исправлять их. Если ошибок больше t, но меньше е+1, где е определяется уравнением (6.47), код может определять наличие ошибок, но исправить может только некоторые из них. Например, используя код с dmin = 7. можно выполнить обнаружение и исправление со следующими значениями α и β.

Заметим, что исправление ошибки подразумевает ее предварительное обнаружение. В приведенном выше примере (с тремя ошибками) все ошибки можно обнаружить и исправить. Если имеется пять ошибок, их можно обнаружить, но исправить можно только одну из них.

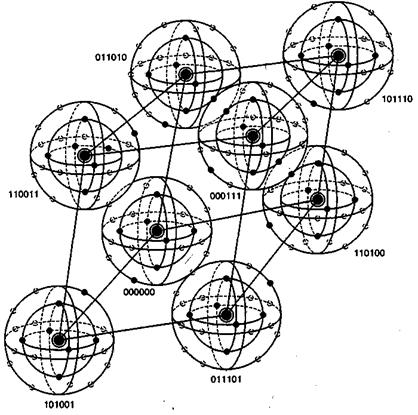

6.5.4. Визуализация пространства 6-кортежей

На рис. 6.14 визуально представлено восемь кодовых слов, фигурирующих в примере из раздела 6.4.3. Кодовые слова образованы посредством линейных комбинаций из трех независимых 6-кортежей, приведенных в уравнении (6.26); сами кодовые слова образуют трехмерное подпространство. На рисунке показано, что такое подпространство полностью занято восемью кодовыми словами (большие черные круги); координаты подпространства умышленно выбраны неортогональными. На рис. 6.14 предпринята попытка изобразить все пространство, содержащее шестьдесят четыре 6-кортежей, хотя точно нарисовать или составить такую модель невозможно. Каждое кодовое слово окружают сферические слои или оболочки. Радиус внутренних непересекающихся слоев — это расстояние Хэмминга, равное 1; радиус внешнего слоя — это расстояние Хэмминга, равное 2. Большие расстояния в этом примере не рассматриваются. Для каждого кодового слова два показанных слоя заняты искаженными кодовыми словами. На каждой внутренней сфере существует шесть таких точек (всего 48 точек), представляющих шесть возможных однобитовых ошибок в векторах, соответствующих каждому кодовому слову. Эти кодовые слова с однобитовыми возмущениями могут быть соотнесены только с одним кодовым словом; следовательно, такие ошибки могут быть исправлены. Как видно из нормальной матрицы, приведенной на рис. 6.11, существует также одна двухбитовая ошибочная комбинация, которая также поддается исправлению. Всего существует

Заметим, что исправление ошибки подразумевает ее предварительное обнаружение. В приведенном выше примере (с тремя ошибками) все ошибки можно обнаружить и исправить. Если имеется пять ошибок, их можно обнаружить, но исправить можно только одну из них.

6.5.4. Визуализация пространства 6-кортежей

На рис. 6.14 визуально представлено восемь кодовых слов, фигурирующих в примере из раздела 6.4.3. Кодовые слова образованы посредством линейных комбинаций из трех независимых 6-кортежей, приведенных в уравнении (6.26); сами кодовые слова образуют трехмерное подпространство. На рисунке показано, что такое подпространство полностью занято восемью кодовыми словами (большие черные круги); координаты подпространства умышленно выбраны неортогональными. На рис. 6.14 предпринята попытка изобразить все пространство, содержащее шестьдесят четыре 6-кортежей, хотя точно нарисовать или составить такую модель невозможно. Каждое кодовое слово окружают сферические слои или оболочки. Радиус внутренних непересекающихся слоев — это расстояние Хэмминга, равное 1; радиус внешнего слоя — это расстояние Хэмминга, равное 2. Большие расстояния в этом примере не рассматриваются. Для каждого кодового слова два показанных слоя заняты искаженными кодовыми словами. На каждой внутренней сфере существует шесть таких точек (всего 48 точек), представляющих шесть возможных однобитовых ошибок в векторах, соответствующих каждому кодовому слову. Эти кодовые слова с однобитовыми возмущениями могут быть соотнесены только с одним кодовым словом; следовательно, такие ошибки могут быть исправлены. Как видно из нормальной матрицы, приведенной на рис. 6.11, существует также одна двухбитовая ошибочная комбинация, которая также поддается исправлению. Всего существует

Рис, 6.14. Пример восьми кодовых слов в пространстве 6-кортежей

При представлении свойств класса кодов, известных как совершенные коды (perfect code), рис. 6.14 весьма полезен. Код, исправляющий ошибки в t битах, называется совершенным, если нормальная матрица содержит все ошибочные комбинации из t или меньшего числа ошибок и не содержит иных образующих элементов классов смежности (отсутствует возможность исправления остаточных ошибок). В контексте рис. 6.14 совершенный код с коррекцией ошибок в t битах — это такой код, который (при использовании обнаружения по принципу максимального правдоподобия) может исправить все искаженные кодовые слова, находящиеся на расстоянии Хэмминга t (или ближе) от исходного кодового слова, и не способен исправить ни одну из ошибок, находящихся на расстоянии, превышающем t.

Кроме того, рис. 6.14 способствует пониманию основной цели поиска хороших кодов. Предпочтительным является пространство, максимально заполненное кодовыми словами (эффективное использование введенной избыточности), а также желательно, чтобы кодовые слова были по возможности максимально удалены друг от друга. Очевидно, что эти цели противоречивы.

6.5.5. Коррекция со стиранием ошибок

Приемник можно сконструировать так, чтобы он объявлял символ стертым, если последний принят неоднозначно либо обнаружено наличие помех или кратковременных сбоев. Размер входного алфавита такого канала равен Q, а выходного —Q + 1; лишний выходной символ называется меткой стирания (erasure flag), или просто стиранием (erasure). Если демодулятор допускает символьную ошибку, то для ее исправления необходимы два параметра, определяющие ее расположение и правильное значение символа. В случае двоичных символов эти требования упрощаются — нам необходимо только расположение ошибки. В то же время, если демодулятор объявляет символ стертым (при этом правильное значение символа неизвестно), расположение этого символа известно, поэтому декодирование стертого кодового слова может оказаться проще исправления ошибки. Код защиты от ошибок можно использовать для исправления стертых символов или одновременного исправления ошибок и стертых символов. Если минимальное расстояние кода равно dmin, любая комбинация из ρ или меньшего числа стертых символов может быть исправлена при следующем условии [6].

(6.50)

Предположим, что ошибки появляются вне позиций стирания. Преимущество исправления посредством стираний качественно можно выразить так: если минимальное расстояние кода равно dmin, согласно уравнению (6.50), можно восстановить dmin-1 стирание. Поскольку число ошибок, которые можно исправить без стирания информации, не превышает (dmin-1)/2, то преимущество исправления ошибок посредством стираний очевидно. Далее, любую комбинацию из α ошибок и γ стираний можно исправить одновременно, если, как показано в работе [6],

(6.51)

Одновременное исправление ошибок и стираний можно осуществить следующим образом. Сначала позиции из у стираний замещаются нулями, и получаемое кодовое слово декодируется обычным образом. Затем позиции из у стираний замещаются единицами, и декодирование повторяется для этого варианта кодового слова. После обработки обоих кодовых слов (одно с подставленными нулями, другое — с подставленными единицами) выбирается то из них, которое соответствует наименьшему числу ошибок, исправленных вне позиций стирания. Если удовлетворяется неравенство (6.51), то описанный метод всегда дает верное декодирование.

Пример 6.6. Коррекция со стиранием ошибок

Рассмотрим набор кодовых слов, представленный в разделе 6.4.3.

000000 110100 011010 101110 101001 011101 110011 000111

Пусть передано кодовое слово 110011, в котором два крайних слева разряда приемник объявил стертыми. Проверьте, что поврежденную последовательность хx0011 можно исправить.

Решение

Поскольку , код может исправить

= 2 стирания. В этом легко убедиться из рис. 6.11 или приведенного выше перечня кодовых слов, сравнивая 4 крайних правых разряда xx00l1 с каждым из допустимых кодовых слов. Действительно переданное кодовое слово — это ближайшее (с точки зрения расстояния Хэмминга) к искаженной последовательности.

To clean up transmission errors introduced by Earth’s atmosphere (left), Goddard scientists applied Reed–Solomon error correction (right), which is commonly used in CDs and DVDs. Typical errors include missing pixels (white) and false signals (black). The white stripe indicates a brief period when transmission was interrupted.

In information theory and coding theory with applications in computer science and telecommunication, error detection and correction (EDAC) or error control are techniques that enable reliable delivery of digital data over unreliable communication channels. Many communication channels are subject to channel noise, and thus errors may be introduced during transmission from the source to a receiver. Error detection techniques allow detecting such errors, while error correction enables reconstruction of the original data in many cases.

Definitions[edit]

Error detection is the detection of errors caused by noise or other impairments during transmission from the transmitter to the receiver.

Error correction is the detection of errors and reconstruction of the original, error-free data.

History[edit]

In classical antiquity, copyists of the Hebrew Bible were paid for their work according to the number of stichs (lines of verse). As the prose books of the Bible were hardly ever written in stichs, the copyists, in order to estimate the amount of work, had to count the letters.[1] This also helped ensure accuracy in the transmission of the text with the production of subsequent copies.[2][3] Between the 7th and 10th centuries CE a group of Jewish scribes formalized and expanded this to create the Numerical Masorah to ensure accurate reproduction of the sacred text. It included counts of the number of words in a line, section, book and groups of books, noting the middle stich of a book, word use statistics, and commentary.[1] Standards became such that a deviation in even a single letter in a Torah scroll was considered unacceptable.[4] The effectiveness of their error correction method was verified by the accuracy of copying through the centuries demonstrated by discovery of the Dead Sea Scrolls in 1947–1956, dating from c.150 BCE-75 CE.[5]

The modern development of error correction codes is credited to Richard Hamming in 1947.[6] A description of Hamming’s code appeared in Claude Shannon’s A Mathematical Theory of Communication[7] and was quickly generalized by Marcel J. E. Golay.[8]

Introduction[edit]

All error-detection and correction schemes add some redundancy (i.e., some extra data) to a message, which receivers can use to check consistency of the delivered message, and to recover data that has been determined to be corrupted. Error-detection and correction schemes can be either systematic or non-systematic. In a systematic scheme, the transmitter sends the original data, and attaches a fixed number of check bits (or parity data), which are derived from the data bits by some deterministic algorithm. If only error detection is required, a receiver can simply apply the same algorithm to the received data bits and compare its output with the received check bits; if the values do not match, an error has occurred at some point during the transmission. In a system that uses a non-systematic code, the original message is transformed into an encoded message carrying the same information and that has at least as many bits as the original message.

Good error control performance requires the scheme to be selected based on the characteristics of the communication channel. Common channel models include memoryless models where errors occur randomly and with a certain probability, and dynamic models where errors occur primarily in bursts. Consequently, error-detecting and correcting codes can be generally distinguished between random-error-detecting/correcting and burst-error-detecting/correcting. Some codes can also be suitable for a mixture of random errors and burst errors.

If the channel characteristics cannot be determined, or are highly variable, an error-detection scheme may be combined with a system for retransmissions of erroneous data. This is known as automatic repeat request (ARQ), and is most notably used in the Internet. An alternate approach for error control is hybrid automatic repeat request (HARQ), which is a combination of ARQ and error-correction coding.

Types of error correction[edit]

There are three major types of error correction.[9]

Automatic repeat request[edit]

Automatic repeat request (ARQ) is an error control method for data transmission that makes use of error-detection codes, acknowledgment and/or negative acknowledgment messages, and timeouts to achieve reliable data transmission. An acknowledgment is a message sent by the receiver to indicate that it has correctly received a data frame.

Usually, when the transmitter does not receive the acknowledgment before the timeout occurs (i.e., within a reasonable amount of time after sending the data frame), it retransmits the frame until it is either correctly received or the error persists beyond a predetermined number of retransmissions.

Three types of ARQ protocols are Stop-and-wait ARQ, Go-Back-N ARQ, and Selective Repeat ARQ.

ARQ is appropriate if the communication channel has varying or unknown capacity, such as is the case on the Internet. However, ARQ requires the availability of a back channel, results in possibly increased latency due to retransmissions, and requires the maintenance of buffers and timers for retransmissions, which in the case of network congestion can put a strain on the server and overall network capacity.[10]

For example, ARQ is used on shortwave radio data links in the form of ARQ-E, or combined with multiplexing as ARQ-M.

Forward error correction[edit]

Forward error correction (FEC) is a process of adding redundant data such as an error-correcting code (ECC) to a message so that it can be recovered by a receiver even when a number of errors (up to the capability of the code being used) are introduced, either during the process of transmission or on storage. Since the receiver does not have to ask the sender for retransmission of the data, a backchannel is not required in forward error correction. Error-correcting codes are used in lower-layer communication such as cellular network, high-speed fiber-optic communication and Wi-Fi,[11][12] as well as for reliable storage in media such as flash memory, hard disk and RAM.[13]

Error-correcting codes are usually distinguished between convolutional codes and block codes:

- Convolutional codes are processed on a bit-by-bit basis. They are particularly suitable for implementation in hardware, and the Viterbi decoder allows optimal decoding.

- Block codes are processed on a block-by-block basis. Early examples of block codes are repetition codes, Hamming codes and multidimensional parity-check codes. They were followed by a number of efficient codes, Reed–Solomon codes being the most notable due to their current widespread use. Turbo codes and low-density parity-check codes (LDPC) are relatively new constructions that can provide almost optimal efficiency.

Shannon’s theorem is an important theorem in forward error correction, and describes the maximum information rate at which reliable communication is possible over a channel that has a certain error probability or signal-to-noise ratio (SNR). This strict upper limit is expressed in terms of the channel capacity. More specifically, the theorem says that there exist codes such that with increasing encoding length the probability of error on a discrete memoryless channel can be made arbitrarily small, provided that the code rate is smaller than the channel capacity. The code rate is defined as the fraction k/n of k source symbols and n encoded symbols.

The actual maximum code rate allowed depends on the error-correcting code used, and may be lower. This is because Shannon’s proof was only of existential nature, and did not show how to construct codes which are both optimal and have efficient encoding and decoding algorithms.

Hybrid schemes[edit]

Hybrid ARQ is a combination of ARQ and forward error correction. There are two basic approaches:[10]

- Messages are always transmitted with FEC parity data (and error-detection redundancy). A receiver decodes a message using the parity information, and requests retransmission using ARQ only if the parity data was not sufficient for successful decoding (identified through a failed integrity check).

- Messages are transmitted without parity data (only with error-detection information). If a receiver detects an error, it requests FEC information from the transmitter using ARQ, and uses it to reconstruct the original message.

The latter approach is particularly attractive on an erasure channel when using a rateless erasure code.

Error detection schemes[edit]

Error detection is most commonly realized using a suitable hash function (or specifically, a checksum, cyclic redundancy check or other algorithm). A hash function adds a fixed-length tag to a message, which enables receivers to verify the delivered message by recomputing the tag and comparing it with the one provided.

There exists a vast variety of different hash function designs. However, some are of particularly widespread use because of either their simplicity or their suitability for detecting certain kinds of errors (e.g., the cyclic redundancy check’s performance in detecting burst errors).

Minimum distance coding[edit]

A random-error-correcting code based on minimum distance coding can provide a strict guarantee on the number of detectable errors, but it may not protect against a preimage attack.

Repetition codes[edit]

A repetition code is a coding scheme that repeats the bits across a channel to achieve error-free communication. Given a stream of data to be transmitted, the data are divided into blocks of bits. Each block is transmitted some predetermined number of times. For example, to send the bit pattern «1011», the four-bit block can be repeated three times, thus producing «1011 1011 1011». If this twelve-bit pattern was received as «1010 1011 1011» – where the first block is unlike the other two – an error has occurred.

A repetition code is very inefficient, and can be susceptible to problems if the error occurs in exactly the same place for each group (e.g., «1010 1010 1010» in the previous example would be detected as correct). The advantage of repetition codes is that they are extremely simple, and are in fact used in some transmissions of numbers stations.[14][15]

Parity bit[edit]

A parity bit is a bit that is added to a group of source bits to ensure that the number of set bits (i.e., bits with value 1) in the outcome is even or odd. It is a very simple scheme that can be used to detect single or any other odd number (i.e., three, five, etc.) of errors in the output. An even number of flipped bits will make the parity bit appear correct even though the data is erroneous.

Parity bits added to each «word» sent are called transverse redundancy checks, while those added at the end of a stream of «words» are called longitudinal redundancy checks. For example, if each of a series of m-bit «words» has a parity bit added, showing whether there were an odd or even number of ones in that word, any word with a single error in it will be detected. It will not be known where in the word the error is, however. If, in addition, after each stream of n words a parity sum is sent, each bit of which shows whether there were an odd or even number of ones at that bit-position sent in the most recent group, the exact position of the error can be determined and the error corrected. This method is only guaranteed to be effective, however, if there are no more than 1 error in every group of n words. With more error correction bits, more errors can be detected and in some cases corrected.

There are also other bit-grouping techniques.

Checksum[edit]

A checksum of a message is a modular arithmetic sum of message code words of a fixed word length (e.g., byte values). The sum may be negated by means of a ones’-complement operation prior to transmission to detect unintentional all-zero messages.

Checksum schemes include parity bits, check digits, and longitudinal redundancy checks. Some checksum schemes, such as the Damm algorithm, the Luhn algorithm, and the Verhoeff algorithm, are specifically designed to detect errors commonly introduced by humans in writing down or remembering identification numbers.

Cyclic redundancy check[edit]

A cyclic redundancy check (CRC) is a non-secure hash function designed to detect accidental changes to digital data in computer networks. It is not suitable for detecting maliciously introduced errors. It is characterized by specification of a generator polynomial, which is used as the divisor in a polynomial long division over a finite field, taking the input data as the dividend. The remainder becomes the result.

A CRC has properties that make it well suited for detecting burst errors. CRCs are particularly easy to implement in hardware and are therefore commonly used in computer networks and storage devices such as hard disk drives.

The parity bit can be seen as a special-case 1-bit CRC.

Cryptographic hash function[edit]

The output of a cryptographic hash function, also known as a message digest, can provide strong assurances about data integrity, whether changes of the data are accidental (e.g., due to transmission errors) or maliciously introduced. Any modification to the data will likely be detected through a mismatching hash value. Furthermore, given some hash value, it is typically infeasible to find some input data (other than the one given) that will yield the same hash value. If an attacker can change not only the message but also the hash value, then a keyed hash or message authentication code (MAC) can be used for additional security. Without knowing the key, it is not possible for the attacker to easily or conveniently calculate the correct keyed hash value for a modified message.

Error correction code[edit]

Any error-correcting code can be used for error detection. A code with minimum Hamming distance, d, can detect up to d − 1 errors in a code word. Using minimum-distance-based error-correcting codes for error detection can be suitable if a strict limit on the minimum number of errors to be detected is desired.

Codes with minimum Hamming distance d = 2 are degenerate cases of error-correcting codes, and can be used to detect single errors. The parity bit is an example of a single-error-detecting code.

Applications[edit]

Applications that require low latency (such as telephone conversations) cannot use automatic repeat request (ARQ); they must use forward error correction (FEC). By the time an ARQ system discovers an error and re-transmits it, the re-sent data will arrive too late to be usable.

Applications where the transmitter immediately forgets the information as soon as it is sent (such as most television cameras) cannot use ARQ; they must use FEC because when an error occurs, the original data is no longer available.

Applications that use ARQ must have a return channel; applications having no return channel cannot use ARQ.

Applications that require extremely low error rates (such as digital money transfers) must use ARQ due to the possibility of uncorrectable errors with FEC.

Reliability and inspection engineering also make use of the theory of error-correcting codes.[16]

Internet[edit]

In a typical TCP/IP stack, error control is performed at multiple levels:

- Each Ethernet frame uses CRC-32 error detection. Frames with detected errors are discarded by the receiver hardware.

- The IPv4 header contains a checksum protecting the contents of the header. Packets with incorrect checksums are dropped within the network or at the receiver.

- The checksum was omitted from the IPv6 header in order to minimize processing costs in network routing and because current link layer technology is assumed to provide sufficient error detection (see also RFC 3819).

- UDP has an optional checksum covering the payload and addressing information in the UDP and IP headers. Packets with incorrect checksums are discarded by the network stack. The checksum is optional under IPv4, and required under IPv6. When omitted, it is assumed the data-link layer provides the desired level of error protection.

- TCP provides a checksum for protecting the payload and addressing information in the TCP and IP headers. Packets with incorrect checksums are discarded by the network stack, and eventually get retransmitted using ARQ, either explicitly (such as through three-way handshake) or implicitly due to a timeout.

Deep-space telecommunications[edit]

The development of error-correction codes was tightly coupled with the history of deep-space missions due to the extreme dilution of signal power over interplanetary distances, and the limited power availability aboard space probes. Whereas early missions sent their data uncoded, starting in 1968, digital error correction was implemented in the form of (sub-optimally decoded) convolutional codes and Reed–Muller codes.[17] The Reed–Muller code was well suited to the noise the spacecraft was subject to (approximately matching a bell curve), and was implemented for the Mariner spacecraft and used on missions between 1969 and 1977.

The Voyager 1 and Voyager 2 missions, which started in 1977, were designed to deliver color imaging and scientific information from Jupiter and Saturn.[18] This resulted in increased coding requirements, and thus, the spacecraft were supported by (optimally Viterbi-decoded) convolutional codes that could be concatenated with an outer Golay (24,12,8) code. The Voyager 2 craft additionally supported an implementation of a Reed–Solomon code. The concatenated Reed–Solomon–Viterbi (RSV) code allowed for very powerful error correction, and enabled the spacecraft’s extended journey to Uranus and Neptune. After ECC system upgrades in 1989, both crafts used V2 RSV coding.

The Consultative Committee for Space Data Systems currently recommends usage of error correction codes with performance similar to the Voyager 2 RSV code as a minimum. Concatenated codes are increasingly falling out of favor with space missions, and are replaced by more powerful codes such as Turbo codes or LDPC codes.

The different kinds of deep space and orbital missions that are conducted suggest that trying to find a one-size-fits-all error correction system will be an ongoing problem. For missions close to Earth, the nature of the noise in the communication channel is different from that which a spacecraft on an interplanetary mission experiences. Additionally, as a spacecraft increases its distance from Earth, the problem of correcting for noise becomes more difficult.

Satellite broadcasting[edit]

The demand for satellite transponder bandwidth continues to grow, fueled by the desire to deliver television (including new channels and high-definition television) and IP data. Transponder availability and bandwidth constraints have limited this growth. Transponder capacity is determined by the selected modulation scheme and the proportion of capacity consumed by FEC.

Data storage[edit]

Error detection and correction codes are often used to improve the reliability of data storage media.[19] A parity track capable of detecting single-bit errors was present on the first magnetic tape data storage in 1951. The optimal rectangular code used in group coded recording tapes not only detects but also corrects single-bit errors. Some file formats, particularly archive formats, include a checksum (most often CRC32) to detect corruption and truncation and can employ redundancy or parity files to recover portions of corrupted data. Reed-Solomon codes are used in compact discs to correct errors caused by scratches.

Modern hard drives use Reed–Solomon codes to detect and correct minor errors in sector reads, and to recover corrupted data from failing sectors and store that data in the spare sectors.[20] RAID systems use a variety of error correction techniques to recover data when a hard drive completely fails. Filesystems such as ZFS or Btrfs, as well as some RAID implementations, support data scrubbing and resilvering, which allows bad blocks to be detected and (hopefully) recovered before they are used.[21] The recovered data may be re-written to exactly the same physical location, to spare blocks elsewhere on the same piece of hardware, or the data may be rewritten onto replacement hardware.

Error-correcting memory[edit]

Dynamic random-access memory (DRAM) may provide stronger protection against soft errors by relying on error-correcting codes. Such error-correcting memory, known as ECC or EDAC-protected memory, is particularly desirable for mission-critical applications, such as scientific computing, financial, medical, etc. as well as extraterrestrial applications due to the increased radiation in space.

Error-correcting memory controllers traditionally use Hamming codes, although some use triple modular redundancy. Interleaving allows distributing the effect of a single cosmic ray potentially upsetting multiple physically neighboring bits across multiple words by associating neighboring bits to different words. As long as a single-event upset (SEU) does not exceed the error threshold (e.g., a single error) in any particular word between accesses, it can be corrected (e.g., by a single-bit error-correcting code), and the illusion of an error-free memory system may be maintained.[22]

In addition to hardware providing features required for ECC memory to operate, operating systems usually contain related reporting facilities that are used to provide notifications when soft errors are transparently recovered. One example is the Linux kernel’s EDAC subsystem (previously known as Bluesmoke), which collects the data from error-checking-enabled components inside a computer system; besides collecting and reporting back the events related to ECC memory, it also supports other checksumming errors, including those detected on the PCI bus.[23][24][25] A few systems[specify] also support memory scrubbing to catch and correct errors early before they become unrecoverable.

See also[edit]

- Berger code

- Burst error-correcting code

- ECC memory, a type of computer data storage

- Link adaptation

- List of algorithms § Error detection and correction

- List of hash functions

References[edit]

- ^ a b «Masorah». Jewish Encyclopedia.

- ^ Pratico, Gary D.; Pelt, Miles V. Van (2009). Basics of Biblical Hebrew Grammar: Second Edition. Zondervan. ISBN 978-0-310-55882-8.

- ^ Mounce, William D. (2007). Greek for the Rest of Us: Using Greek Tools Without Mastering Biblical Languages. Zondervan. p. 289. ISBN 978-0-310-28289-1.

- ^ Mishneh Torah, Tefillin, Mezuzah, and Sefer Torah, 1:2. Example English translation: Eliyahu Touger. The Rambam’s Mishneh Torah. Moznaim Publishing Corporation.

- ^ Brian M. Fagan (5 December 1996). «Dead Sea Scrolls». The Oxford Companion to Archaeology. Oxford University Press. ISBN 0195076184.

- ^ Thompson, Thomas M. (1983), From Error-Correcting Codes through Sphere Packings to Simple Groups, The Carus Mathematical Monographs (#21), The Mathematical Association of America, p. vii, ISBN 0-88385-023-0

- ^ Shannon, C.E. (1948), «A Mathematical Theory of Communication», Bell System Technical Journal, 27 (3): 379–423, doi:10.1002/j.1538-7305.1948.tb01338.x, hdl:10338.dmlcz/101429, PMID 9230594

- ^ Golay, Marcel J. E. (1949), «Notes on Digital Coding», Proc.I.R.E. (I.E.E.E.), 37: 657

- ^ Gupta, Vikas; Verma, Chanderkant (November 2012). «Error Detection and Correction: An Introduction». International Journal of Advanced Research in Computer Science and Software Engineering. 2 (11). S2CID 17499858.

- ^ a b A. J. McAuley, Reliable Broadband Communication Using a Burst Erasure Correcting Code, ACM SIGCOMM, 1990.