Ошибки, встроенные в систему: их роль в статистике

Время на прочтение

6 мин

Количество просмотров 13K

В прошлой статье я указал, как распространена проблема неправильного использования t-критерия в научных публикациях (и это возможно сделать только благодаря их открытости, а какой трэш творится при его использовании во всяких курсовых, отчетах, обучающих задачах и т.д. — неизвестно). Чтобы обсудить это, я рассказал об основах дисперсионного анализа и задаваемом самим исследователем уровне значимости α. Но для полного понимания всей картины статистического анализа необходимо подчеркнуть ряд важных вещей. И самая основная из них — понятие ошибки.

Ошибка и некорректное применение: в чем разница?

В любой физической системе содержится какая-либо ошибка, неточность. В самой разнообразной форме: так называемый допуск — отличие в размерах разных однотипных изделий; нелинейная характеристика — когда прибор или метод измеряют что-то по строго известному закону в определенных пределах, а дальше становятся неприменимыми; дискретность — когда мы чисто технически не можем обеспечить плавность выходной характеристики.

И в то же время существует чисто человеческая ошибка — некорректное использование устройств, приборов, математических законов. Между ошибкой, присущей системе, и ошибкой применения этой системы есть принципиальная разница. Важно различать и не путать между собой эти два понятия, называемые одним и тем же словом «ошибка». Я в данной статье предпочитаю использовать слово «ошибка» для обозначения свойства системы, а «некорректное применение» — для ошибочного ее использования.

То есть, ошибка линейки равна допуску оборудования, наносящего штрихи на ее полотно. А ошибкой в смысле некорректного применения было бы использовать ее при измерении деталей наручных часов. Ошибка безмена написана на нем и составляет что-то около 50 граммов, а неправильным использованием безмена было бы взвешивание на нем мешка в 25 кг, который растягивает пружину из области закона Гука в область пластических деформаций. Ошибка атомно-силового микроскопа происходит из его дискретности — нельзя «пощупать» его зондом предметы мельче, чем диаметром в один атом. Но способов неправильно использовать его или неправильно интерпретировать данные существует множество. И так далее.

Так, а что же за ошибка имеет место в статистических методах? А этой ошибкой как раз и является пресловутый уровень значимости α.

Ошибки первого и второго рода

Ошибкой в математическом аппарате статистики является сама ее Байесовская вероятностная сущность. В прошлой статье я уже упоминал, на чем стоят статистические методы: определение уровня значимости α как наибольшей допустимой вероятности неправомерно отвергнуть нулевую гипотезу, и самостоятельное задание исследователем этой величины перед исследователем.

Вы уже видите эту условность? На самом деле, в критериальных методах нету привычной математической строгости. Математика здесь оперирует вероятностными характеристиками.

И тут наступает еще один момент, где возможна неправильная трактовка одного слова в разном контексте. Необходимо различать само понятие вероятности и фактическую реализацию события, выражающуюся в распределении вероятности. Например, перед началом любого нашего эксперимента мы не знаем, какую именно величину мы получим в результате. Есть два возможных исхода: загадав некоторое значение результата, мы либо действительно его получим, либо не получим. Логично, что вероятность и того, и другого события равна 1/2. Но показанная в предыдущей статье Гауссова кривая показывает распределение вероятности того, что мы правильно угадаем совпадение.

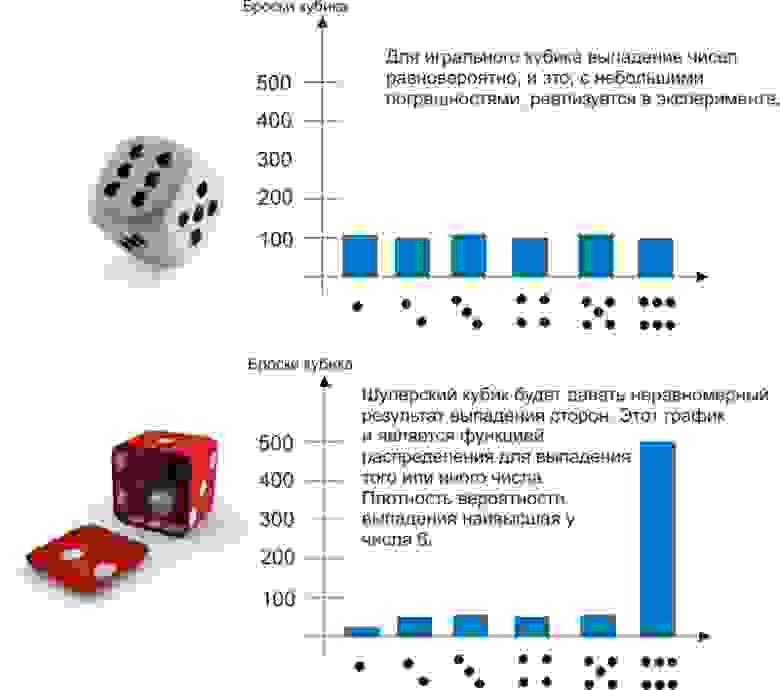

Наглядно можно проиллюстрировать это примером. Пусть мы 600 раз бросаем два игральных кубика — обычный и шулерский. Получим следующие результаты:

До эксперимента для обоих кубиков выпадение любой грани будет равновероятно — 1/6. Однако после эксперимента проявляется сущность шулерского кубика, и мы можем сказать, что плотность вероятности выпадения на нем шестерки — 90%.

Другой пример, который знают химики, физики и все, кто интересуется квантовыми эффектами — атомные орбитали. Теоретически электрон может быть «размазан» в пространстве и находиться практически где угодно. Но на практике есть области, где он будет находиться в 90 и более процентах случаев. Эти области пространства, образованные поверхностью с плотностью вероятности нахождения там электрона 90%, и есть классические атомные орбитали, в виде сфер, гантелей и т.д.

Так вот, самостоятельно задавая уровень значимости, мы заведомо соглашаемся на описанную в его названии ошибку. Из-за этого ни один результат нельзя считать «стопроцентно достоверным» — всегда наши статистические выводы будут содержать некоторую вероятность сбоя.

Ошибка, формулируемая определением уровня значимости α, называется ошибкой первого рода. Ее можно определить, как «ложная тревога», или, более корректно, ложноположительный результат. В самом деле, что означают слова «ошибочно отвергнуть нулевую гипотезу»? Это значит, по ошибке принять наблюдаемые данные за значимые различия двух групп. Поставить ложный диагноз о наличии болезни, поспешить явить миру новое открытие, которого на самом деле нет — вот примеры ошибок первого рода.

Но ведь тогда должны быть и ложноотрицательные результаты? Совершенно верно, и они называются ошибками второго рода. Примеры — не поставленный вовремя диагноз или же разочарование в результате исследования, хотя на самом деле в нем есть важные данные. Ошибки второго рода обозначаются буквой, как ни странно, β. Но само это понятие не так важно для статистики, как число 1-β. Число 1-β называется мощностью критерия, и как нетрудно догадаться, оно характеризует способность критерия не упустить значимое событие.

Однако содержание в статистических методах ошибок первого и второго рода не является только лишь их ограничением. Само понятие этих ошибок может использоваться непосредственным образом в статистическом анализе. Как?

ROC-анализ

ROC-анализ (от receiver operating characteristic, рабочая характеристика приёмника) — это метод количественного определения применимости некоторого признака к бинарной классификации объектов. Говоря проще, мы можем придумать некоторый способ, как отличить больных людей от здоровых, кошек от собак, черное от белого, а затем проверить правомерность такого способа. Давайте снова обратимся к примеру.

Пусть вы — подающий надежды криминалист, и разрабатываете новый способ скрытно и однозначно определять, является ли человек преступником. Вы придумали количественный признак: оценивать преступные наклонности людей по частоте прослушивания ими Михаила Круга. Но будет ли давать адекватные результаты ваш признак? Давайте разбираться.

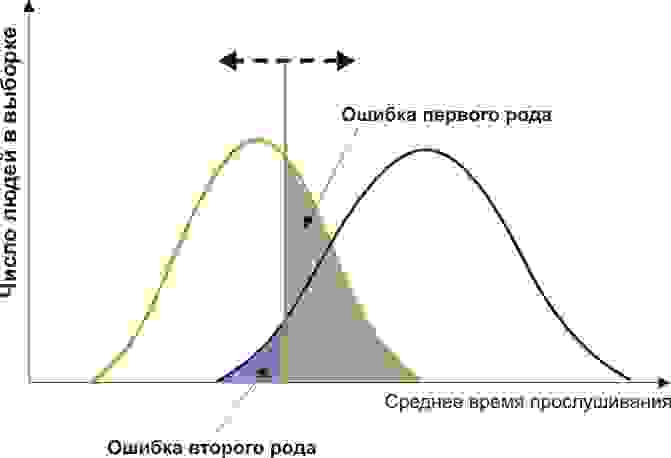

Вам понадобится две группы людей для валидации вашего критерия: обычные граждане и преступники. Положим, действительно, среднегодовое время прослушивания ими Михаила Круга различается (см. рисунок):

Здесь мы видим, что по количественному признаку времени прослушивания наши выборки пересекаются. Кто-то слушает Круга спонтанно по радио, не совершая преступлений, а кто-то нарушает закон, слушая другую музыку или даже будучи глухим. Какие у нас есть граничные условия? ROC-анализ вводит понятия селективности (чувствительности) и специфичности. Чувствительность определяется как способность выявлять все-все интересующие нас точки (в данном примере — преступников), а специфичность — не захватывать ничего ложноположительного (не ставить под подозрение простых обывателей). Мы можем задать некоторую критическую количественную черту, отделяющую одних от других (оранжевая), в пределах от максимальной чувствительности (зеленая) до максимальной специфичности (красная).

Посмотрим на следующую схему:

Смещая значение нашего признака, мы меняем соотношения ложноположительного и ложноотрицательного результатов (площади под кривыми). Точно так же мы можем дать определения Чувствительность = Полож. рез-т/(Полож. рез-т + ложноотриц. рез-т) и Специфичность = Отриц. рез-т/(Отриц. рез-т + ложноположит. рез-т).

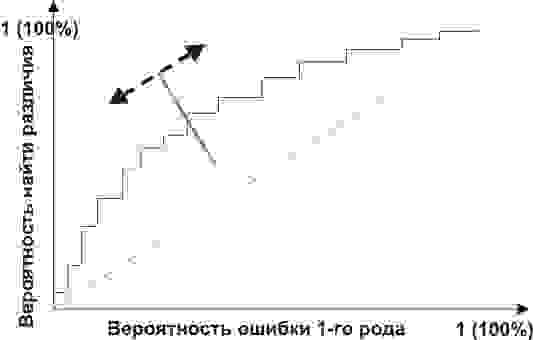

Но главное, мы можем оценить соотношение положительных результатов к ложноположительным на всем отрезке значений нашего количественного признака, что и есть наша искомая ROC-кривая (см. рисунок):

А как нам понять из этого графика, насколько хорош наш признак? Очень просто, посчитать площадь под кривой (AUC, area under curve). Пунктирная линия (0,0; 1,1) означает полное совпадение двух выборок и совершенно бессмысленный критерий (площадь под кривой равна 0,5 от всего квадрата). А вот выпуклость ROC кривой как раз и говорит о совершенстве критерия. Если же нам удастся найти такой критерий, что выборки вообще не будут пересекаться, то площадь под кривой займет весь график. В целом же признак считается хорошим, позволяющим надежно отделить одну выборку от другой, если AUC > 0,75-0,8.

С помощью такого анализа вы можете решать самые разные задачи. Решив, что слишком много домохозяек оказались под подозрением из-за Михаила Круга, а кроме того упущены опасные рецидивисты, слушающие Ноггано, вы можете отвергнуть этот критерий и разработать другой.

Возникнув, как способ обработки радиосигналов и идентификации «свой-чужой» после атаки на Перл-Харбор (отсюда и пошло такое странное название про характеристику приемника), ROC-анализ нашел широкое применение в биомедицинской статистике для анализа, валидации, создания и характеристики панелей биомаркеров и т.д. Он гибок в использовании, если оно основано на грамотной логике. Например, вы можете разработать показания для медицинской диспансеризации пенсионеров-сердечников, применив высокоспецифичный критерий, повысив эффективность выявления болезней сердца и не перегружая врачей лишними пациентами. А во время опасной эпидемии ранее неизвестного вируса вы наоборот, можете придумать высокоселективный критерий, чтобы от вакцинации в прямом смысле не ускользнул ни один чих.

С ошибками обоих родов и их наглядностью в описании валидируемых критериев мы познакомились. Теперь же, двигаясь от этих логических основ, можно разрушить ряд ложных стереотипных описаний результатов. Некоторые неправильные формулировки захватывают наши умы, часто путаясь своими схожими словами и понятиями, а также из-за очень малого внимания, уделяемого неверной интерпретации. Об этом, пожалуй, нужно будет написать отдельно.

5.3. Ошибки первого и второго рода

Ошибка первого рода состоит в том, что гипотеза будет отвергнута, хотя на самом деле она правильная. Вероятность

допустить такую ошибку называют уровнем значимости и обозначают буквой («альфа»).

Ошибка второго рода состоит в том, что гипотеза будет принята, но на самом деле она неправильная. Вероятность

совершить эту ошибку обозначают буквой («бета»). Значение

называют мощностью критерия – это вероятность отвержения неправильной

гипотезы.

В практических задачах, как правило, задают уровень значимости, наиболее часто выбирают значения .

И тут возникает мысль, что чем меньше «альфа», тем вроде бы лучше. Но это только вроде: при уменьшении

вероятности —

отвергнуть правильную гипотезу растёт вероятность — принять неверную гипотезу (при прочих равных условиях).

Поэтому перед исследователем стоит задача грамотно подобрать соотношение вероятностей и

, при этом учитывается тяжесть последствий, которые

повлекут за собой та и другая ошибки.

Понятие ошибок 1-го и 2-го рода используется не только в статистике, и для лучшего понимания я приведу пару

нестатистических примеров.

Петя зарегистрировался в почтовике. По умолчанию, – он считается добропорядочным пользователем. Так считает антиспам

фильтр. И вот Петя отправляет письмо. В большинстве случаев всё произойдёт, как должно произойти – нормальное письмо дойдёт до

адресата (правильное принятие нулевой гипотезы), а спамное – попадёт в спам (правильное отвержение). Однако фильтр может

совершить ошибку двух типов:

1) с вероятностью ошибочно отклонить нулевую гипотезу (счесть нормальное письмо

за спам и Петю за спаммера) или

2) с вероятностью ошибочно принять нулевую гипотезу (хотя Петя редиска).

Какая ошибка более «тяжелая»? Петино письмо может быть ОЧЕНЬ важным для адресата, и поэтому при настройке фильтра

целесообразно уменьшить уровень значимости , «пожертвовав» вероятностью

(увеличив её). В результате в основной ящик будут попадать все

«подозрительные» письма, в том числе особо талантливых спаммеров. …Такое и почитать даже можно, ведь сделано с любовью

Существует примеры, где наоборот – более тяжкие последствия влечёт ошибка 2-го рода, и вероятность следует увеличить (в пользу уменьшения

вероятности ). Не хотел я

приводить подобные примеры, и даже отшутился на сайте, но по какой-то мистике через пару месяцев сам столкнулся с непростой

дилеммой. Видимо, таки, надо рассказать:

У человека появилась серьёзная болячка. В медицинской практике её принято лечить (основное «нулевое» решение). Лечение

достаточно эффективно, однако не гарантирует результата и более того опасно (иногда приводит к серьёзному пожизненному

увечью). С другой стороны, если не лечить, то возможны осложнения и долговременные функциональные нарушения.

Вопрос: что делать? И ответ не так-то прост – в разных ситуациях разные люди могут принять разные

решения (упаси вас).

Если болезнь не особо «мешает жить», то более тяжёлые последствия повлечёт ошибка 2-го рода – когда человек соглашается

на лечение, но получает фатальный результат (принимает, как оказалось, неверное «нулевое» решение). Если же…, нет, пожалуй,

достаточно, возвращаемся к теме:

| Оглавление |

Определим выражение для вычисления ошибки второго рода и мощности теста, построим в

MS

EXCEL

кривые оперативной характеристики (Operating-characteristic curves).

Тема этой статьи – вычисление

ошибки второго рода

(type II error) при

проверке гипотез

. Основная статья про

проверку гипотез

находится здесь

.

Напомним, что процедура

проверки гипотез

состоит из следующих шагов:

-

из исследуемого распределения берется

выборка

; -

на основании значений

выборки

вычисляется

тестовая статистика

; -

значение

тестовой статистики

сравнивается со значениями, соответствующим заданномууровню значимости (ошибке первого рода)

;

-

по результату сравнения делается вывод об отклонении (или не отклонении)

нулевой гипотезы

.

Обычно с

проверкой гипотез

связывают 2 типа ошибок. Если

нулевая гипотеза

отклоняется, когда она верна – это

ошибка первого рода

(обозначается α,

альфа

). Если нулевая гипотеза не отклоняется, когда она неверна, то это

ошибка второго рода

(обозначается β,

бета

).

Ошибка первого рода

часто называется риском производителя. Это осознанный риск, на который идет производитель продукции, т.к. он определяет вероятность того, что годная продукция может быть забракована, хотя на самом деле она таковой не является. Величина

ошибки первого рода

задается перед

проверкой гипотезы

, таким образом, она контролируется исследователем напрямую и может быть задана в соответствии с условиями решаемой задачи. После этого, процедура проверки гипотезы составляется таким образом, чтобы вероятность

ошибки второго рода

была как можно меньше.

Ошибка второго рода

β

зависит от размера

выборки

n и

уровня значимости α

, и поэтому контролируется косвенно. Чем больше размер

выборки

, тем меньше

ошибка второго рода

(при прочих равных).

Часто также используют величину

1-β

, которая называется

мощностью статистического критерия

(мощностью теста, мощностью исследования, англ. power of a statistical test).

Мощность статистического критерия

— это вероятность правильно отклонить нулевую гипотезу. Чем ближе эта величина к единице, тем меньше у нас шансов ошибиться при проверке гипотезы (тем лучше критерий различает гипотезы Н

0

и Н

1

).

Ошибку второго рода

вычисляют для каждого вида

проверки гипотез

по-разному. Получим выражение для вычисления

ошибки второго рода

для

проверки двусторонней гипотезы о равенстве среднего значения распределения некоторой величине (стандартное отклонение известно)

.

Для

проверки гипотезы

этого типа используется

тестовая статистика

Z

0

:

которая имеет

стандартное нормальное распределение

.

Чтобы найти

Ошибку второго рода

необходимо предположить, что гипотеза Н

0

: μ=μ

0

не верна, и соответственно истинное

среднее значение распределения

μ=μ

0

+Δ, где Δ>0. В этом случае,

тестовая статистика

Z

0

будет иметь

нормальное распределение

N(Δ√n/σ;1), т.е. будет смещено вправо на Δ√n/σ (см.

файл примера на листе Бета

).

Согласно определения,

ошибка второго рода

равна вероятности, принять нулевую гипотезу, если на самом деле справедлива Н

1

. Эта вероятность соответствует выделенной на рисунке области.

Статистика

Z

0

, в этом случае, примет значение между -Z

α/2

и Z

α/2

(эти значения соответствуют границам

доверительного интервала

). Z

α/2

– это

верхний α/2-квантиль стандартного нормального распределения

.

Определим

ошибку второго рода

в терминах

стандартного нормального распределения

:

Это выражение будет работать и для Δ<0. Как видно из выражения,

ошибка второго рода

является функцией от α, Δ и n. В

файле примера на листе Бета

можно быстро рассчитать β и

мощность теста

в зависимости от этих параметров. Диаграмма, приведенная выше, будет автоматически перестроена.

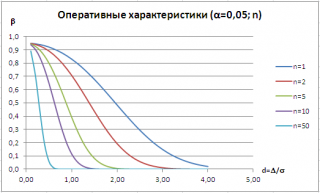

Для заданного значения α часто строят семейство кривых, которые иллюстрируют зависимость

ошибки второго рода

от Δ и n. Такие кривые называются

операционными характеристиками

(Operating-characteristic curves).

Как видно из рисунка, чем дальше истинное значение

среднего

от μ

0

, т.е. чем больше Δ, тем меньше

ошибка второго рода.

Таким образом, для заданных α и n, тест легче определит большие отклонения от

среднего

, чем малые (тест обладает, в данном случае, большей

мощностью

). При росте n

мощность теста

также растет.

Кривые

операционных характеристик

используются для оценки размера

выборки

, достаточного для определения заданной разницы между истинным значением

среднего

μ

от μ

0

с требуемой вероятностью.

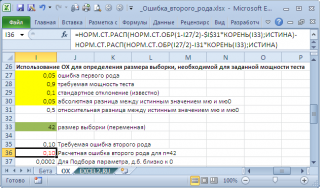

В

файле примера на листе ОХ

создана форма для определения размера

выборки

, достаточного для обеспечения заданной

мощности теста

.

Например, Н

0

: μ

0

=20, истинное значение μ=20,05,

стандартное отклонение

=0,1, α=0,05. Чтобы вероятность правильно отклонить гипотезу H

0

была равна 0,9 (

мощность теста

), размер

выборки

должен быть 42 или более.

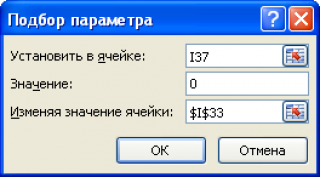

Примечание

:

Для нахождения размера

выборки

потребуется использование инструмента MS EXCEL

Подбор параметра

.

20 октября 2021 г.

Многие отрасли нанимают исследователей для проведения исследований, которые приносят пользу компаниям и людям, например клиентам, клиентам или пациентам. Эти исследователи часто используют статистику, чтобы определить, верны или ложны гипотезы, чтобы они могли внести изменения в существующие отрасли или улучшить стандартные методы компании. Как исследователь, вы можете захотеть узнать о потенциальных ошибках, которые могут возникнуть при проверке гипотез с помощью статистических исследований. В этой статье мы определяем ошибку типа II в статистике и ее сравнение с ошибками типа I, а также значение ошибок типа II и советы по их уменьшению при рассмотрении гипотез.

Что такое ошибка второго рода в статистике?

Ошибка типа II в статистике возникает, когда исследователь принимает нулевую гипотезу, которая является ложной. В статистике нулевая гипотеза относится к гипотезе, которая является отправной точкой для исследователей, чтобы проверить и попытаться опровергнуть ее, используя статистически значимые данные. Нулевая гипотеза может быть истинной или ложной в зависимости от статистической значимости ваших данных, что просто означает, полезны ли данные в качестве измерения для опровержения гипотезы. Однако исследователи обычно рассматривают нулевую гипотезу как истинную, пока данные не опровергают ее.

Когда исследователь полагает, что его данные доказывают, что нулевая гипотеза верна, хотя на самом деле она ложна, возникает ошибка типа II. Это распространенная ошибка в статистике, которую исследователи иногда называют ложным отрицанием, потому что гипотеза ложна, но вы не отвергаете ее и не опровергаете.

Ошибки типа II и ошибки типа I

В дополнение к ошибкам типа I существуют также ошибки типа II, которые могут повлиять на исследовательские решения в статистике. Ошибки типа I противоположны и обратно пропорциональны ошибкам типа II, что означает, что если вы исправите ошибку одного типа слишком далеко, вы можете получить ошибку другого типа. Вы можете лучше понять это, изучив следующую таблицу:

Нулевая гипотеза верна**Нулевая гипотеза ложна**Принять/не отклонить нулевую гипотезуПравильное решение (принять истинную гипотезу)Ошибка второго рода (принять ложную гипотезу)Отклонить нулевую гипотезуОшибка первого рода (отклонить верную гипотезу)Правильное решение (отклонить ложную гипотезу) ) Каждая из этих ошибок может нарушить исследование и создать ситуации, когда исследователи упускают из виду важную информацию. Самая большая разница между ошибками типа I и типа II заключается в том, как они создаются. Например, ошибка типа I часто возникает, если вы принимаете случайные или случайные данные как статистически значимые. Часто это означает, что установленный вами уровень значимости, который обычно составляет около 0,05 или 5%, слишком высок. Однако для ошибок типа II ошибка возникает, если вы упускаете важные данные из-за небольшого размера выборки, низкого уровня значимости или ошибки измерения.

Значение ошибок типа II

Ошибки типа II могут существенно повлиять на результаты вашего исследования, потому что они означают, что нулевая гипотеза ложна, но вы верите, что она верна. Когда случаются ошибки такого типа, вы можете упустить возможность создавать инновационные продукты, улучшать свою компанию и приносить пользу людям различными способами. Если вы считаете, что столкнулись с ошибкой типа II в своем исследовании, рассмотрите возможность еще раз просмотреть данные и нулевую гипотезу, чтобы убедиться, что вы включили все важные статистические данные в свое решение принять гипотезу. Примите во внимание следующие причины, по которым вы заметите, что ошибки Типа II могут существенно повлиять на вашу компанию:

-

Производство полезных лекарств, которые сначала казались непригодными

-

Создание эффективных маркетинговых кампаний, которые сначала казались неэффективными

-

Удаление неблагоприятной рекламы, которая сначала показалась благоприятной

-

Предоставление полезных медицинских услуг, которые сначала казались бесполезными

-

Изменение неудачных методов управления, которые сначала казались успешными

Советы по уменьшению ошибок типа II

Вот несколько советов, которые помогут вам уменьшить количество ошибок типа II в вашем исследовании:

-

Тщательно планируйте свое обучение. Тщательное планирование может помочь вам избежать ошибок типа II, обеспечив наличие всех данных для принятия взвешенного решения относительно нулевой гипотезы. Подготовьте свои данные и поймите все переменные в вашей статистике, чтобы убедиться, что внешние факторы не влияют на данные, и вы не упустили ни одной важной информации.

-

Увеличьте размер выборки участников. Часто увеличение размера выборки может помочь вам получить лучшие результаты и избежать принятия ложных нулевых гипотез в вашем исследовании. Это связано с тем, что наличие большего количества данных от разных людей и источников может дать вам более широкий спектр информации для создания более стабильного среднего значения и устранения выбросов, которые могут повлиять на результаты исследования.

-

Запускайте тесты на более длительные периоды. Запуск тестов в течение более длительных периодов — это еще один способ увеличить размер выборки для исследования, гарантируя, что данные непротиворечивы и не связаны с внезапными всплесками или падениями активности. Имея более согласованные данные, вы можете гарантировать, что информация, на которой вы основываете свое решение, будет значимой и более точной, чем при более коротких временных рамках.

-

Поднимите уровень своей значимости. Еще один способ уменьшить количество ошибок типа II — поднять уровень значимости выше 5%, что означает, что вы можете считать большее количество данных значимыми и увеличить размер выборки. Однако слишком большое значение может привести к ошибкам типа I, поэтому рассмотрите возможность проведения нескольких тестов с разными уровнями и сравнения данных с другими исследователями, чтобы быть более точными.

Пример ошибки второго рода

Используйте следующий пример ошибки типа II, чтобы понять, что это за ошибка и как она возникает:

Пример: вы работаете с розничной компанией, которая хочет повысить удовлетворенность клиентов, внедрив функцию живого чата на своем веб-сайте. Ваша нулевая гипотеза состоит в том, что функция живого чата не повысит удовлетворенность клиентов. Чтобы проверить это, вы отправляете опрос об удовлетворенности клиентов в конце каждого живого чата и регулярно просматриваете результаты. Через месяц удовлетворенность клиентов не увеличивается, поэтому вы принимаете свою нулевую гипотезу о том, что функция живого чата не повышает удовлетворенность клиентов.

Однако розничная компания предпочитает проводить опрос в конце каждого живого чата. Вы просматриваете результаты через три месяца и видите, что уровень удовлетворенности клиентов медленно растет с тех пор, как вы в последний раз проверяли результаты. Вы понимаете, что совершили ошибку типа II и приняли ложную гипотезу, не имея достаточно информации для принятия точного решения.