d.Генеральная Ассамблея

e.Совет

Вопрос 2 Модель здравоохранения Н.А. Семашко относится к:

a.модели здравоохранения без государственного регулирования

b.рыночной модели

c.страховой модели

d.монопольной государственной модели

e.традиционной модели

Вопрос 3 Наиболее типичным представителем государственной системы здравоохранения в

настоящее время в мире выступает:

a.ЮАР;

b.США;

c.Израиль;

d.Великобритания;

e.Германия.

Вопрос 4 Штаб-квартира ВОЗ находится в:

a.Берлине

b.Париже

c.Женеве

d.Вашингтоне

e.Токио

Вопрос 5 Выберите критерий, относящийся к преимуществам государственной системы здравоохранения:

a.многообразие форм собственности медицинских учреждений

b.установление гарантий бесплатной медицинской помощи

c.свобода выбора врача и медицинских учреждений

d.высокие доходы врачей

e.разделение функций финансирования и оказания мед. услуг

Вопрос 6 Источниками страховой модели системы здравоохранения являются:

a.личные средства граждан

b.бюджетные средства

c.налоги юридических лиц

d.спонсорские взносы

e.все перечисленные

Вопрос 7 Модель здравоохранения с государственным регулированием программ ОМС для

большинства граждан (О. Фон Бисмарк) типична для:

a.США

b.России

c.Германии

d.Японии

e.Китая

Вопрос 8 Какой тип системы здравоохранения существует в РФ в настоящее время?

a.система страхования, регулируемая государством

b.бюджетно-страховая медицина

c.частнопредпринимательская система

d.государственная (бюджетная)

e. верно все

Вопрос 9 Основной источник финансирования рыночной модели системы здравоохранения:

a. личные средства граждан b. бюджетные средства

c. страховые взносы

d. благотворительные пожертвования e. налоги

Вопрос 10 К достоинствам монопольной государственной модели системы здравоохранения относится:

a. бесплатность

b. высокое качество медицинской помощи

c. высокая оплата труда медицинского персонала

d. отсутствие очередей на оказание специализированной помощи e. высокий уровень материально-технического оснащения ЛПУ

Тема No1: ОЗЗ как наука, предмет исследования и область практической деятельности. 1. Функцией здоровья населения не является:

— живой труд — воспроизводство

— развитие личности

+ финансовое благополучие общества — верно все

2. Укажите приоритеты в развитии стационара, исходя из задач структурной перестройки отрасли:

— расширение коечного фонда — специализация коечного фонда

+ развитие стационарозамещающих технологий

— объединение с поликлиникой — выделение поликлиники в самостоятельное учреждение

3. Программа сбора материала включает: + составление статистической карты — составление макетов таблиц — определение объема исследования

— расчет показателей — формулировку цели исследования

4. Показателями, характеризующими здоровье населения, являются: — смертность — заболеваемость

— инвалидность

— уровень физического развития + верно все 5. Наибольше влияние на здоровье населения оказывают: + социально-экономические факторы

—генетические факторы

—состояние окружающей среды

—уровень развития здравоохранения

—верно все

6.К функциям здоровья населения относят: — живой труд — воспроизводство

— развитие личности + верно все — верного ответа нет

7.К показателям, характеризующим здоровье населения, не относятся: — смертность — заболеваемость

+ финансовое благополучие общества — физическое развитие

— инвалидность 8. Здоровье населения зависит от:

— состояния окружающей среды — социально-экономических факторов — генетических факторов

— уровня организации медицинской помощи + верно все 9. Здоровье населения в меньшей степени зависит от: + уровня развития здравоохранения

— экологических факторов — генетических факторов

— образа жизни — верно все

10. Заболеваемость является одним из показателей: + здоровья населения

— инвалидности — смертности

— социального благополучия — финансового благосостояния

11. В определение здоровья, принятое ВОЗ, не входит:

—состояние физического благополучия

—состояние духовного благополучия

—состояние социального благополучия

—отсутствие болезни и физических недостатков + состояние финансового благополучия 12. Впервые термин «социальная гигиена» был применён

—в первой половине 17 века

—в первой половине 18 века

+ в первой половине 19 века — в первой половине 20 века

— во второй половине 20 века

13.Впервые термин «социальная гигиена» применили — Фрейд и Хамураки + Рошу и Фурко

— Склифосовский и Пирогов — Левенчук и Лесгафт — Дарвин и Гилберт

14.Наряду с названием «общественное здоровье и здравоохранение» употребляют обозначения — социальная гигиена

— социальная медицина — превентивная и социальная медицина — профилактическая медицина

+ верно все

15.Впервые в русской литературе термин «социальная гигиена» применил + В. О. Португалов — Н. А. Семашко — З. П. Соловьев — Н. А. Пирогов — Ю. П. Лисицин

16.Наука «общественное здоровье и здравоохранение» это наука

—о предупреждении распространения заболеваний

—об эффективности управления здравоохранением

+ об управлении функциями здоровья народонаселения — об инокуляции и вариоляции

— о теоретических основах медицины 17. Выберите ответ не характеризующий предмет «общественное здоровье и здравоохранение

—наука об общественном здоровье и здравоохранении

—наука о закономерностях здоровья и здравоохранении

—научная дисциплина о закономерностях здоровья и здравоохранения + наука об увеличении

средней продолжительности жизни

—наука об управлении функциями здоровья населения 18. К функциям здоровья населения относится:

—уровень образования

—жилищные условия

+ живой труд

—душевное благополучие

—физическое благополучие

19. К функциям здоровья населения относится

—уровень образования

—жилищные условия

+ развитие личности

—душевное благополучие

—физическое благополучие

20. К функциям здоровья населения относится

—уровень образования

—жилищные условия

+ развитие личности

—душевное благополучие

—физическое благополучие

21. Общественное здоровье и здравоохранение

—гигиеническая наука

—клиническая наука

—общественная наука

+ интегративная наука — историческая наука

22.Определение общественного здоровья и здравоохранения как науки об управлении функциями здоровья, народонаселения предложил — Ю. П. Лисицин — Н. И. Пирогов — М. Я. Мудров — Н. А. Семашко + В. П. Казначеев

23.В предыдущие годы предмет «общественное здоровье и здравоохранение» носил название — социальная гигиена

— организация здравоохранения — социальная гигиена и организация здравоохранения — социальная медицина

+ верно всё

24.Первая кафедра социальной гигиены была организована в России в

— 1912 г + 1922 г

— 1932 г — 1940 г — 1945 г

25.Концепции здоровья

—медико-биологическая — экономическая

—социальная

—холистическая

+ верно всё 26. Показатели, характеризующие здоровье населения

—смертность

—инвалидность

—заболеваемость

—физическое развитие + верно всё

27. К факторам, влияющим на здоровье человека, относится

—окружающая среда

—генетика

—образ жизни

—система здравоохранения + верно все

28. Эксперты ВОЗ считают основным показателем качества жизни общества

—жилищные условия

—уровень образования

—экономическое благополучие

+ здоровье

— уровень социального благополучия 29. К категориям измерения здоровья относятся:

—физическое измерение

—психическое измерение

—социальное измерение

—эмоциональное измерение + верно все

30. Здоровье для человека + обладает высшем ценностью для человека — имеет рыночную цену

—относится к товарным категориям

—относится к денежной категории

—является товаром, приобретаемым на рынке медицинских услуг

31. Здравоохранение в широком плане есть + воспроизводство здоровья людей

—потребление медицинских услуг

—удовлетворение потребностей пациентов — экономическое обеспечение

—нет верного ответа

Тема No2 Основы медицинской статистики. этапы статистического исследования 1. Текущим наблюдением является:

— профилактический осмотр учащихся + изучение инвалидности населения — перепись

населения — анкетирование студентов — верно все

2. Текущее наблюдение это:

— охват части единиц совокупности для характеристики целого — наблюдение, приуроченное к одному какому-либо моменту

+ наблюдение в порядке текущей регистрации

— обследование всех без исключения единиц изучаемой совокупности — верного ответа нет

3. Текущее наблюдение — это:

+ наблюдение в порядке текущей регистрации

—наблюдение за одним каким-либо объектом регистрации

—изучение части совокупности для характеристики всей совокупности — обследование, приуроченное к какому-либо моменту времени

—перепись населения

4. Сплошное наблюдение это:

—охват части единиц совокупности для характеристики целого

—наблюдение, приуроченное к одному какому-либо моменту

—наблюдение в порядке текущей регистрации

+обследование всех без исключения единиц изучаемой совокупности — верного ответа нет 5. Простая таблица отражает:

+связь подлежащего со сказуемым

—связь подлежащего с комплексом взаимосвязанных сказуемых — попарную связь подлежащего с каждым из сказуемых

—отсутствие связи между подлежащим и сказуемым

—нет верного ответа

6. Простая статистическая таблица отражает:

+ связь между подлежащим и единственным сказуемым — связь между подлежащим и каждым из группы сказуемых — связь между подлежащим и комбинацией сказуемых

—расчет относительных показателей

—расчет коэффициента корреляции

7.Программа сбора материала включает: + составление статистической карты —

составление макетов таблиц — определение объема исследования

— расчет показателей — формулировку цели исследования

8.Программа разработки статистического материала включает:

—определение единицы наблюдения — формулировка задач исследования — составление статистической карты + составление макетов таблиц

—шифровка признаков

9. Предметом изучения медицинской статистики является информация о:

—здоровье населения

—влиянии факторов окружающей среды на здоровье человека

+ кадрах, сети и деятельности учреждений и служб здравоохранения — результатах клинических и экспериментальных исследований — все вышеперечисленное

10.По времени статистическое наблюдение может быть: + текущее (постоянное)

— сплошное — выборочное

— верно все — верного ответа нет

11.Оптимальным числом взаимосвязанных признаков в статистической таблице следует считать:

— пять — два

+три—четыре — более пяти

— один 12. Наука, изучающая количественную сторону массовых явлений, называется: +

статистика — экономика

— эпидемиология — демография — деонтология

13. Механический отбор единиц наблюдения – это — отбор по жребию — отбор по конкретному признаку

+отбор каждой N-й единицы наблюдения — отбор конкретного количества признаков

— верного ответа нет 14. Комбинационная таблица отражает:

— связь между подлежащим и единственным сказуемым

— связь между подлежащим и каждым из группы сказуемых + связь между подлежащим и комбинацией сказуемых

—расчет относительных показателей

—расчет коэффициента корреляции

15. К методам формирования выборочной совокупности не относится:

—случайный метод

—механических метод

—парно-сопряженный метод — серийный метод

+ метод стандартизации

16. К абсолютным числам относится:

—возрастная структура населения — заболеваемость населения

—рождаемость

—обеспеченность койками

+ численность населения 17. К 1 этапу статистического исследования относится

—построение диаграмм

—расчет показателей

—анализ полученных результатов

+ составление программы исследования

— внедрение результатов исследования в практику 18. Из перечисленных ниже наблюдений является единовременным

—изучение смертности населения

—изучение травматизма детей

+ перепись населения

—изучение успеваемости студентов

—изучение заболеваемости населения 19. Единовременное наблюдение это:

—охват части единиц совокупности для характеристики целого + наблюдение, приуроченное к одному какому-либо моменту

—наблюдение в порядке текущей регистрации

—обследование всех без исключения единиц изучаемой совокупности — верного ответа нет 20. Единица наблюдения это: а) массив единиц, являющихся носителем изучаемого признака б) наблюдение, приуроченное к одному какому-либо моменту в) определение объема наблюдения г) мельчайший элемент совокупности, обладающий учитываемыми признаками д) сумма всех однородных элементов статической совокупности

-а -б -в +г -д 21. Групповая таблица отражает:

—связь подлежащего со сказуемым

—связь подлежащего с комплексом взаимосвязанных сказуемых + попарную связь

подлежащего с каждым из сказуемых

—отсутствие связи между подлежащим и сказуемым

—нет верного ответа

22. Групповая статистическая таблица отражает:

— связь между подлежащим и единственным сказуемым + связь между подлежащим и каждым из группы сказуемых

—связь между подлежащим и комбинацией сказуемых — расчет относительных показателей

—расчет коэффициента корреляции

23. Группировка статистического материала осуществляется

—на 1 этапе исследования

—на 2 этапе исследования

+ на 3 этапе исследования — на 4 этапе исследования

— на 5 этапе исследования

24.Генеральная совокупность — это: а) весь массив единиц, являющихся носителями изучаемых признаков б) носитель признаков, подлежащих регистрации в) репрезентативная часть генеральной совокупности г) число случаев заболевания ОРВИ на 1000 населения д) удельный вес (доля) заболеваний ОРВИ среди всех инфекционных заболеваний

+а -б -в -г -д

25.Выборочное наблюдение это:

+ охват части единиц совокупности для характеристики целого

—наблюдение, приуроченное к одному какому-либо моменту

—наблюдение в порядке текущей регистрации

—обследование всех без исключения единиц изучаемой совокупности — верно все 26. Выборочная совокупность — это: а) весь массив единиц, являющихся носителями изучаемых признаков б) носитель признаков, подлежащих регистрации в)

репрезентативная часть генеральной совокупности г) число случаев заболевания ОРВИ на 1000 населения д) удельный вес (доля) заболеваний ОРВИ среди всех инфекционных заболеваний

-а -б +в -г -д 27. Выбор единицы наблюдения зависит:

— от программы исследования — от плана исследования

+ от цели и задач исследования — верного ответа нет

— верно все 28. Выберите единовременное наблюдение:

— наблюдение в порядке текущей регистрации + медицинский осмотр

— исследование всех единиц изучаемой совокупности — изучение смертности населения за 5 лет — изучение заболеваемости населения за 10 лет

29. В абсолютных цифрах можно представить: — заболеваемость населения — травматизм

+ численность населения

— долю умерших от злокачественных новообразований — обеспеченность населения врачами 30. Анализ полученных результатов статистического исследования проводится:

— на 1 этапе исследования — на 2 этапе исследования — на 3 этапе исследования

+ на 4 этапе исследования — на 5 этапе исследования

31. 2 этап статистического исследования включает: + сбор статистического материала

—составление программы и плана исследования

—обработку статистического материала

—анализ результатов исследования

— внедрение результатов исследования в практику

32.Укажите на рисунке макет простой таблицы:

-1 +2 -3

33.Укажите на рисунке макет комбинационной таблицы: +1

-2 -3

34.Укажите на рисунке макет групповой таблицы:

-1 -2 +3

Тема No3 Методика вычисления и анализ относительных величин, построение графических изображений 1. Экстенсивным показателем является:

+ структура причин временной нетрудоспособности 2. Экстенсивный показатель характеризует: + распределение целого на части

3. Частоту явления в данной среде характеризует коэффициент: + интенсивный 4. Структуру изучаемого явления характеризует: + экстенсивный показатель 5. Показатель соотношения характеризует:

+ частоту явления в непродуцирующей его среде 6. Показатель соотношения характеризует:

+отношение двух независимых совокупностей 7. Показатель наглядности характеризует:

+изменение явления во времени

8. Показателем соотношения является + обеспеченность студентов учебной литературой

9.Относительной величиной является: + летальность

10.Коэффициент соотношения по методике вычисления близок к коэффициенту:

+ интенсивному

11. Какой из приведенных показателей можно назвать экстенсивным: + структура причин смертности 12. Какой из перечисленных ниже показателей является экстенсивным: + структура причин смерти

13. Как рассчитывается показатель обеспеченности населения стоматологической помощью: а) число занятых должностей/средняя численность населения*10000 б) число занятых должностей/число занятых должностей+число свободных мест*10000 в) число занятых должностей/число свободных мест*10000 г) верно все д) верного ответа нет

+а 14. Интенсивный показатель характеризует:

+ частоту явления в продуцирующей его среде 15. Изменение явлении во времени и в пространстве характеризует: + показатель наглядности

16. Из перечисленных показателей частоту явления в продуцирующей среде характеризует + младенческая смертность 17. Из перечисленных показателей структуру явления характеризует:

+ возрастной состав больных в стационаре 18. Заболеваемость населения, это показатель: + интенсивный

19. Для наглядного изображения структуры заболеваемости используется диаграмма: + секторная

20. Демографические показатели (рождаемость, смертность, естественный прирост и др.) выражаются, как правило, в:

+ промилле

21. Выберите экстенсивный показатель: а) весь массив единиц, являющихся носителями изучаемых признаков б) носитель признаков, подлежащих регистрации в) репрезентативная часть генеральной совокупности г) число случаев заболевания ОРВИ на 1000 населения д) удельный вес (доля) заболеваний ОРВИ среди всех инфекционных заболеваний

+Д

22.Выберите интенсивный показатель: а) весь массив единиц, являющихся носителями изучаемых признаков б) носитель признаков, подлежащих регистрации в) репрезентативная часть генеральной совокупности г) число случаев заболевания ОРВИ на 1000 населения д) удельный вес (доля) заболеваний ОРВИ среди всех инфекционных заболеваний

+Г

23.В каких показателях регистрируется структура младенческой смертности:

+ Интенсивных

24.Рассчитать долю лиц в возрасте 0-14 лет (%) (округлить до 10-х долей) в муниципальном образовании Брюховецкий район, если среднегодовая численность населения -52933; население в возрасте 0-14 лет -8591. Определить вид показателя. + 16,2; экстенсивный.

25.Рассчитать обеспеченность населения больничными койками (на 10 000 населения)

(округлить до 10-х долей) центральной районной больницы муниципального образования (МО) Апшеронский район, если:

Исходные данные Среднегодовая численность населения Число больничных коек на конец года Число койко-дней, проведенных больными в стационаре в течение года

Число выписанных больных Число умерших больных

+45,3 на 10000 населения. Численные значения 97396 441 137803 15176 248

26. Рассчитать коэффициент младенческой смертности (округлить до 10-х долей) в муниципальном образовании Темрюкский район, если число родившихся живыми за год -1378; число детей умерших в возрасте до года -10. Определить вид показателя.

+7,3; интенсивный.

27. Рассчитать долю лиц в возрасте 15-49 лет (%) (округлить до 10-х долей) в Краснодарском крае, если среднегодовая численность населения -5141852; население в возрасте 15-49 лет -2439435. Определить вид показателя.

+ 47,4; экстенсивный.

Тема No4 Средние величины, методика их вычисления и оценки

1.Средние величины применяются для характеристики признаков: + количественных

2.Средней величиной является:

+средняя длительность одного случая временной нетрудоспособности 3. Модой является

+варианта с наибольшей частотой

4. Мода это:

+ варианта, встречающаяся чаще других 5. Медианой является:

+ варианта, находящаяся в середине вариационного ряда 6. Медиана ряда (Ме) это:

+ центральная варианта, делящая ряд пополам 7. Какая варианта вариационного ряда чаще всего принимается за условную среднюю: + мода

8. К средним величинам относятся все величины, кроме:

+ ошибка средней величины

9.К средним величинам не относится: + динамика явления

10.К средним величинам не относится: + среднее квадратическое отклонение

11.Величина, наиболее часто встречающаяся в вариационном ряду, называется: + модой (Мо)

12.Под модой понимают

+варианту ряда с наибольшей частотой 13. Под модой понимают

+варианту, в которой соответствует наибольшее количество частот вариационного ряда 14. Ошибка средней арифметической величины показывает

+в каких пределах могут колебаться полученные средние арифметические величины 15. Основными требованиями к выборочной совокупности является

+отражение свойств генеральной совокупности

16. Под медианой понимают

+варианту, находящуюся в середине ряда 17. Под медианой понимают

+величина признака, делящая ряд на две равные части 18. Средняя арифметическая величина — это

+сводная обобщающая величина, носящая абстрактный характер 19. Средняя арифметическая величина — это

+величина, имеющая ту же размеренность, что и каждая из вариант

20.К факторам, влияющим на величину ошибки средней арифметической, относится + среднее квадратическое отклонение

21.К факторам, влияющим на величину ошибки средней арифметической, относится + число наблюдений

22.К факторам, влияющим на величину ошибки средней арифметической, относится + мера колеблемости ряда

23.Среднее квадратическое отклонение — это

+мера колеблемости вариационного ряда 24. Среднее квадратическое отклонение — это

+величина, дающая характеристику разнообразию признака в совокупности 25. Ошибка репрезентативности, с увеличением число наблюдений

+уменьшается

26.Характеристикой вариационного ряда не является: + уровень

27.Коэффициент вариации представляет собой

+ степень рассеянности ряда в относительной величине

Тема No5 Оценка достоверности результатов исследования методика вычисления и оценки коэффициентов корреляции

1.Чтобы уменьшить ошибку выборки, число наблюдений нужно: + увеличить

2.Чем меньше число наблюдений, тем величина средней ошибки: + больше

3.Функциональной является связь между: + радиусом и площадью круга

4.Разница между средними величинами считается достоверной, если: + t = 2 и больше

5.При увеличении числа наблюдений величина средней ошибки:

+ уменьшается 6. При сравнении интенсивных показателей, полученных на однородных по своему составу

совокупностях, необходимо применять:

+ оценку достоверности разности показателей 7. Не считается достоверной для научных исследований вероятность (%): + 68,3

8. Коэффициент корреляции при сильной прямой связи равен: + +0,9

9. Коэффициент корреляции при сильной прямой связи между признаками равен: + +0,9 10. Коэффициент корреляции при обратной слабой связи равен:

+ -0,2 11. Коэффициент корреляции может иметь значение, равное: +-1

12. Какая из перечисленных видов связи расценивается как функциональная: + длина радиуса круга и его площадь 13. Какая из перечисленных видов связи не является корреляционной:

+ длина радиуса круга и его площадь

14.Для определения достоверности разности средних величин необходимо знать: + значения сравниваемых средних величин и их ошибки

15.Для медицинских исследований достаточной вероятностью безошибочного прогноза является:

Полученные

в результате статистического исследования

средние и относительные величины должны

отражать закономерности, характерные

для всей совокупности. Результаты

исследования обычно тем достовернее,

чем больше сделано наблюдений, и наиболее

точными они являются при сплошном

исследовании (т.е. при изучении генеральной

совокупности). Однако должны быть

достаточно надежные и данные, полученные

путем выборочных исследований, т.е. на

относительно небольшом числе наблюдений.

Различие

результатов выборочного исследования

и результатов, которые могут быть

получены на генеральной совокупности,

представляет собой ошибку выборочного

исследования, которую можно точно

определить математическим путем. Метод

ее оценки основан на закономерностях

случайных вариаций, установленных

теорией вероятности.

1.

Оценка достоверности средней

арифметической.

Средняя

арифметическая, полученная при обработке

результатов научно-практических

исследований, под влиянием случайных

явлений может отличаться от средних,

полученных при проведении повторных

исследований. Поэтому, чтобы иметь

представление о возможных пределах

колебаний средней, о том, с какой

вероятностью возможно перенести

результаты исследования с выборочной

совокупности на всю генеральную

совокупность, определяют степень

достоверности средней величины.

Мерой

достоверности средней является средняя

ошибка средней арифметической (ошибка

репрезентативности – m).

Ошибки репрезентативности возникают

в связи с тем, что при выборочным

наблюдении изучается только часть

генеральной совокупности, которая

недостаточно точно ее представляет.

Фактически ошибка репрезентативности

является разностью между средними,

полученными при выборочном статистическом

наблюдении, и средними, которые были бы

получены при сплошном наблюдении (т.е.

при изучении всей генеральной

совокупности).

Средняя

ошибка средней арифметической вычисляется

по формуле:

—

при числе наблюдений больше 30 (n

> 30):

—

при небольшом числе наблюдений (n

< 30):

Ошибка

репрезентативности прямо пропорциональна

колеблемости ряда (сигме) и обратно

пропорциональна числу наблюдений.

Следовательно,

чем больше

число наблюдений

(т.е. чем ближе по числу наблюдений

выборочная совокупность к генеральной),

тем меньше

ошибка репрезентативности.

Интервал,

в котором с заданным уровнем вероятности

колеблется истинное значение средней

величины или показателя, называется

доверительным

интервалом,

а его границы – доверительными

границами.

Они используются для определения

размеров средней или показателя в

генеральной совокупности.

Доверительные

границы

средней арифметической и показателя в

генеральной совокупности равны:

M

+

tm

P

+

tm,

где

t

– доверительный коэффициент.

Доверительный

коэффициент (t)

– это число, показывающее, во сколько

раз надо увеличить ошибку средней

величины или показателя, чтобы при

данном числе наблюдений с желаемой

степенью вероятности утверждать, что

они не выйдут за полученные таким образом

пределы.

С

увеличением t

степень вероятности возрастает.

Т.к.

известно, что полученная средняя или

показатель при повторных наблюдениях,

даже при одинаковых условиях, в силу

случайных колебаний будут отличаться

от предыдущего результат, теорией

статистики установлена степень

вероятности, с которой можно ожидать,

что колебания эти не выйдут за определенные

пределы. Так, колебания средней

в интервале M

+

1m

гарантируют ее точность с вероятностью

68.3% (такая

степень вероятности не удовлетворяет

исследователей), в

интервале M

+

2m

– 95.5%

(достаточная степень вероятности) и в

интервале M

+

3m

– 99,7% (большая

степень вероятности).

Для

медико-биологических исследований

принята степень вероятности 95% (t

= 2), что соответствует доверительному

интервалу M

+

2m.

Это

означает, что практически

с полной достоверностью (в 95%) можно

утверждать, что полученный средний

результат (М) отклоняется от истинного

значения не больше, чем на удвоенную (M

+

2m) ошибку.

Конечный

результат любого медико-статистического

исследования выражается средней

арифметической и ее параметрами:

2.

Оценка достоверности относительных

величин (показателей).

Средняя

ошибка показателя также служит для

определения пределов его случайных

колебаний, т.е. дает представление, в

каких пределах может находиться

показатель в различных выборках в

зависимости от случайных причин. С

увеличением численности выборки ошибка

уменьшается.

Мерой

достоверности показателя является его

средняя ошибка (m),

которая показывает, на сколько результат,

полученный при выборочным исследовании,

отличается от результата, который был

бы получен при изучении всей генеральной

совокупности.

Средняя

ошибка показателя определяется по

формуле:

,

где mp

– ошибка относительного показателя,

р

– показатель,

q

– величина, обратная показателю (100-p,

1000-р и т.д. в зависимости от того, на какое

основание рассчитан показатель);

n

– число наблюдений.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Среднее арифметическое, как известно, используется для получения обобщающей характеристики некоторого набора данных. Если данные более-менее однородны и в них нет аномальных наблюдений (выбросов), то среднее хорошо обобщает данные, сведя к минимуму влияние случайных факторов (они взаимопогашаются при сложении).

Когда анализируемые данные представляют собой выборку (которая состоит из случайных значений), то среднее арифметическое часто (но не всегда) выступает в роли приближенной оценки математического ожидания. Почему приближенной? Потому что среднее арифметическое – это величина, которая зависит от набора случайных чисел, и, следовательно, сама является случайной величиной. При повторных экспериментах (даже в одних и тех же условиях) средние будут отличаться друг от друга.

Для того, чтобы на основе статистического анализа данных делать корректные выводы, необходимо оценить возможный разброс полученного результата. Для этого рассчитываются различные показатели вариации. Но то исходные данные. И как мы только что установили, среднее арифметическое также обладает разбросом, который необходимо оценить и учитывать в дальнейшем (в выводах, в выборе метода анализа и т.д.).

Интуитивно понятно, что разброс средней должен быть как-то связан с разбросом исходных данных. Основной характеристикой разброса средней выступает та же дисперсия.

Дисперсия выборочных данных – это средний квадрат отклонения от средней, и рассчитать ее по исходным данным не составляет труда, например, в Excel предусмотрены специальные функции. Однако, как же рассчитать дисперсию средней, если в распоряжении есть только одна выборка и одно среднее арифметическое?

Расчет дисперсии и стандартной ошибки средней арифметической

Чтобы получить дисперсию средней арифметической нет необходимости проводить множество экспериментов, достаточно иметь только одну выборку. Это легко доказать. Для начала вспомним, что средняя арифметическая (простая) рассчитывается по формуле:

где xi – значения переменной,

n – количество значений.

Теперь учтем два свойства дисперсии, согласно которым, 1) — постоянный множитель можно вынести за знак дисперсии, возведя его в квадрат и 2) — дисперсия суммы независимых случайных величин равняется сумме соответствующих дисперсий. Предполагается, что каждое случайное значение xi обладает одинаковым разбросом, поэтому несложно вывести формулу дисперсии средней арифметической:

Используя более привычные обозначения, формулу записывают как:

где σ2 – это дисперсия, случайной величины, причем генеральная.

На практике же, генеральная дисперсия известна далеко не всегда, точнее совсем редко, поэтому в качестве оной используют выборочную дисперсию:

Стандартное отклонение средней арифметической называется стандартной ошибкой средней и рассчитывается, как квадратный корень из дисперсии.

Формула стандартной ошибки средней при использовании генеральной дисперсии

Формула стандартной ошибки средней при использовании выборочной дисперсии

Последняя формула на практике используется чаще всего, т.к. генеральная дисперсия обычно не известна. Чтобы не вводить новые обозначения, стандартную ошибку средней обычно записывают в виде соотношения стандартного отклонения выборки и корня объема выборки.

Назначение и свойство стандартной ошибки средней арифметической

Стандартная ошибка средней много, где используется. И очень полезно понимать ее свойства. Посмотрим еще раз на формулу стандартной ошибки средней:

Числитель – это стандартное отклонение выборки и здесь все понятно. Чем больше разброс данных, тем больше стандартная ошибка средней – прямо пропорциональная зависимость.

Посмотрим на знаменатель. Здесь находится квадратный корень из объема выборки. Соответственно, чем больше объем выборки, тем меньше стандартная ошибка средней. Для наглядности изобразим на одной диаграмме график нормально распределенной переменной со средней равной 10, сигмой – 3, и второй график – распределение средней арифметической этой же переменной, полученной по 16-ти наблюдениям (которое также будет нормальным).

Судя по формуле, разброс стандартной ошибки средней должен быть в 4 раза (корень из 16) меньше, чем разброс исходных данных, что и видно на рисунке выше. Чем больше наблюдений, тем меньше разброс средней.

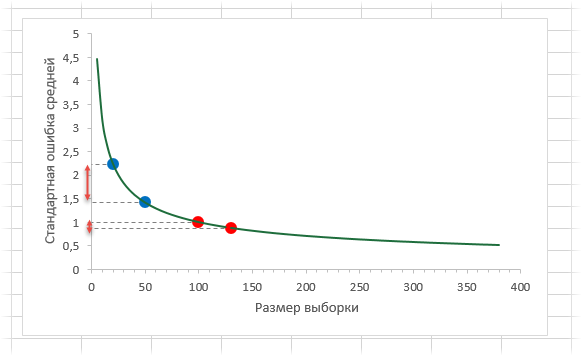

Казалось бы, что для получения наиболее точной средней достаточно использовать максимально большую выборку и тогда стандартная ошибка средней будет стремиться к нулю, а сама средняя, соответственно, к математическому ожиданию. Однако квадратный корень объема выборки в знаменателе говорит о том, что связь между точностью выборочной средней и размером выборки не является линейной. Например, увеличение выборки с 20-ти до 50-ти наблюдений, то есть на 30 значений или в 2,5 раза, уменьшает стандартную ошибку средней только на 36%, а со 100-а до 130-ти наблюдений (на те же 30 значений), снижает разброс данных лишь на 12%.

Лучше всего изобразить эту мысль в виде графика зависимости стандартной ошибки средней от размера выборки. Пусть стандартное отклонение равно 10 (на форму графика это не влияет).

Видно, что примерно после 50-ти значений, уменьшение стандартной ошибки средней резко замедляется, после 100-а – наклон постепенно становится почти нулевым.

Таким образом, при достижении некоторого размера выборки ее дальнейшее увеличение уже почти не сказывается на точности средней. Этот факт имеет далеко идущие последствия. Например, при проведении выборочного обследования населения (опроса) чрезмерное увеличение выборки ведет к неоправданным затратам, т.к. точность почти не меняется. Именно поэтому количество опрошенных редко превышает 1,5 тысячи человек. Точность при таком размере выборки часто является достаточной, а дальнейшее увеличение выборки – нецелесообразным.

Подведем итог. Расчет дисперсии и стандартной ошибки средней имеет довольно простую формулу и обладает полезным свойством, связанным с тем, что относительно хорошая точность средней достигается уже при 100 наблюдениях (в этом случае стандартная ошибка средней становится в 10 раз меньше, чем стандартное отклонение выборки). Больше, конечно, лучше, но бесконечно увеличивать объем выборки не имеет практического смысла. Хотя, все зависит от поставленных задач и цены ошибки. В некоторых опросах участие принимают десятки тысяч людей.

Дисперсия и стандартная ошибка средней имеют большое практическое значение. Они используются в проверке гипотез и расчете доверительных интервалов.

Поделиться в социальных сетях:

Содержание

- Расчет ошибки средней арифметической

- Способ 1: расчет с помощью комбинации функций

- Способ 2: применение инструмента «Описательная статистика»

- Вопросы и ответы

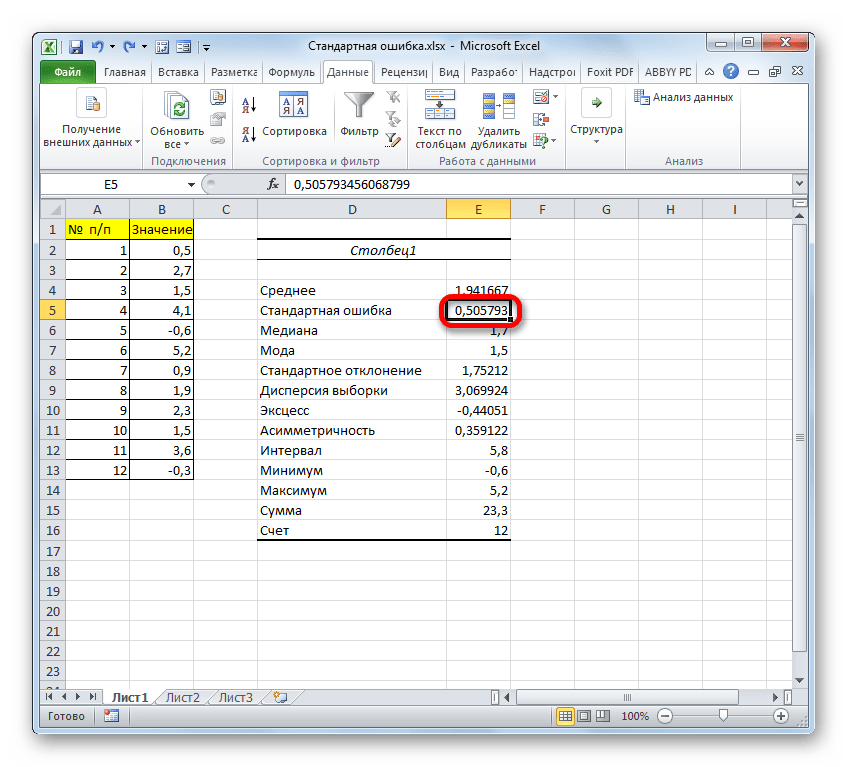

Стандартная ошибка или, как часто называют, ошибка средней арифметической, является одним из важных статистических показателей. С помощью данного показателя можно определить неоднородность выборки. Он также довольно важен при прогнозировании. Давайте узнаем, какими способами можно рассчитать величину стандартной ошибки с помощью инструментов Microsoft Excel.

Расчет ошибки средней арифметической

Одним из показателей, которые характеризуют цельность и однородность выборки, является стандартная ошибка. Эта величина представляет собой корень квадратный из дисперсии. Сама дисперсия является средним квадратном от средней арифметической. Средняя арифметическая вычисляется делением суммарной величины объектов выборки на их общее количество.

В Экселе существуют два способа вычисления стандартной ошибки: используя набор функций и при помощи инструментов Пакета анализа. Давайте подробно рассмотрим каждый из этих вариантов.

Способ 1: расчет с помощью комбинации функций

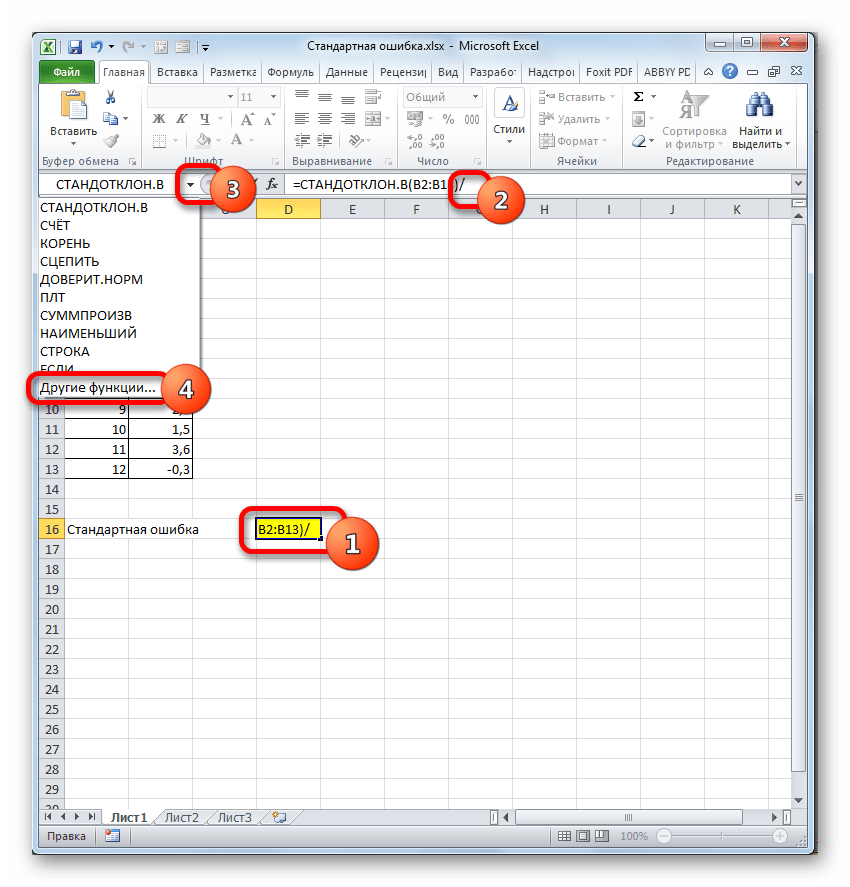

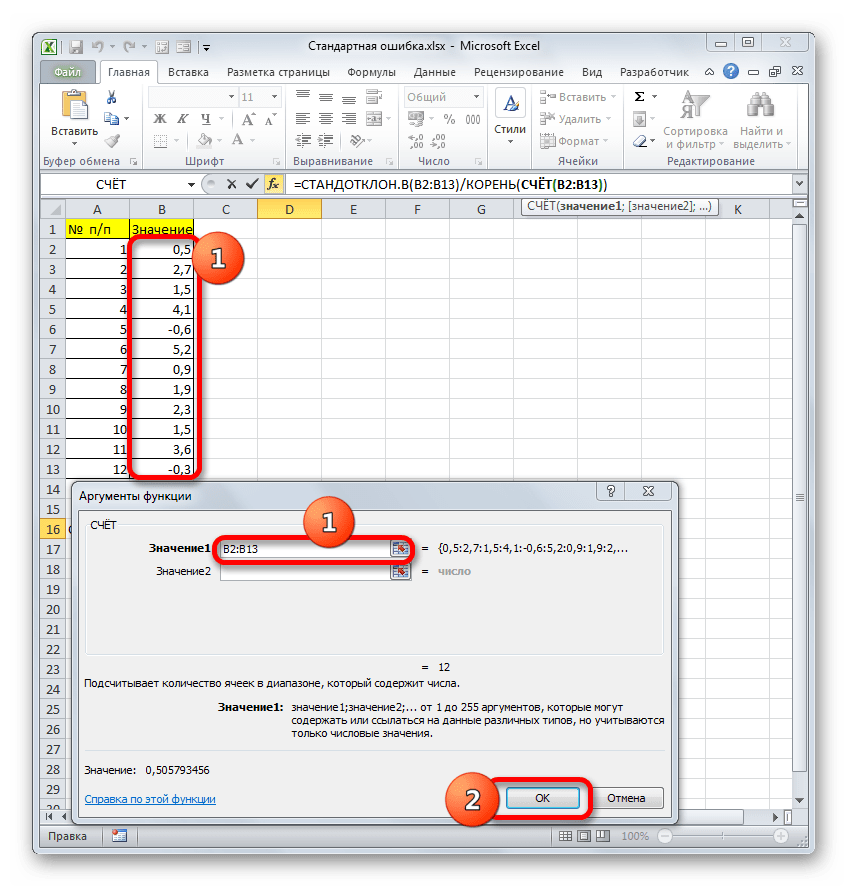

Прежде всего, давайте составим алгоритм действий на конкретном примере по расчету ошибки средней арифметической, используя для этих целей комбинацию функций. Для выполнения задачи нам понадобятся операторы СТАНДОТКЛОН.В, КОРЕНЬ и СЧЁТ.

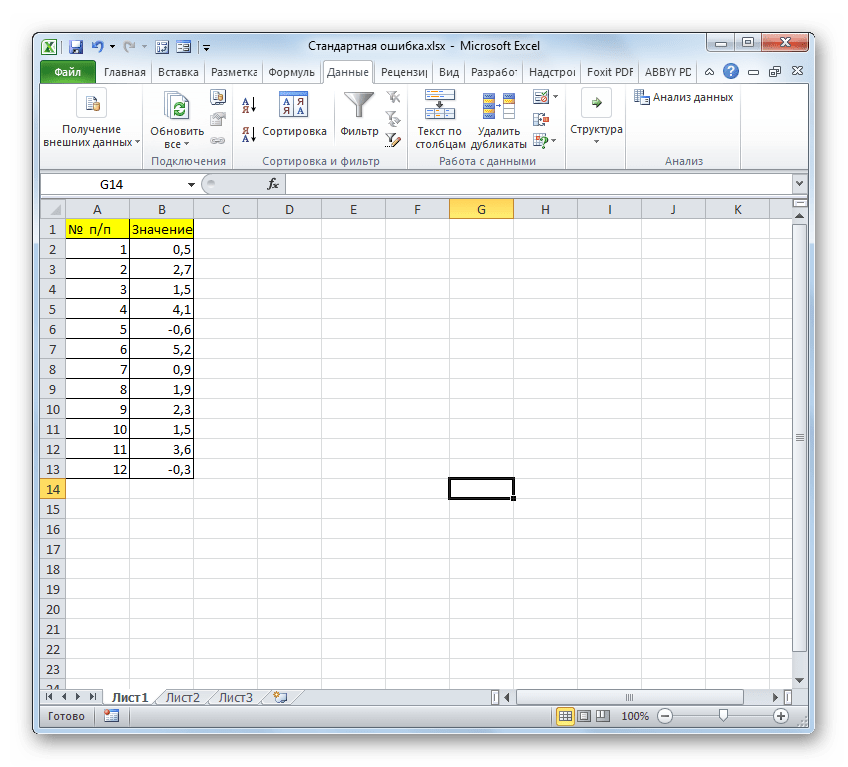

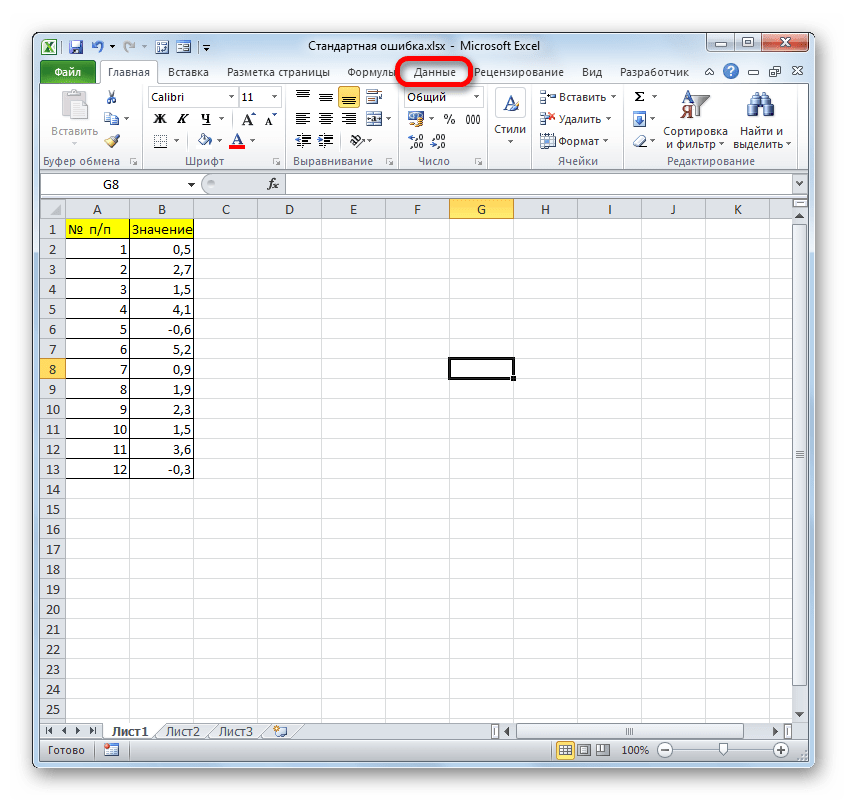

Для примера нами будет использована выборка из двенадцати чисел, представленных в таблице.

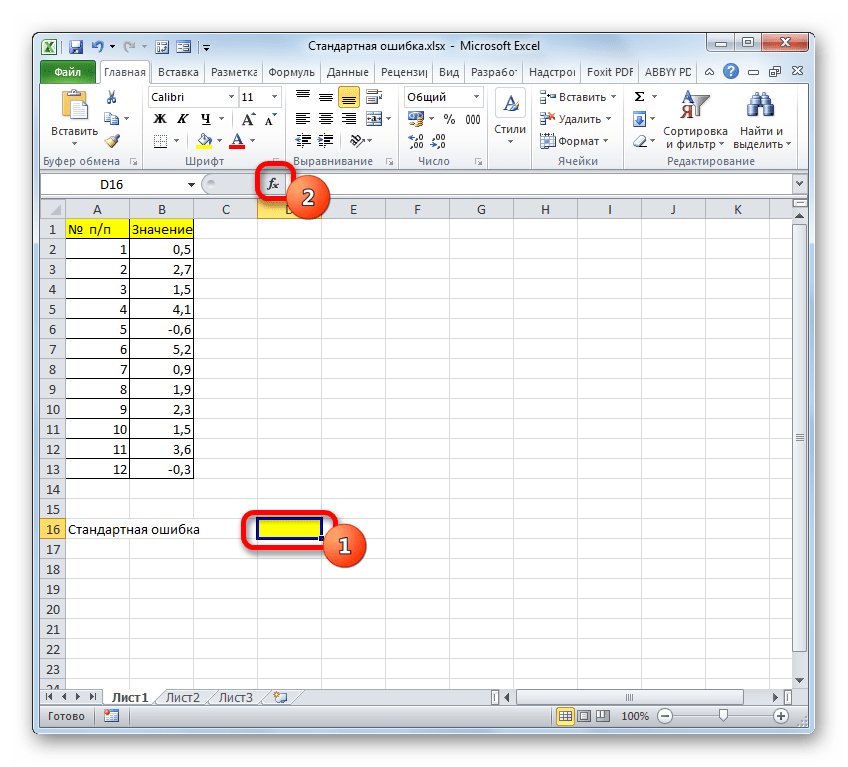

- Выделяем ячейку, в которой будет выводиться итоговое значение стандартной ошибки, и клацаем по иконке «Вставить функцию».

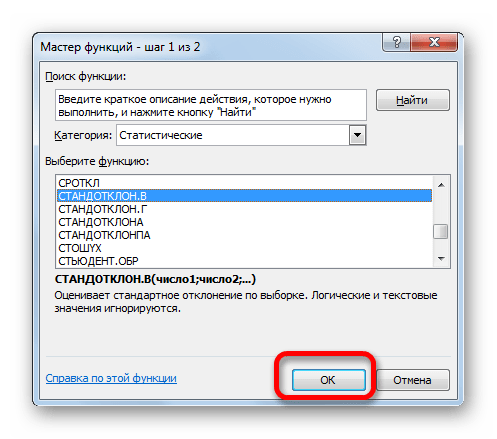

- Открывается Мастер функций. Производим перемещение в блок «Статистические». В представленном перечне наименований выбираем название «СТАНДОТКЛОН.В».

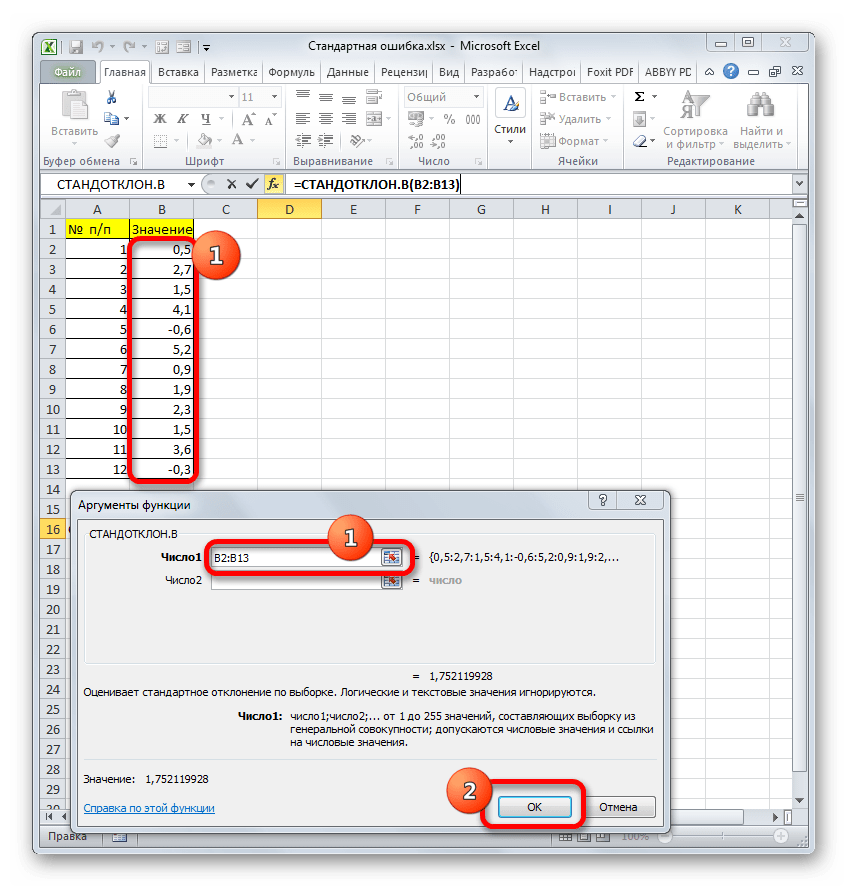

- Запускается окно аргументов вышеуказанного оператора. СТАНДОТКЛОН.В предназначен для оценивания стандартного отклонения при выборке. Данный оператор имеет следующий синтаксис:

=СТАНДОТКЛОН.В(число1;число2;…)«Число1» и последующие аргументы являются числовыми значениями или ссылками на ячейки и диапазоны листа, в которых они расположены. Всего может насчитываться до 255 аргументов этого типа. Обязательным является только первый аргумент.

Итак, устанавливаем курсор в поле «Число1». Далее, обязательно произведя зажим левой кнопки мыши, выделяем курсором весь диапазон выборки на листе. Координаты данного массива тут же отображаются в поле окна. После этого клацаем по кнопке «OK».

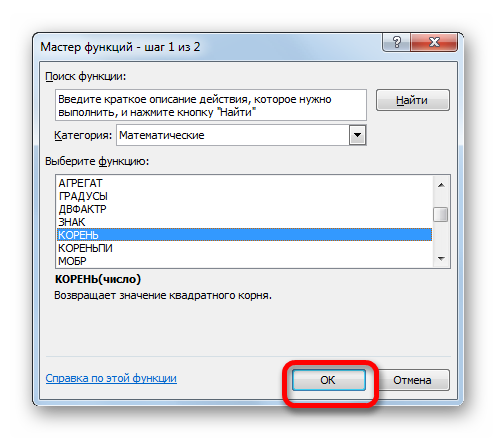

- В ячейку на листе выводится результат расчета оператора СТАНДОТКЛОН.В. Но это ещё не ошибка средней арифметической. Для того, чтобы получить искомое значение, нужно стандартное отклонение разделить на квадратный корень от количества элементов выборки. Для того, чтобы продолжить вычисления, выделяем ячейку, содержащую функцию СТАНДОТКЛОН.В. После этого устанавливаем курсор в строку формул и дописываем после уже существующего выражения знак деления (/). Вслед за этим клацаем по пиктограмме перевернутого вниз углом треугольника, которая располагается слева от строки формул. Открывается список недавно использованных функций. Если вы в нем найдете наименование оператора «КОРЕНЬ», то переходите по данному наименованию. В обратном случае жмите по пункту «Другие функции…».

- Снова происходит запуск Мастера функций. На этот раз нам следует посетить категорию «Математические». В представленном перечне выделяем название «КОРЕНЬ» и жмем на кнопку «OK».

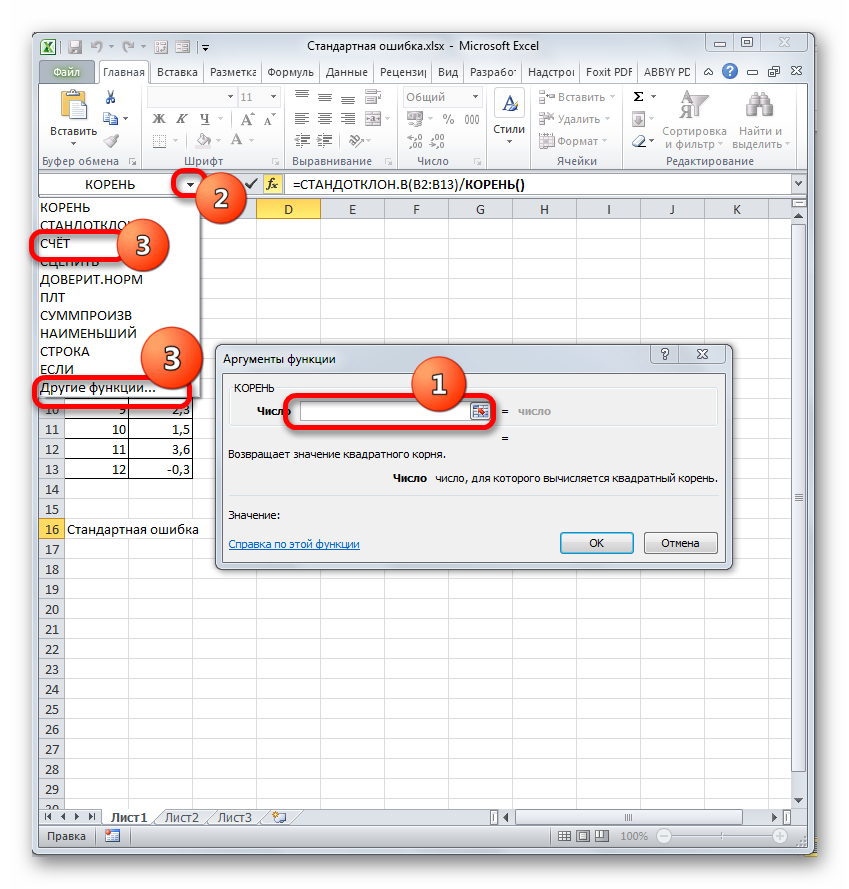

- Открывается окно аргументов функции КОРЕНЬ. Единственной задачей данного оператора является вычисление квадратного корня из заданного числа. Его синтаксис предельно простой:

=КОРЕНЬ(число)Как видим, функция имеет всего один аргумент «Число». Он может быть представлен числовым значением, ссылкой на ячейку, в которой оно содержится или другой функцией, вычисляющей это число. Последний вариант как раз и будет представлен в нашем примере.

Устанавливаем курсор в поле «Число» и кликаем по знакомому нам треугольнику, который вызывает список последних использованных функций. Ищем в нем наименование «СЧЁТ». Если находим, то кликаем по нему. В обратном случае, опять же, переходим по наименованию «Другие функции…».

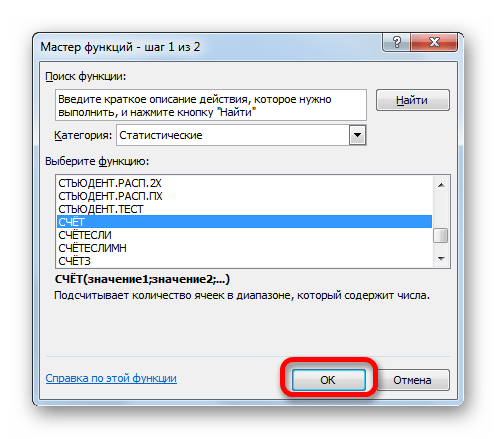

- В раскрывшемся окне Мастера функций производим перемещение в группу «Статистические». Там выделяем наименование «СЧЁТ» и выполняем клик по кнопке «OK».

- Запускается окно аргументов функции СЧЁТ. Указанный оператор предназначен для вычисления количества ячеек, которые заполнены числовыми значениями. В нашем случае он будет подсчитывать количество элементов выборки и сообщать результат «материнскому» оператору КОРЕНЬ. Синтаксис функции следующий:

=СЧЁТ(значение1;значение2;…)В качестве аргументов «Значение», которых может насчитываться до 255 штук, выступают ссылки на диапазоны ячеек. Ставим курсор в поле «Значение1», зажимаем левую кнопку мыши и выделяем весь диапазон выборки. После того, как его координаты отобразились в поле, жмем на кнопку «OK».

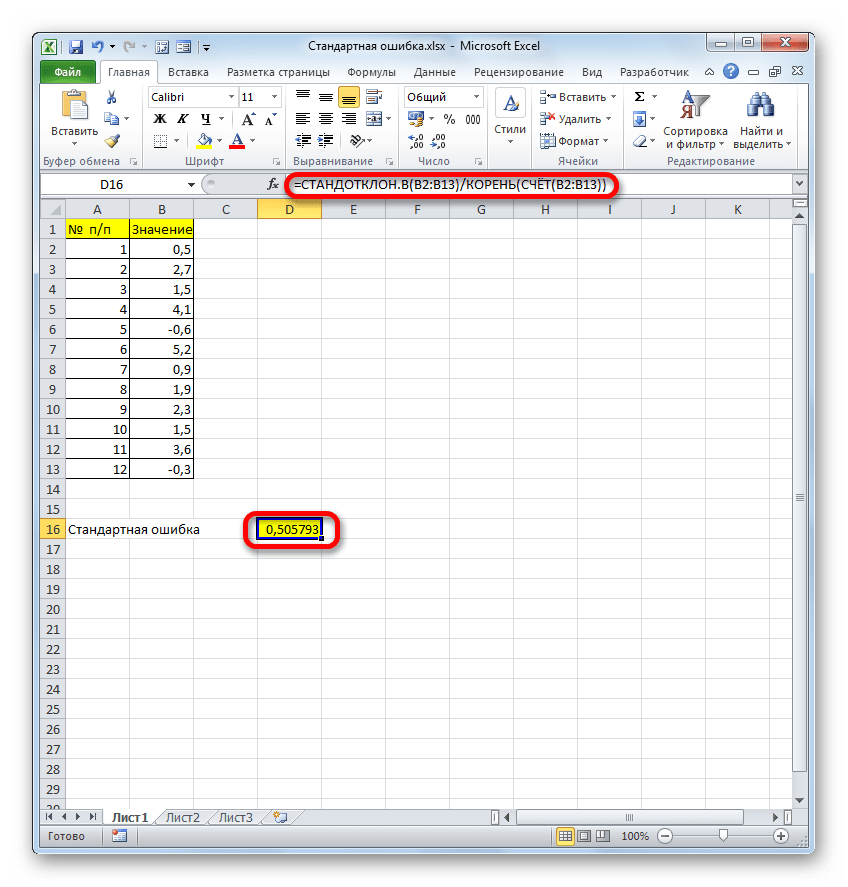

- После выполнения последнего действия будет не только рассчитано количество ячеек заполненных числами, но и вычислена ошибка средней арифметической, так как это был последний штрих в работе над данной формулой. Величина стандартной ошибки выведена в ту ячейку, где размещена сложная формула, общий вид которой в нашем случае следующий:

=СТАНДОТКЛОН.В(B2:B13)/КОРЕНЬ(СЧЁТ(B2:B13))Результат вычисления ошибки средней арифметической составил 0,505793. Запомним это число и сравним с тем, которое получим при решении поставленной задачи следующим способом.

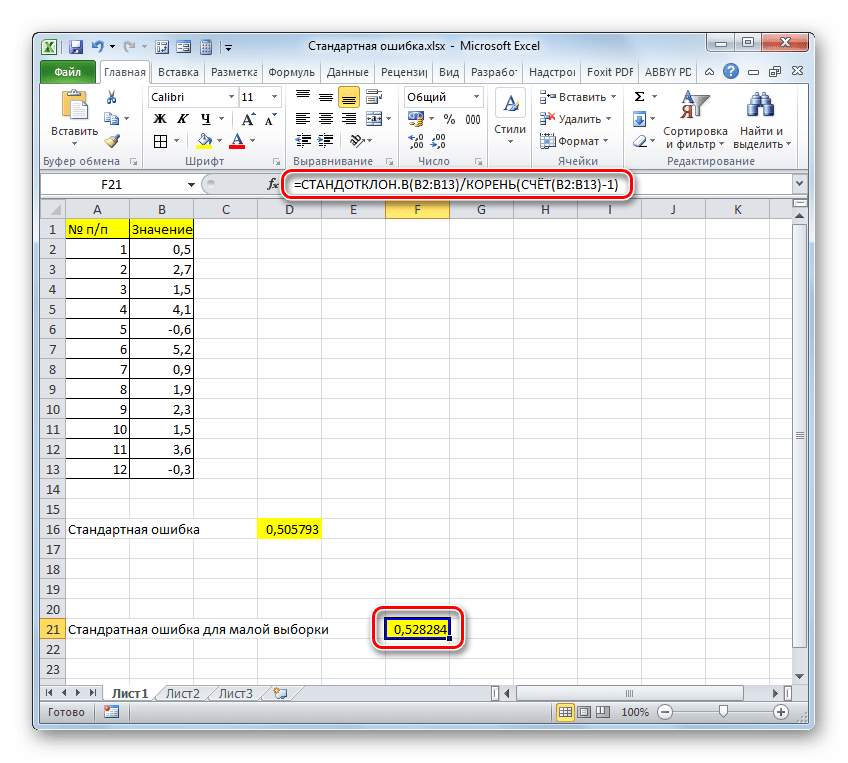

Но дело в том, что для малых выборок (до 30 единиц) для большей точности лучше применять немного измененную формулу. В ней величина стандартного отклонения делится не на квадратный корень от количества элементов выборки, а на квадратный корень от количества элементов выборки минус один. Таким образом, с учетом нюансов малой выборки наша формула приобретет следующий вид:

=СТАНДОТКЛОН.В(B2:B13)/КОРЕНЬ(СЧЁТ(B2:B13)-1)

Урок: Статистические функции в Экселе

Способ 2: применение инструмента «Описательная статистика»

Вторым вариантом, с помощью которого можно вычислить стандартную ошибку в Экселе, является применение инструмента «Описательная статистика», входящего в набор инструментов «Анализ данных» («Пакет анализа»). «Описательная статистика» проводит комплексный анализ выборки по различным критериям. Одним из них как раз и является нахождение ошибки средней арифметической.

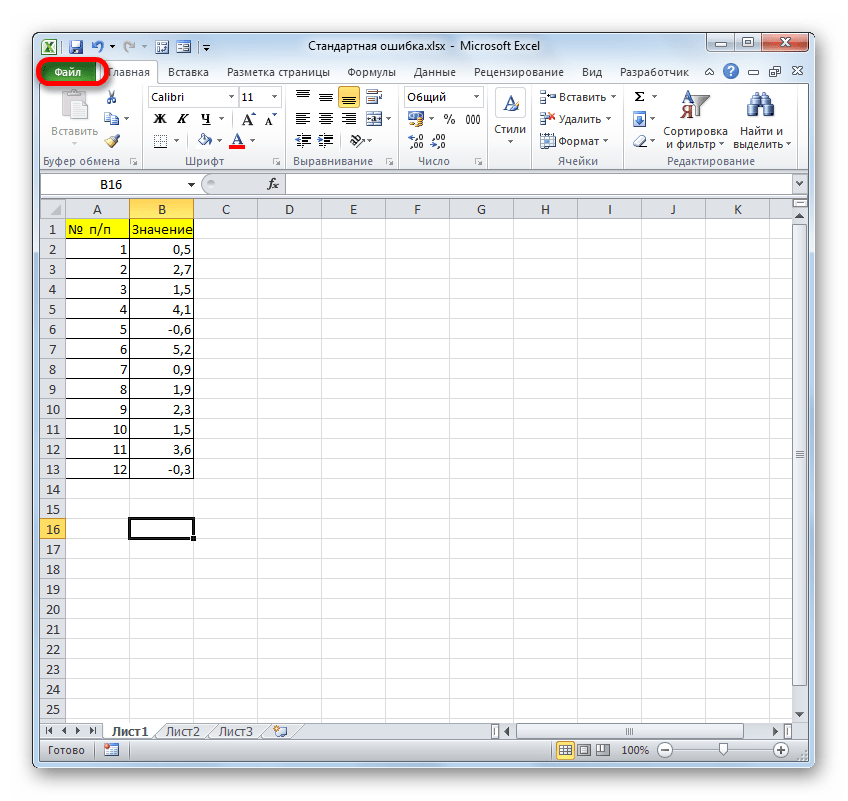

Но чтобы воспользоваться данной возможностью, нужно сразу активировать «Пакет анализа», так как по умолчанию в Экселе он отключен.

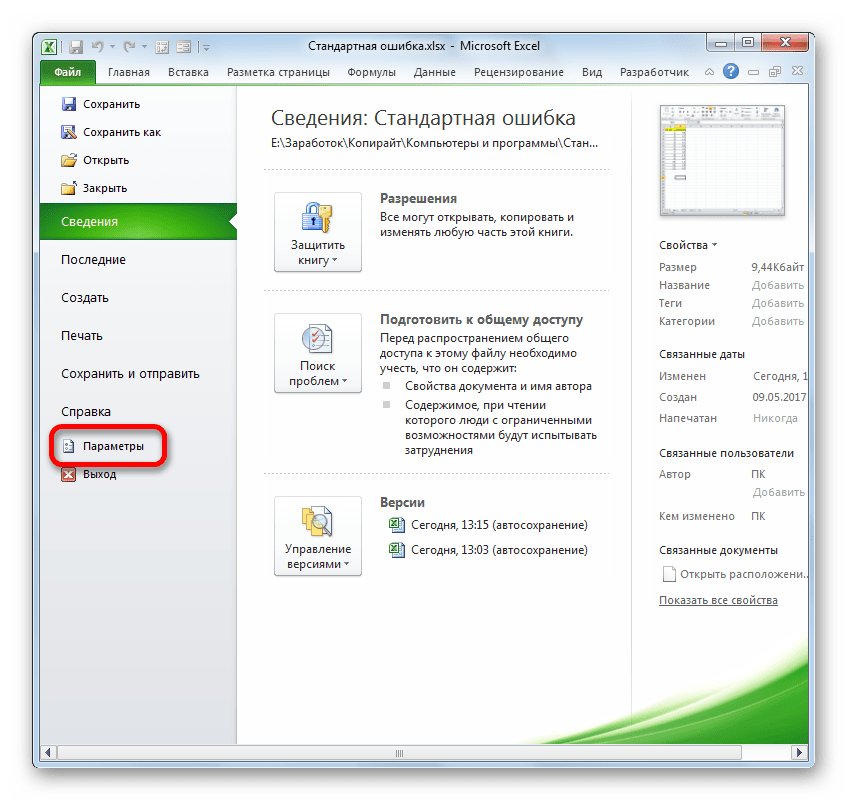

- После того, как открыт документ с выборкой, переходим во вкладку «Файл».

- Далее, воспользовавшись левым вертикальным меню, перемещаемся через его пункт в раздел «Параметры».

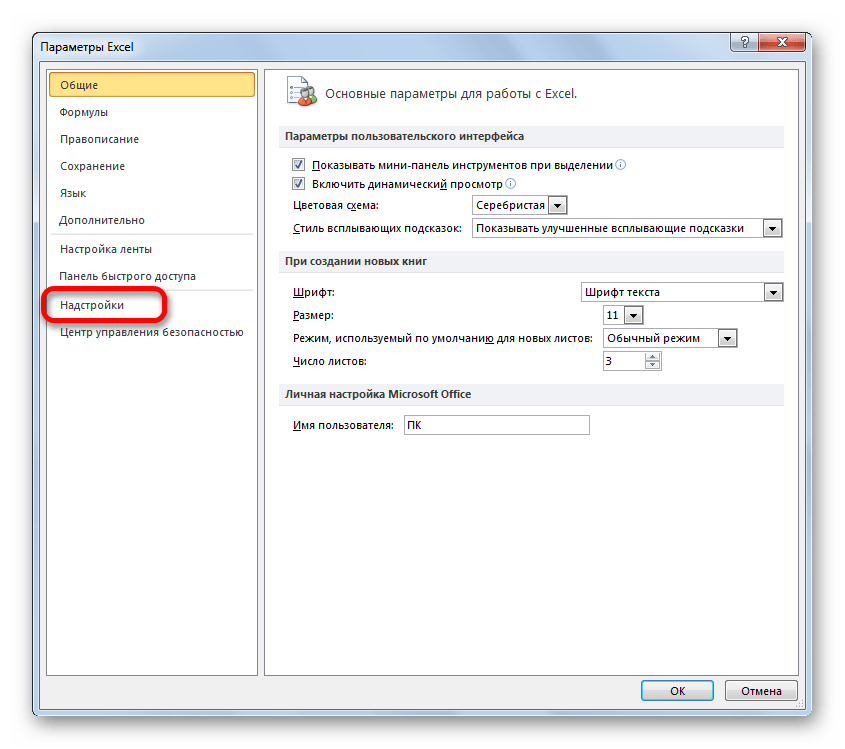

- Запускается окно параметров Эксель. В левой части данного окна размещено меню, через которое перемещаемся в подраздел «Надстройки».

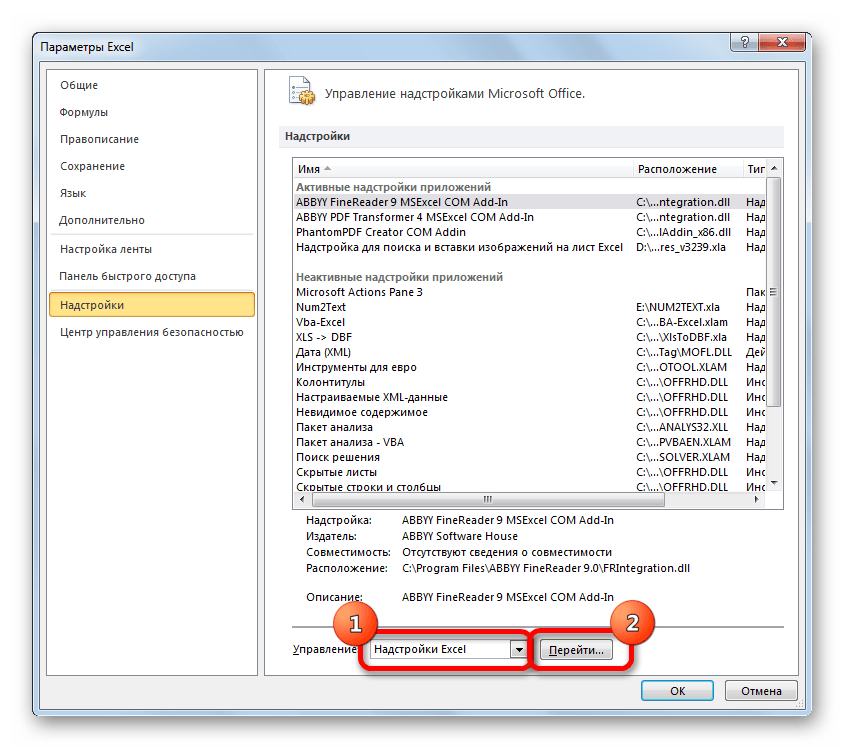

- В самой нижней части появившегося окна расположено поле «Управление». Выставляем в нем параметр «Надстройки Excel» и жмем на кнопку «Перейти…» справа от него.

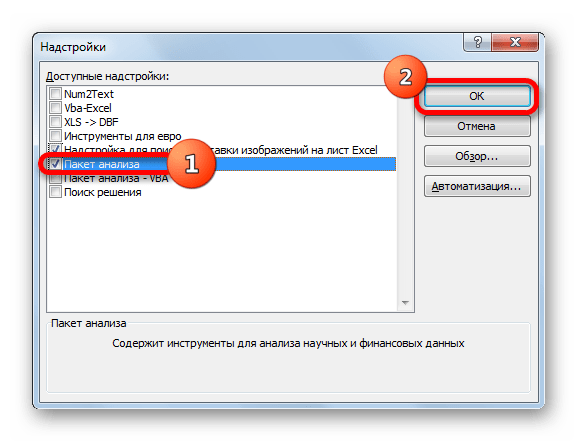

- Запускается окно надстроек с перечнем доступных скриптов. Отмечаем галочкой наименование «Пакет анализа» и щелкаем по кнопке «OK» в правой части окошка.

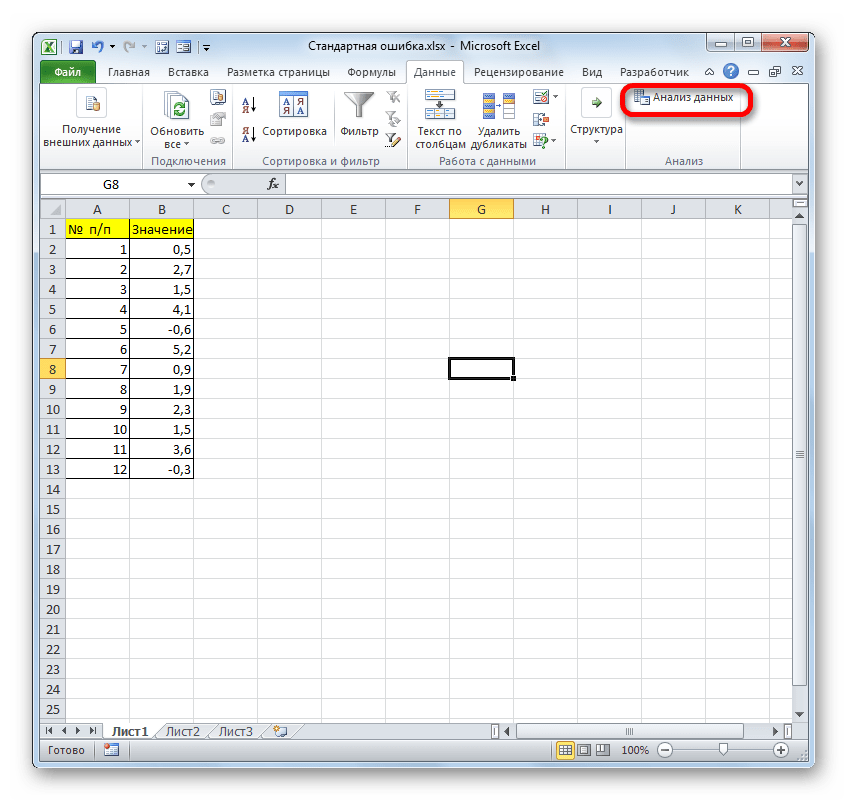

- После выполнения последнего действия на ленте появится новая группа инструментов, которая имеет наименование «Анализ». Чтобы перейти к ней, щелкаем по названию вкладки «Данные».

- После перехода жмем на кнопку «Анализ данных» в блоке инструментов «Анализ», который расположен в самом конце ленты.

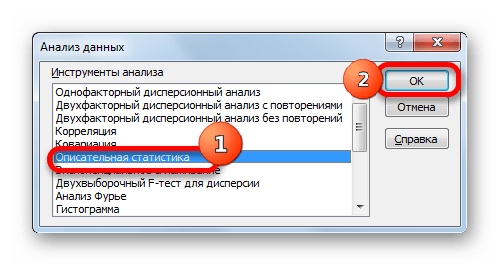

- Запускается окошко выбора инструмента анализа. Выделяем наименование «Описательная статистика» и жмем на кнопку «OK» справа.

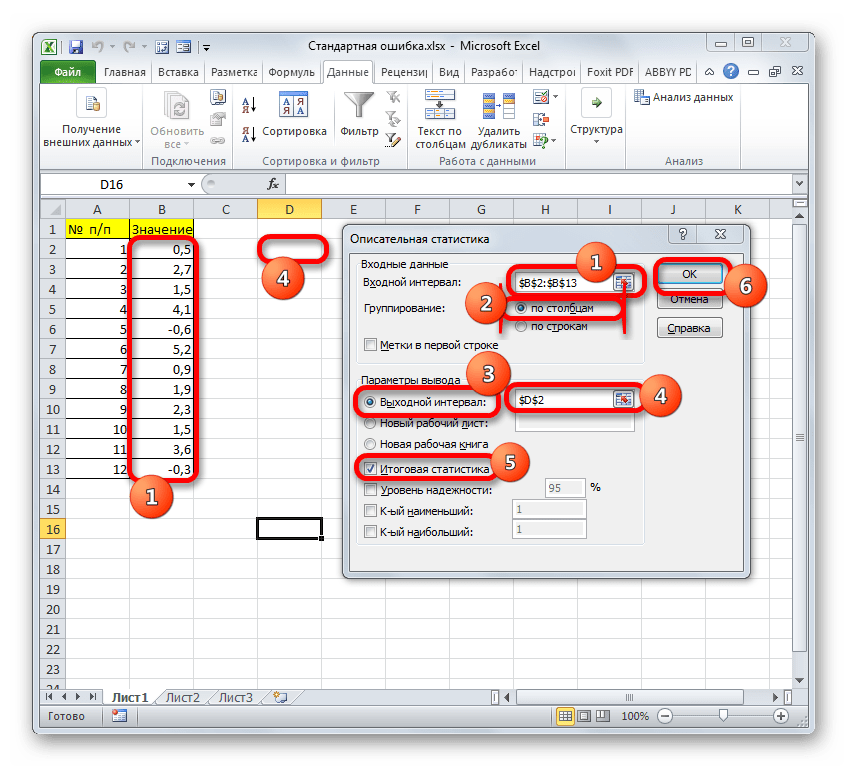

- Запускается окно настроек инструмента комплексного статистического анализа «Описательная статистика».

В поле «Входной интервал» необходимо указать диапазон ячеек таблицы, в которых находится анализируемая выборка. Вручную это делать неудобно, хотя и можно, поэтому ставим курсор в указанное поле и при зажатой левой кнопке мыши выделяем соответствующий массив данных на листе. Его координаты тут же отобразятся в поле окна.

В блоке «Группирование» оставляем настройки по умолчанию. То есть, переключатель должен стоять около пункта «По столбцам». Если это не так, то его следует переставить.

Галочку «Метки в первой строке» можно не устанавливать. Для решения нашего вопроса это не важно.

Далее переходим к блоку настроек «Параметры вывода». Здесь следует указать, куда именно будет выводиться результат расчета инструмента «Описательная статистика»:

- На новый лист;

- В новую книгу (другой файл);

- В указанный диапазон текущего листа.

Давайте выберем последний из этих вариантов. Для этого переставляем переключатель в позицию «Выходной интервал» и устанавливаем курсор в поле напротив данного параметра. После этого клацаем на листе по ячейке, которая станет верхним левым элементом массива вывода данных. Её координаты должны отобразиться в поле, в котором мы до этого устанавливали курсор.

Далее следует блок настроек определяющий, какие именно данные нужно вводить:

- Итоговая статистика;

- К-ый наибольший;

- К-ый наименьший;

- Уровень надежности.

Для определения стандартной ошибки обязательно нужно установить галочку около параметра «Итоговая статистика». Напротив остальных пунктов выставляем галочки на свое усмотрение. На решение нашей основной задачи это никак не повлияет.

После того, как все настройки в окне «Описательная статистика» установлены, щелкаем по кнопке «OK» в его правой части.

- После этого инструмент «Описательная статистика» выводит результаты обработки выборки на текущий лист. Как видим, это довольно много разноплановых статистических показателей, но среди них есть и нужный нам – «Стандартная ошибка». Он равен числу 0,505793. Это в точности тот же результат, который мы достигли путем применения сложной формулы при описании предыдущего способа.

Урок: Описательная статистика в Экселе

Как видим, в Экселе можно произвести расчет стандартной ошибки двумя способами: применив набор функций и воспользовавшись инструментом пакета анализа «Описательная статистика». Итоговый результат будет абсолютно одинаковый. Поэтому выбор метода зависит от удобства пользователя и поставленной конкретной задачи. Например, если ошибка средней арифметической является только одним из многих статистических показателей выборки, которые нужно рассчитать, то удобнее воспользоваться инструментом «Описательная статистика». Но если вам нужно вычислить исключительно этот показатель, то во избежание нагромождения лишних данных лучше прибегнуть к сложной формуле. В этом случае результат расчета уместится в одной ячейке листа.

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]

Like variance, mean squared error has the disadvantage of heavily weighting outliers.[11] This is a result of the squaring of each term, which effectively weights large errors more heavily than small ones. This property, undesirable in many applications, has led researchers to use alternatives such as the mean absolute error, or those based on the median.

See also[edit]

- Bias–variance tradeoff

- Hodges’ estimator

- James–Stein estimator

- Mean percentage error

- Mean square quantization error

- Mean square weighted deviation

- Mean squared displacement

- Mean squared prediction error

- Minimum mean square error

- Minimum mean squared error estimator

- Overfitting

- Peak signal-to-noise ratio

Notes[edit]

- ^ This can be proved by Jensen’s inequality as follows. The fourth central moment is an upper bound for the square of variance, so that the least value for their ratio is one, therefore, the least value for the excess kurtosis is −2, achieved, for instance, by a Bernoulli with p=1/2.

References[edit]

- ^ a b «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 2020-09-12.

- ^ Bickel, Peter J.; Doksum, Kjell A. (2015). Mathematical Statistics: Basic Ideas and Selected Topics. Vol. I (Second ed.). p. 20.

If we use quadratic loss, our risk function is called the mean squared error (MSE) …

- ^ a b Lehmann, E. L.; Casella, George (1998). Theory of Point Estimation (2nd ed.). New York: Springer. ISBN 978-0-387-98502-2. MR 1639875.

- ^ Gareth, James; Witten, Daniela; Hastie, Trevor; Tibshirani, Rob (2021). An Introduction to Statistical Learning: with Applications in R. Springer. ISBN 978-1071614174.

- ^ Wackerly, Dennis; Mendenhall, William; Scheaffer, Richard L. (2008). Mathematical Statistics with Applications (7 ed.). Belmont, CA, USA: Thomson Higher Education. ISBN 978-0-495-38508-0.

- ^ A modern introduction to probability and statistics : understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{cite book}}: CS1 maint: others (link) - ^ Steel, R.G.D, and Torrie, J. H., Principles and Procedures of Statistics with Special Reference to the Biological Sciences., McGraw Hill, 1960, page 288.

- ^ Mood, A.; Graybill, F.; Boes, D. (1974). Introduction to the Theory of Statistics (3rd ed.). McGraw-Hill. p. 229.

- ^ DeGroot, Morris H. (1980). Probability and Statistics (2nd ed.). Addison-Wesley.

- ^ Berger, James O. (1985). «2.4.2 Certain Standard Loss Functions». Statistical Decision Theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. p. 60. ISBN 978-0-387-96098-2. MR 0804611.

- ^ Bermejo, Sergio; Cabestany, Joan (2001). «Oriented principal component analysis for large margin classifiers». Neural Networks. 14 (10): 1447–1461. doi:10.1016/S0893-6080(01)00106-X. PMID 11771723.

In statistics, the mean squared error (MSE)[1] or mean squared deviation (MSD) of an estimator (of a procedure for estimating an unobserved quantity) measures the average of the squares of the errors—that is, the average squared difference between the estimated values and the actual value. MSE is a risk function, corresponding to the expected value of the squared error loss.[2] The fact that MSE is almost always strictly positive (and not zero) is because of randomness or because the estimator does not account for information that could produce a more accurate estimate.[3] In machine learning, specifically empirical risk minimization, MSE may refer to the empirical risk (the average loss on an observed data set), as an estimate of the true MSE (the true risk: the average loss on the actual population distribution).

The MSE is a measure of the quality of an estimator. As it is derived from the square of Euclidean distance, it is always a positive value that decreases as the error approaches zero.

The MSE is the second moment (about the origin) of the error, and thus incorporates both the variance of the estimator (how widely spread the estimates are from one data sample to another) and its bias (how far off the average estimated value is from the true value).[citation needed] For an unbiased estimator, the MSE is the variance of the estimator. Like the variance, MSE has the same units of measurement as the square of the quantity being estimated. In an analogy to standard deviation, taking the square root of MSE yields the root-mean-square error or root-mean-square deviation (RMSE or RMSD), which has the same units as the quantity being estimated; for an unbiased estimator, the RMSE is the square root of the variance, known as the standard error.

Definition and basic properties[edit]

The MSE either assesses the quality of a predictor (i.e., a function mapping arbitrary inputs to a sample of values of some random variable), or of an estimator (i.e., a mathematical function mapping a sample of data to an estimate of a parameter of the population from which the data is sampled). The definition of an MSE differs according to whether one is describing a predictor or an estimator.

Predictor[edit]

If a vector of

In other words, the MSE is the mean

In matrix notation,

where

The MSE can also be computed on q data points that were not used in estimating the model, either because they were held back for this purpose, or because these data have been newly obtained. Within this process, known as statistical learning, the MSE is often called the test MSE,[4] and is computed as

Estimator[edit]

The MSE of an estimator

This definition depends on the unknown parameter, but the MSE is a priori a property of an estimator. The MSE could be a function of unknown parameters, in which case any estimator of the MSE based on estimates of these parameters would be a function of the data (and thus a random variable). If the estimator

The MSE can be written as the sum of the variance of the estimator and the squared bias of the estimator, providing a useful way to calculate the MSE and implying that in the case of unbiased estimators, the MSE and variance are equivalent.[5]

Proof of variance and bias relationship[edit]

An even shorter proof can be achieved using the well-known formula that for a random variable

But in real modeling case, MSE could be described as the addition of model variance, model bias, and irreducible uncertainty (see Bias–variance tradeoff). According to the relationship, the MSE of the estimators could be simply used for the efficiency comparison, which includes the information of estimator variance and bias. This is called MSE criterion.

In regression[edit]

In regression analysis, plotting is a more natural way to view the overall trend of the whole data. The mean of the distance from each point to the predicted regression model can be calculated, and shown as the mean squared error. The squaring is critical to reduce the complexity with negative signs. To minimize MSE, the model could be more accurate, which would mean the model is closer to actual data. One example of a linear regression using this method is the least squares method—which evaluates appropriateness of linear regression model to model bivariate dataset,[6] but whose limitation is related to known distribution of the data.

The term mean squared error is sometimes used to refer to the unbiased estimate of error variance: the residual sum of squares divided by the number of degrees of freedom. This definition for a known, computed quantity differs from the above definition for the computed MSE of a predictor, in that a different denominator is used. The denominator is the sample size reduced by the number of model parameters estimated from the same data, (n−p) for p regressors or (n−p−1) if an intercept is used (see errors and residuals in statistics for more details).[7] Although the MSE (as defined in this article) is not an unbiased estimator of the error variance, it is consistent, given the consistency of the predictor.

In regression analysis, «mean squared error», often referred to as mean squared prediction error or «out-of-sample mean squared error», can also refer to the mean value of the squared deviations of the predictions from the true values, over an out-of-sample test space, generated by a model estimated over a particular sample space. This also is a known, computed quantity, and it varies by sample and by out-of-sample test space.

Examples[edit]

Mean[edit]

Suppose we have a random sample of size

which has an expected value equal to the true mean

where

For a Gaussian distribution, this is the best unbiased estimator (i.e., one with the lowest MSE among all unbiased estimators), but not, say, for a uniform distribution.

Variance[edit]

The usual estimator for the variance is the corrected sample variance:

This is unbiased (its expected value is

where

However, one can use other estimators for

then we calculate:

This is minimized when

For a Gaussian distribution, where

Further, while the corrected sample variance is the best unbiased estimator (minimum mean squared error among unbiased estimators) of variance for Gaussian distributions, if the distribution is not Gaussian, then even among unbiased estimators, the best unbiased estimator of the variance may not be

Gaussian distribution[edit]

The following table gives several estimators of the true parameters of the population, μ and σ2, for the Gaussian case.[9]

| True value | Estimator | Mean squared error |

|---|---|---|

|

= the unbiased estimator of the population mean, = the unbiased estimator of the population mean,  |

|

|

= the unbiased estimator of the population variance, = the unbiased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

|

= the biased estimator of the population variance, = the biased estimator of the population variance,  |

|

Interpretation[edit]

An MSE of zero, meaning that the estimator

Values of MSE may be used for comparative purposes. Two or more statistical models may be compared using their MSEs—as a measure of how well they explain a given set of observations: An unbiased estimator (estimated from a statistical model) with the smallest variance among all unbiased estimators is the best unbiased estimator or MVUE (Minimum-Variance Unbiased Estimator).

Both analysis of variance and linear regression techniques estimate the MSE as part of the analysis and use the estimated MSE to determine the statistical significance of the factors or predictors under study. The goal of experimental design is to construct experiments in such a way that when the observations are analyzed, the MSE is close to zero relative to the magnitude of at least one of the estimated treatment effects.

In one-way analysis of variance, MSE can be calculated by the division of the sum of squared errors and the degree of freedom. Also, the f-value is the ratio of the mean squared treatment and the MSE.

MSE is also used in several stepwise regression techniques as part of the determination as to how many predictors from a candidate set to include in a model for a given set of observations.

Applications[edit]

- Minimizing MSE is a key criterion in selecting estimators: see minimum mean-square error. Among unbiased estimators, minimizing the MSE is equivalent to minimizing the variance, and the estimator that does this is the minimum variance unbiased estimator. However, a biased estimator may have lower MSE; see estimator bias.

- In statistical modelling the MSE can represent the difference between the actual observations and the observation values predicted by the model. In this context, it is used to determine the extent to which the model fits the data as well as whether removing some explanatory variables is possible without significantly harming the model’s predictive ability.

- In forecasting and prediction, the Brier score is a measure of forecast skill based on MSE.

Loss function[edit]

Squared error loss is one of the most widely used loss functions in statistics[citation needed], though its widespread use stems more from mathematical convenience than considerations of actual loss in applications. Carl Friedrich Gauss, who introduced the use of mean squared error, was aware of its arbitrariness and was in agreement with objections to it on these grounds.[3] The mathematical benefits of mean squared error are particularly evident in its use at analyzing the performance of linear regression, as it allows one to partition the variation in a dataset into variation explained by the model and variation explained by randomness.

Criticism[edit]

The use of mean squared error without question has been criticized by the decision theorist James Berger. Mean squared error is the negative of the expected value of one specific utility function, the quadratic utility function, which may not be the appropriate utility function to use under a given set of circumstances. There are, however, some scenarios where mean squared error can serve as a good approximation to a loss function occurring naturally in an application.[10]

Like variance, mean squared error has the disadvantage of heavily weighting outliers.[11] This is a result of the squaring of each term, which effectively weights large errors more heavily than small ones. This property, undesirable in many applications, has led researchers to use alternatives such as the mean absolute error, or those based on the median.

See also[edit]

- Bias–variance tradeoff

- Hodges’ estimator

- James–Stein estimator

- Mean percentage error

- Mean square quantization error

- Mean square weighted deviation

- Mean squared displacement

- Mean squared prediction error

- Minimum mean square error

- Minimum mean squared error estimator

- Overfitting

- Peak signal-to-noise ratio

Notes[edit]

- ^ This can be proved by Jensen’s inequality as follows. The fourth central moment is an upper bound for the square of variance, so that the least value for their ratio is one, therefore, the least value for the excess kurtosis is −2, achieved, for instance, by a Bernoulli with p=1/2.

References[edit]

- ^ a b «Mean Squared Error (MSE)». www.probabilitycourse.com. Retrieved 2020-09-12.

- ^ Bickel, Peter J.; Doksum, Kjell A. (2015). Mathematical Statistics: Basic Ideas and Selected Topics. Vol. I (Second ed.). p. 20.

If we use quadratic loss, our risk function is called the mean squared error (MSE) …

- ^ a b Lehmann, E. L.; Casella, George (1998). Theory of Point Estimation (2nd ed.). New York: Springer. ISBN 978-0-387-98502-2. MR 1639875.

- ^ Gareth, James; Witten, Daniela; Hastie, Trevor; Tibshirani, Rob (2021). An Introduction to Statistical Learning: with Applications in R. Springer. ISBN 978-1071614174.

- ^ Wackerly, Dennis; Mendenhall, William; Scheaffer, Richard L. (2008). Mathematical Statistics with Applications (7 ed.). Belmont, CA, USA: Thomson Higher Education. ISBN 978-0-495-38508-0.

- ^ A modern introduction to probability and statistics : understanding why and how. Dekking, Michel, 1946-. London: Springer. 2005. ISBN 978-1-85233-896-1. OCLC 262680588.

{{cite book}}: CS1 maint: others (link) - ^ Steel, R.G.D, and Torrie, J. H., Principles and Procedures of Statistics with Special Reference to the Biological Sciences., McGraw Hill, 1960, page 288.

- ^ Mood, A.; Graybill, F.; Boes, D. (1974). Introduction to the Theory of Statistics (3rd ed.). McGraw-Hill. p. 229.

- ^ DeGroot, Morris H. (1980). Probability and Statistics (2nd ed.). Addison-Wesley.

- ^ Berger, James O. (1985). «2.4.2 Certain Standard Loss Functions». Statistical Decision Theory and Bayesian Analysis (2nd ed.). New York: Springer-Verlag. p. 60. ISBN 978-0-387-96098-2. MR 0804611.

- ^ Bermejo, Sergio; Cabestany, Joan (2001). «Oriented principal component analysis for large margin classifiers». Neural Networks. 14 (10): 1447–1461. doi:10.1016/S0893-6080(01)00106-X. PMID 11771723.

Стандартное отклонение и стандартная ошибка: в чем разница?

17 авг. 2022 г.

читать 2 мин

В статистике студенты часто путают два термина: стандартное отклонение и стандартная ошибка .

Стандартное отклонение измеряет, насколько разбросаны значения в наборе данных.

Стандартная ошибка — это стандартное отклонение среднего значения в повторных выборках из совокупности.

Давайте рассмотрим пример, чтобы ясно проиллюстрировать эту идею.

Пример: стандартное отклонение против стандартной ошибки

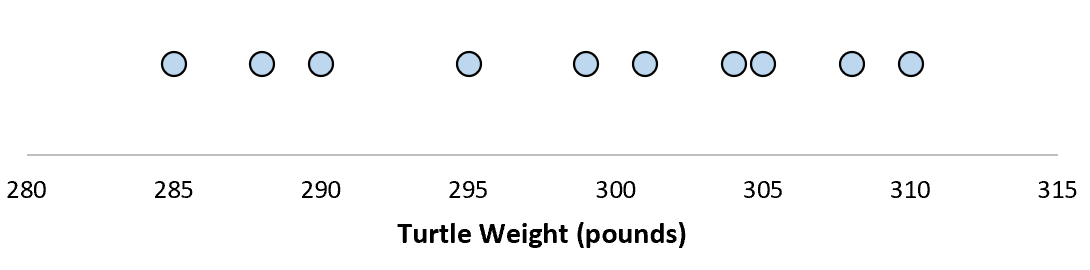

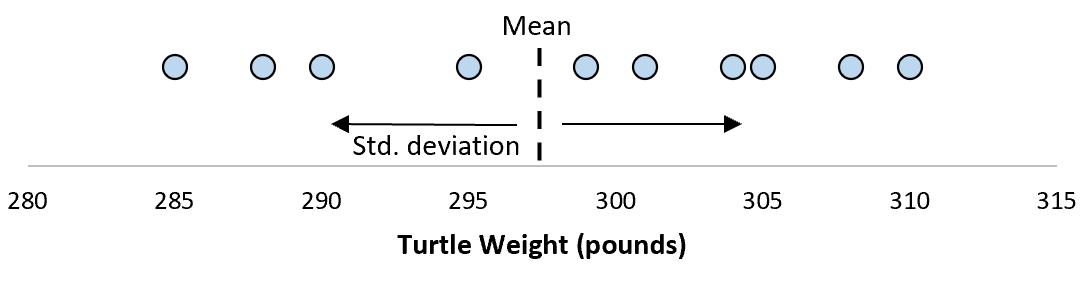

Предположим, мы измеряем вес 10 разных черепах.

Для этой выборки из 10 черепах мы можем вычислить среднее значение выборки и стандартное отклонение выборки:

Предположим, что стандартное отклонение оказалось равным 8,68. Это дает нам представление о том, насколько распределен вес этих черепах.

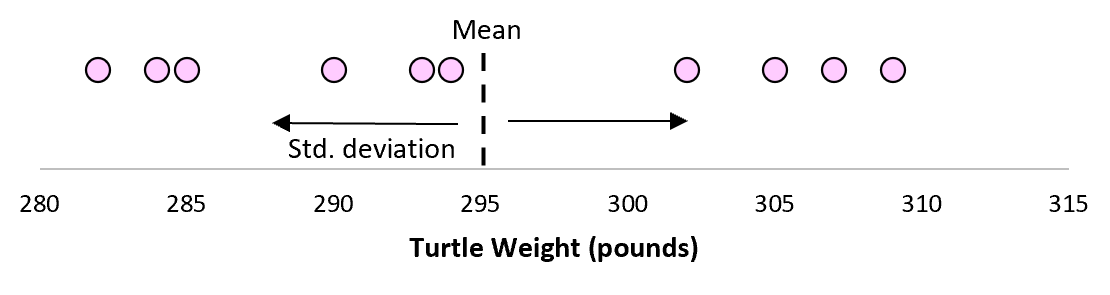

Но предположим, что мы собираем еще одну простую случайную выборку из 10 черепах и также проводим их измерения. Более чем вероятно, что эта выборка из 10 черепах будет иметь немного другое среднее значение и стандартное отклонение, даже если они взяты из одной и той же популяции:

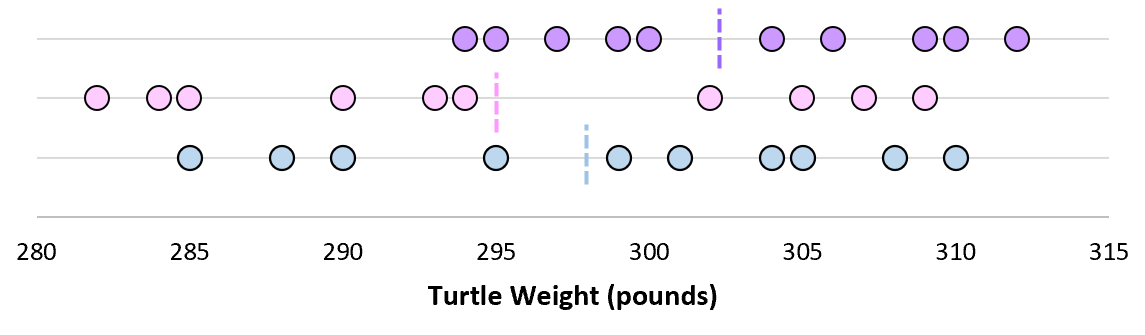

Теперь, если мы представим, что мы берем повторные выборки из одной и той же совокупности и записываем выборочное среднее и выборочное стандартное отклонение для каждой выборки:

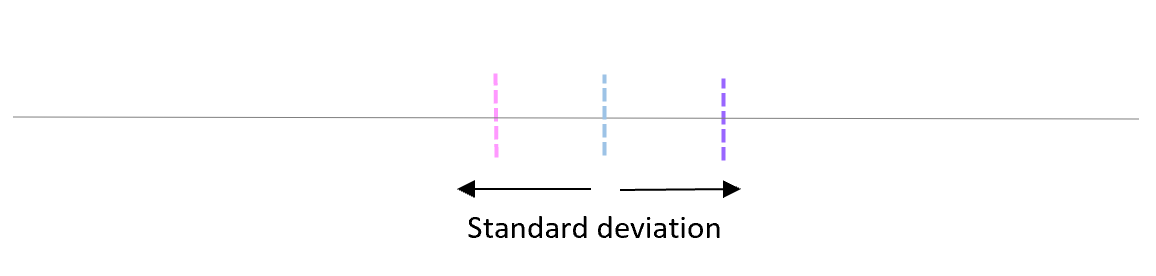

Теперь представьте, что мы наносим каждое среднее значение выборки на одну и ту же строку:

Стандартное отклонение этих средних значений известно как стандартная ошибка.

Формула для фактического расчета стандартной ошибки:

Стандартная ошибка = s/ √n

куда:

- s: стандартное отклонение выборки

- n: размер выборки

Какой смысл использовать стандартную ошибку?

Когда мы вычисляем среднее значение данной выборки, нас на самом деле интересует не среднее значение этой конкретной выборки, а скорее среднее значение большей совокупности, из которой взята выборка.

Однако мы используем выборки, потому что для них гораздо проще собирать данные, чем для всего населения. И, конечно же, среднее значение выборки будет варьироваться от выборки к выборке, поэтому мы используем стандартную ошибку среднего значения как способ измерить, насколько точна наша оценка среднего значения.

Вы заметите из формулы для расчета стандартной ошибки, что по мере увеличения размера выборки (n) стандартная ошибка уменьшается:

Стандартная ошибка = s/ √n

Это должно иметь смысл, поскольку большие размеры выборки уменьшают изменчивость и увеличивают вероятность того, что среднее значение нашей выборки ближе к фактическому среднему значению генеральной совокупности.

Когда использовать стандартное отклонение против стандартной ошибки

Если мы просто заинтересованы в измерении того, насколько разбросаны значения в наборе данных, мы можем использовать стандартное отклонение .

Однако, если мы заинтересованы в количественной оценке неопределенности оценки среднего значения, мы можем использовать стандартную ошибку среднего значения .

В зависимости от вашего конкретного сценария и того, чего вы пытаетесь достичь, вы можете использовать либо стандартное отклонение, либо стандартную ошибку.

Ранее мы рассматривали пример анализа, где аналитик оценивал средние планируемые капитальные затраты клиентов на телекоммуникационное оборудование.

Если предположить, что выборка репрезентативна для совокупности, то как аналитик может оценить ошибку выборки при расчете среднего значения по совокупности?

Рассматриваемое как формула, которая использует функцию случайных исходов случайной величины, выборочное среднее само по себе является случайной величиной с распределением вероятностей. Это распределение вероятностей называется выборочным распределением статистики (англ. ‘sampling distribution’).

Иногда возникает путаница, потому что термин «выборочное среднее» также используется в другом смысле. При расчете выборочного среднего для конкретной выборки, мы получаем определенное число, скажем, 8.

Если мы говорим, что «выборочное среднее равно 8», мы используем термин «выборочное среднее» в смысле конкретного исхода выборочного среднего как случайной величины. Число 8 является, конечно же, постоянной величиной и не имеет распределения вероятностей.

В данном обсуждении, мы не рассматриваем «выборочное среднее» как постоянную величину, относящуюся к конкретной выборке.